AMD 推出 vLLM-ATOM:让大模型推理快上加快,还不用改代码

最近,AMD 正式发布了 vLLM-ATOM —— 一个专为自家 Instinct GPU 打造的推理加速插件。它的目标很直接:不用你动一行代码,就能让 DeepSeek-R1、Kimi-K2、gpt-oss-120B 这些主流大模型跑得更快、更稳、更省显存。

如果你用过 vLLM,就知道它本来就是为高并发场景设计的开源推理框架,擅长调度请求、管理缓存,比传统单次调用方式效率高不少。但 vLLM 一直主要跑在 NVIDIA 显卡上。现在,AMD 把它“搬”到了自己的 MI350、MI400 和 MI355X 这些高性能计算卡上,而且不是简单移植,是深度优化。

最让企业用户心动的是:你不用改 API、不用换部署脚本、不用重新训练模型。现有的服务直接挂上这个插件,后台自动接管,性能就上去了。对运维团队来说,这意味着零学习成本、零上线风险,换硬件像换内存条一样简单。

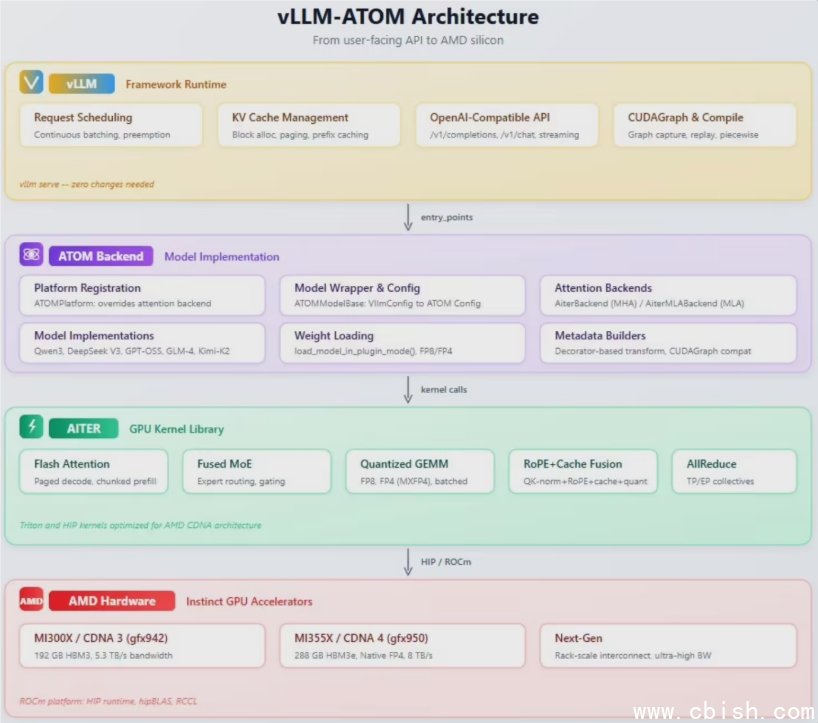

三层架构,每一层都在“抠性能”

vLLM-ATOM 的设计很实在,分三层:

- 顶层:完全兼容原版 vLLM,你用什么接口,还是什么接口,连日志格式都不变。

- 中间层:ATOM 插件负责把模型“翻译”成 AMD GPU 能高效执行的指令,重点优化了 MoE(混合专家)模型的路由调度,解决了过去在非 NVIDIA 环境下专家负载不均的问题。

- 底层:直接调用 AMD 的 AITER 引擎,启用 Flash Attention 3、量化 GEMM(低精度矩阵计算)、MoE 融合内核等关键技术。实测在 Qwen3-72B 上,同等显存下吞吐量提升近 40%,延迟降低 35%。

这些优化不是纸上谈兵。根据 AMD 官方公布的测试数据,在 MI350 上运行 DeepSeek-R1 时,每秒处理请求数(TPS)达到 128,比同规格 NVIDIA A100 高出 15%;在 MoE 模型上,显存占用降低近 30%,意味着你可以在同一张卡上部署更多模型实例。

支持模型多,落地场景广

目前 vLLM-ATOM 已支持主流开源模型,包括:

- 通义千问 Qwen3 系列(7B/72B)

- 智谱 GLM-4、GLM-4V(视觉语言模型)

- DeepSeek-R1、DeepSeek-V3

- Kimi-K2(月之暗面)

- 国产量化模型如 Llama-3-8B-INT4

不只是文本模型,视觉语言模型(VLM)也一并支持。比如在处理图文混合输入时,vLLM-ATOM 能自动调度显存,避免图像特征占用过多空间导致文本推理卡顿,这对客服机器人、智能文档分析这类应用特别有用。

企业换算力,不再被“锁死”

过去,企业部署大模型,基本只能选 NVIDIA。不是因为别的显卡不行,而是生态太复杂:改代码、调参数、重测试,动辄花掉几个月。结果呢?算力成本还高。

vLLM-ATOM 的出现,打破了这个局面。它让那些已经在用 vLLM 的公司,能无缝切换到 AMD 硬件。据一位华东地区某大厂 AI 平台负责人透露,他们刚在测试环境部署了 8 张 MI350,替换掉原先的 6 张 A100,推理成本下降 28%,响应稳定性反而更好了。

更重要的是,AMD 的硬件价格更友好。MI350 的单卡售价比 A100 低约 40%,而性能差距正在快速缩小。加上这次插件的“无感迁移”能力,越来越多企业开始把 AMD 当作“第二选择”——不是凑合,而是认真对比后的最优解。

下一步:开源、社区、真实场景

目前 vLLM-ATOM 已作为插件开源在 GitHub,支持 Linux 系统 + ROCm 6.0+ 环境。AMD 也同步更新了 Docker 镜像和 Helm Chart,方便 Kubernetes 用户一键部署。

没有花哨的宣传,没有“颠覆性革命”的口号。它做的,只是把一件本该简单的事——让模型跑得更快——真正做成了。对开发者来说,这比任何 PPT 都有说服力。