“马嘉祺”为什么总被写成“佳琪”?一场被忽略的AI语言故障

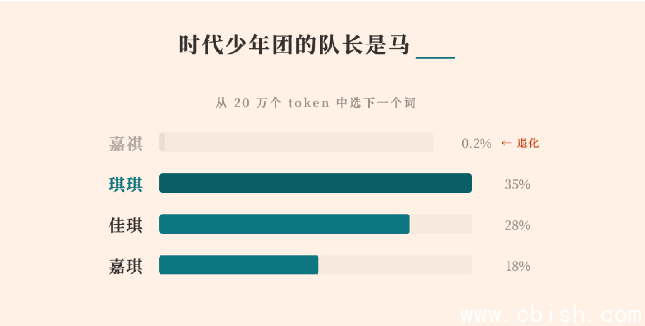

最近,不少用户在和MiniMax的M2系列模型聊天时发现了一个奇怪的现象:只要提到“马嘉祺”,模型总爱把他写成“佳琪”“琪琪”甚至“嘉琪”——明明是粉丝熟知的艺人名字,AI却像记错了拼音一样,频频出错。

这不是简单的错别字。经过MiniMax团队深入排查,问题的根源竟藏在模型训练的“后处理”环节——一个连很多技术从业者都很少关注的步骤。

一个词被“挤”丢了:Token的无声消亡

中文分词器把“马嘉祺”拆成了“马”和“嘉祺”两个部分。其中,“嘉祺”这个词在早期的海量网络文本里出现过很多次,于是被系统单独标记为一个“词元”(Token),编号190467。

但问题出在后面的“后训练”阶段——这个阶段主要用来教模型怎么更像人一样聊天,数据全是对话记录:用户问“今天吃什么”,模型答“火锅不错”;用户说“帮我写个代码”,模型就输出一堆Python。

可问题是:谁会在对话里反复提“马嘉祺”?谁会拿“嘉祺”当关键词?结果,包含这个Token的训练样本,全加起来不到5条。

而与此同时,像“```”“json”“function”“tool_call”这些代码符号、工具调用标记,每天被模型反复练习成千上万次。它们的向量被不断修正、强化,像一群挤在地铁里的人,把“嘉祺”这个原本就不常出现的词元,一点点挤到了向量空间的角落。

结果就是:模型知道“马嘉祺”是谁,也知道他唱过什么歌、参加过什么节目,但它就是“说不出来”这个名字——因为它已经“忘了”该怎么拼出“嘉祺”这两个字。

不只是马嘉祺:日语、SEO垃圾词,都在悄悄消失

团队一查,发现这根本不是个例。他们扫描了整个20万个词表,发现近5%的词元都出现了类似“退化”——不是完全消失,而是变得模糊、不稳定,模型开始用别的词来“凑合”。

最严重的是日语词汇。有近三成的日语词元(比如“こんにちは”“ありがとう”)在训练后完全走样。结果就是:用户问一句“日本的天气怎么样?”,模型可能回你:“Япония сегодня солнечно.”——俄语都冒出来了。

为什么?因为日语Token在中文对话数据里本就稀少,又被大量高频的英文、代码符号“淹没”。它们的向量被拉偏,和韩语、俄语的某些音节在空间里“撞在一起”,模型分不清了。

更荒诞的是,那些被搜索引擎滥用的垃圾词——“传奇私服”“无痛人流”“代写论文”——也集体“被遗忘”了。它们在预训练阶段满天飞,但在真实对话里没人提,后训练阶段直接被当成了噪音,模型越练越觉得:“这些词,根本没人用,删了吧。”

他们怎么修好的?不是靠“加数据”,而是靠“逼它练”

MiniMax没选择简单地“把马嘉祺的名字加进训练集”,而是做了三件事:

- 全词表“复读机”训练:哪怕一个词一个月只出现一次,他们也强制让模型在后训练阶段每轮都“念一遍”——哪怕只是重复“嘉祺 嘉祺 嘉祺”。结果,日语混淆率从47%直接降到1%。

- 混点“老教材”:在对话训练数据里,偷偷掺进10%的原始预训练语料——就是那些百科、新闻、论坛帖子。让模型别光学“聊天”,还得记得“词长啥样”。

- 砍掉没人用的词:把那些连训练数据里都从没出现过的冗余Token直接删掉,同时把“词表覆盖率”当成了新指标——就像考试不能只看作文,还得看字词基础。

现在,你再问“马嘉祺是谁”,模型能准确输出全名了。日语也基本不乱码了。但更重要的是,他们意识到:模型不是靠“知道得多”才聪明,而是靠“用得稳”才可靠。

真正的教训:AI不该只学“说话”,还得记得“写字”

这件事背后,是整个行业的一个盲区:我们太专注教AI“怎么聊天”,却忘了它首先要“认字”。

一个名字,一个日语词,一个被搜索引擎污染过的词——它们不是“噪声”,它们是语言的毛细血管。当你让AI只练“有用”的对话,它就会慢慢忘记那些“看起来没用”的表达。可谁知道,哪一天,用户会突然想问一句“嘉祺的新歌什么时候发?”

MiniMax说,未来不会再只看“对话流畅度”了。他们要加一个新标准:**你的模型,还记得多少个普通人会用的词?**

这不是技术问题,这是语言的尊严。