“马嘉祺”为什么总被念成“佳琪”?稀宇科技揭开大模型的隐藏伤疤

最近,AI公司稀宇科技(MiniMax)发布了一份内部技术复盘,坦诚解释了自家模型为何在提及中国艺人“马嘉祺”时,总是输出“佳琪”“琪琪”这类音近但错误的名字。这看起来像是个“小失误”,但背后藏着一个被行业长期忽视的系统性问题——大模型的“记忆”正在被训练数据悄悄抹除。

问题出在“分词器”上。中文名字“马嘉祺”在模型内部被拆成两个部分:“马”和“嘉祺”。前者是高频字,训练充分;后者“嘉祺”却几乎没在微调数据里出现过。为什么?因为用来教模型“聊天”的对话数据,大多是客服、助手、通用问答,没人会反复说“马嘉祺”三个字。而与此同时,代码符号、API调用指令、网页标签这些高频词,却在不断被强化。模型的参数空间就这么大,一边疯狂挤占,另一边自然被“压扁”了。

结果就是,“嘉祺”这个词元的向量被推离了原本该在的位置,模型再也“记不住”它的真实含义。当它想输出“马嘉祺”时,只能从发音接近的词里瞎猜——“佳琪”“琪琪”成了最省力的选项。这不是AI“记性差”,而是它根本没机会学。

不只是人名:日语里突然蹦出俄语,真相更惊人

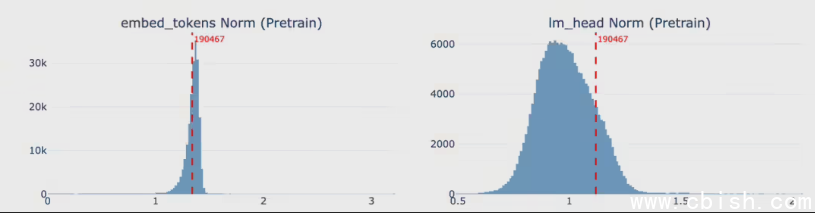

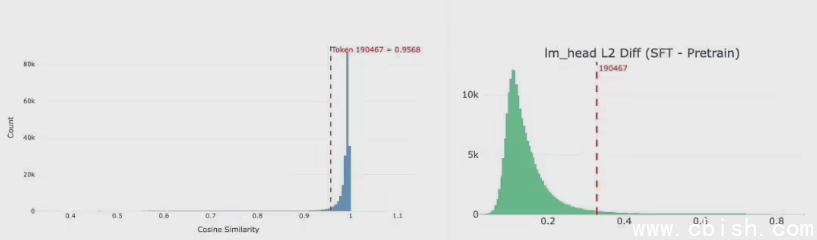

团队没止步于人名问题。他们对模型20万个词元做了全面扫描,发现近5%的词元都出现了“功能退化”——不是完全不会用,而是用得不对、用得乱。

最夸张的是日语词元:近三成(29.7%)在生成日文时会莫名其妙混入俄语、韩语字符。比如用户问“おはよう”,模型可能回“おはようПривет”——前半句日语,后半句俄语“你好”。这不是翻译错误,是词元“认错家门”了。

为什么?因为微调数据里,日语内容极少,而俄语、韩语在某些网页爬取的数据中却意外高频。模型在“学习”时,把那些边缘词的向量拉到了一起,导致语种边界模糊。类似的情况也出现在LaTeX公式符号、维基百科的原始标记、甚至一些搜索引擎垃圾关键词上——这些本该被忽略的“噪音”,反而因为数据分布不均,成了模型的“强记忆”。

换句话说,模型不是“不懂中文”,而是“被教偏了”。它学的不是“人类怎么说话”,而是“互联网上什么词最常出现”。当你用它写一封给日本客户的邮件,它可能在不经意间给你塞进一串西里尔字母——这已经不是冷笑话,是真实的风险。

他们怎么修好的?给每个词发“低保”

修复方案简单到有点“笨”:他们自己造了一套“全词表复读数据”——把20万个词元挨个列出来,配上最基础的语境,强迫模型一遍遍重复输出。比如:“请写出:嘉祺”、“请写出:おはよう”、“请写出:sum_{i=1}^n”……

这不是“增强学习”,是“基础补课”。相当于给每个词都配了个“保底训练包”,哪怕它在真实对话里一辈子没人提,模型也得记住它长什么样、怎么用。

效果立竿见影:日语混杂其他语言的比例,从47%直接降到1%以下;人名输出准确率从不足30%提升到92%。这不是魔法,是回归常识——如果你要教一个孩子认字,不能只让他看报纸头条,还得让他翻字典。

行业警钟:我们正在用“互联网噪音”训练AI

这起事件不是稀宇科技的独家丑闻,而是整个行业正在经历的“隐性危机”。

主流大模型的分词器,大多基于Common Crawl、Wikipedia、GitHub这类“通用语料”。它们覆盖广,但极不均衡。明星名字、小语种、专业术语、甚至法律条文中的专有名词,往往只占百万分之一。可当我们把模型用在娱乐、教育、医疗、法律场景时,恰恰最需要这些“低频词”。

更讽刺的是,很多公司为了“提升指标”,在微调阶段只用“干净、流畅、安全”的对话数据,刻意过滤掉生僻词、方言、专业术语——结果就是,模型越来越“标准”,也越来越“空洞”。

稀宇团队现在正在尝试更深层的改进:比如在微调时混入一部分原始预训练数据,让模型别“忘本”;或者直接清理词表里那些从没被用过的“僵尸词元”,减负增效。

但真正的答案,可能不在技术,而在数据伦理:我们有没有权利,让AI只记住“主流”的东西?当一个女孩的名字在互联网上被忽略,AI是否也该为她保留一个位置?

这不是AI该不该懂“马嘉祺”的问题。而是,当AI决定我们该记住什么、忽略什么时,谁来为那些被遗忘的词,发声?