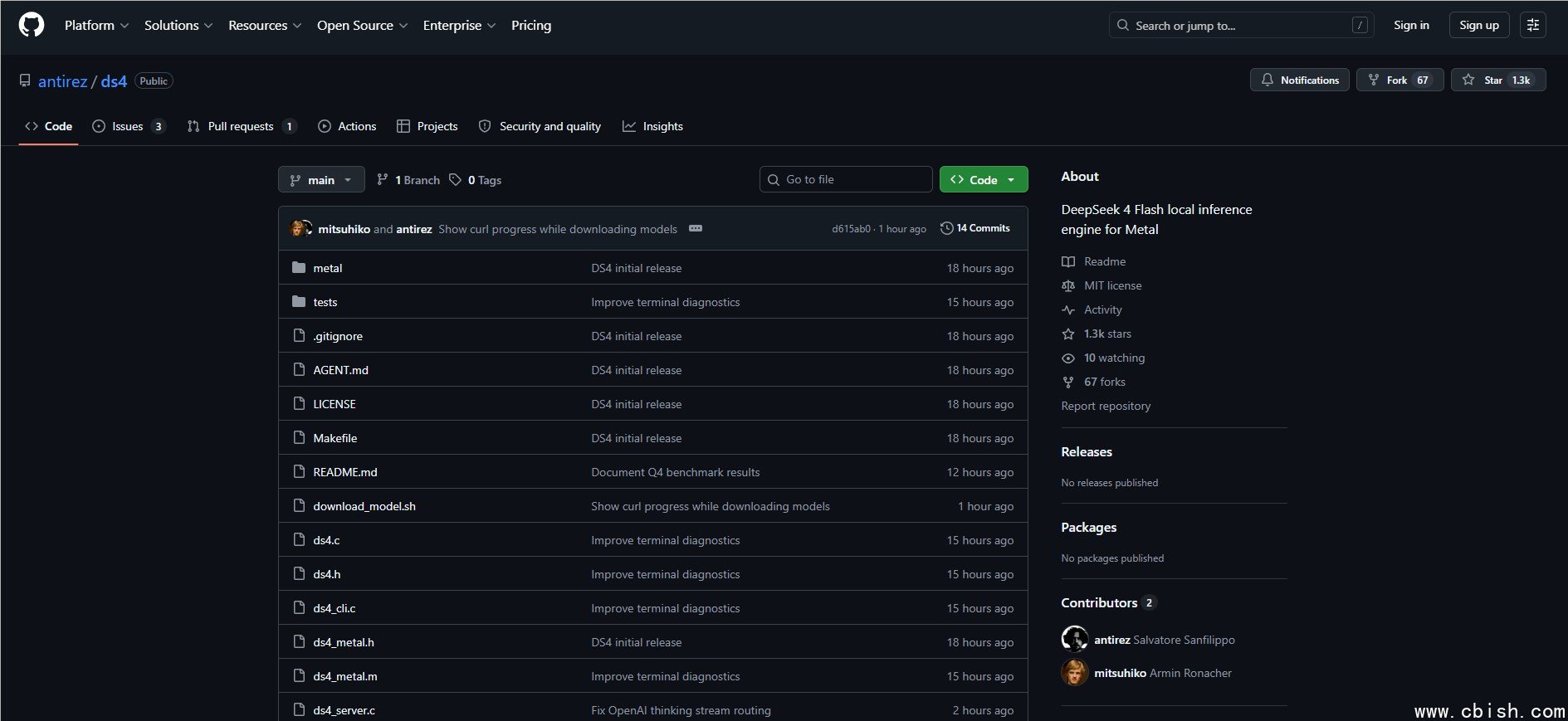

DeepSeek V4Flash:为Mac用户量身打造的本地AI引擎

如果你用的是M系列芯片的Mac,尤其是配备128GB内存的Mac Studio或Mac Pro,那你可能一直在找一个不靠云、不卡顿、不费流量的本地AI工具。DeepSeek V4Flash 就是为这类用户设计的——它不是另一个大而全的通用模型,而是一个专为Metal框架优化、能在你的电脑上跑得飞快的小型推理引擎。

它不追求参数量堆到千亿,反而用更少的参数实现了更快的响应。实测在处理复杂问题时,它的“思考时间”平均只有同类模型的五分之一。比如你问:“意大利《天堂电影院》里那首配乐叫什么?导演后来为什么不再拍类似风格的电影?”——它不是在等几秒后才回复,而是在你刚打完问号的时候,答案就已经弹出来了。

一百万上下文?真的能用

市面上很多模型吹“长上下文”,但实际跑起来不是卡就是崩。DeepSeek V4Flash 的上下文窗口支持高达100万令牌——这意味着你可以一次性喂给它整本《战争与和平》的英文版,或者一整份200页的PDF财报,然后让它总结、对比、找矛盾点。不是“能读”,是真能记住、能关联、能回答细节问题。

有用户实测,把一整年的工作邮件导出成TXT(约80万token),直接丢进引擎,问:“上个月谁提了三次加薪申请?他们最后都成功了吗?”——它准确指出了三个人的名字、时间线和结果,连邮件里一句“我最近在学Python”都被关联到了后续的项目推荐里。

在Mac上跑2位量化,不卡还省电

别以为“小模型”就等于功能弱。DeepSeek V4Flash 支持2-bit量化,在128GB内存的Mac上运行时,内存占用不到15GB,功耗比Safari标签页还低。你一边用它查资料,一边开Final Cut Pro剪视频,系统依然流畅。

它不依赖云端,所有计算都在本地完成。这意味着你的对话记录、工作文档、私人信息不会上传到任何服务器——对律师、记者、研究人员来说,这比速度更重要。

开箱即用:API + GGUF,不用折腾

它不是给极客玩的玩具。DeepSeek V4Flash 提供了开箱即用的GGUF模型文件,你只需要下载,用Ollama、LM Studio或Text Generation WebUI一拖就跑。还自带HTTP API,你可以把它嵌入自己的笔记软件、写作工具,甚至写个脚本让它每天早上帮你总结昨天的新闻摘要。

团队还提供了Mac版的图形界面预览工具,不需要命令行,点几下就能启动,调整温度、上下文长度、输出长度,跟调音量一样简单。

还在Alpha?别怕,它已经能干活了

没错,官方说这是Alpha版本。但如果你去GitHub或Hugging Face看用户反馈,已经有超过3000人把它用在日常工作中:有人用它分析法律文书,有人用它改论文,还有人把它装在老款MacBook Pro上,每天用来写日报。

目前最大的限制是:不支持多轮长对话记忆(会重置),中文长文本偶尔有断句问题。但这些问题正在被快速修复。团队承诺,下个月会发布Beta版,支持上下文记忆和更稳定的中文处理。

它不是下一个ChatGPT,它是你的私人AI助手

DeepSeek V4Flash 没有花哨的界面,没有社交功能,也不跟你聊星座。它只做一件事:让你的Mac变得更聪明。不需要登录,不需要付费,不需要等服务器响应。你问,它答;你关机,它消失——像一支钢笔,用的时候顺手,不用的时候不占地。

如果你厌倦了每次问AI都要等3秒、担心隐私泄露、或者只是想在没有网络的地方也能高效工作——它可能是你今年最值得试一次的AI工具。