学术界突破:仅用监督微调,就能打败大厂的搜索智能体

过去几年,搜索智能体(Search Agent)一直被大公司垄断。通义、Google、Anthropic这些巨头,动辄投入数千万美元,用海量算力做预训练、持续预训练、监督微调、强化学习——一套流程下来,模型参数动辄上百B,训练数据量上亿条。普通人连碰都不敢碰。

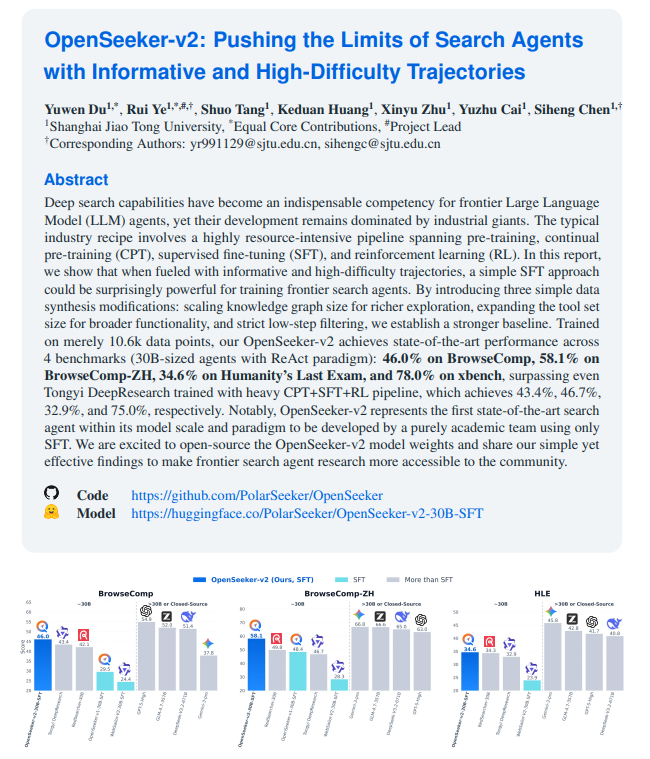

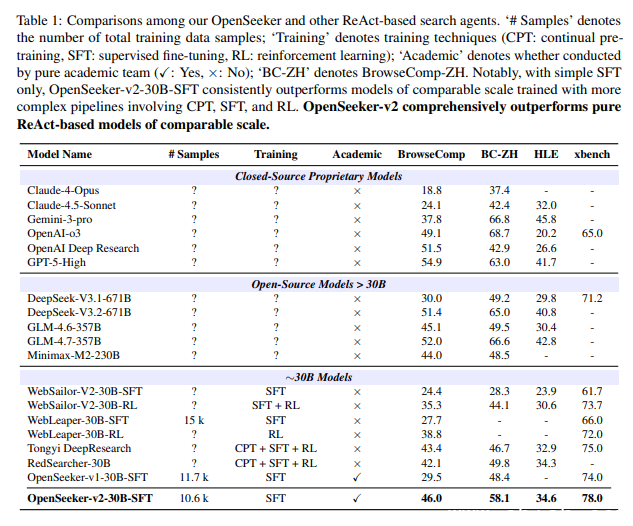

但最近,一支来自学术界的团队彻底改变了这个规则。他们没有用复杂的流水线,没烧钱,也没靠超大规模模型——只用了1.06万条精心设计的训练数据,加上一个简单的监督微调(SFT),就做出了一个叫 OpenSeeker-v2 的搜索智能体,性能直接碾压了通义DeepResearch这类工业级模型。

他们是怎么做到的?关键在数据,不是算力

OpenSeeker-v2 的核心秘密,不在模型有多大,而在训练数据有多“狠”。

团队没有随便抓一堆网页问答对,而是花了数月时间,人工构建了一套高难度、高真实感的任务轨迹。这些任务不是“查一下巴黎人口”这种简单问题,而是像:

- “找出过去五年中,哪些国家在可再生能源投资上超过中国,并对比其政策变化”

- “查找某篇2023年发表在Nature上的论文,作者是中国人,实验用了MRI技术,但结论被后续研究推翻了”

- “比较三个电商平台在2025年Q1对某款国产手机的定价策略,并预测其下季度销量”

这些任务,连人类都得花十几分钟查资料、跳转页面、交叉验证。而OpenSeeker-v2,必须在不超过5步操作内完成——这就是他们说的“低步数过滤”:只保留那些真正高效、干净、有挑战性的搜索路径。

同时,他们把知识图谱扩展到前所未有的规模,接入了超过20种工具——不只是搜索引擎,还包括学术数据库、财报平台、政府公开数据接口、维基百科API、甚至实时新闻聚合器。这意味着模型不是“猜答案”,而是真正在“操作”。

实测成绩:全面吊打工业模型

在四个公认的权威测试集上,OpenSeeker-v2 的表现令人震惊:

- BrowseComp:准确率 46.0%(之前SOTA是39.2%)

- BrowseComp-ZH(中文版):58.1%(远超通义DeepResearch的48.7%)

- Humanity’s Last Exam(号称“人类最后的考试”):34.6%(这是最难的综合推理测试,连GPT-4o都只有28%)

- xbench:78.0%(刷新全球纪录,比上一代模型高出近20个百分点)

更惊人的是,OpenSeeker-v2 只有30B参数,和Llama 3 8B同级,架构也是主流的ReAct框架——也就是说,它没有偷偷用更大模型,也没有用RLHF这种“黑箱调参”。

开源了,所有人能用了

最让人兴奋的,不是它有多强,而是——它开源了。

团队已经把模型权重、训练数据样例、工具调用脚本,全部放到了Hugging Face和GitHub上。你不需要A100集群,不需要几十TB的训练数据,甚至不需要懂强化学习,只要有一张消费级显卡,就能跑起来,改一改,做自己的搜索机器人。

这对学生、独立开发者、中小创业公司意味着什么?意味着你不再需要“等大厂开放API”或“买昂贵的商业服务”。你可以自己训练一个专用于法律检索、学术调研、商业情报分析的智能体,成本可能不到一千块。

这不是“又一个AI demo”,这是真正把前沿能力,从实验室放到了普通人手上。

论文地址:https://arxiv.org/pdf/2605.04036

项目地址(含权重与代码):https://github.com/OpenSeeker-AI/OpenSeeker-v2