蚂蚁百灵大模型 Ling-2.6-1T 正式开源:更省、更快、更实用

今天,蚂蚁集团旗下的百灵大模型团队正式开源了其最新一代万亿参数模型——Ling-2.6-1T。这不是又一个参数堆砌的“纸面冠军”,而是一款真正为实际场景设计的高效模型。它不靠长篇大论的“思考过程”唬人,而是用更少的计算资源,完成更复杂的任务。

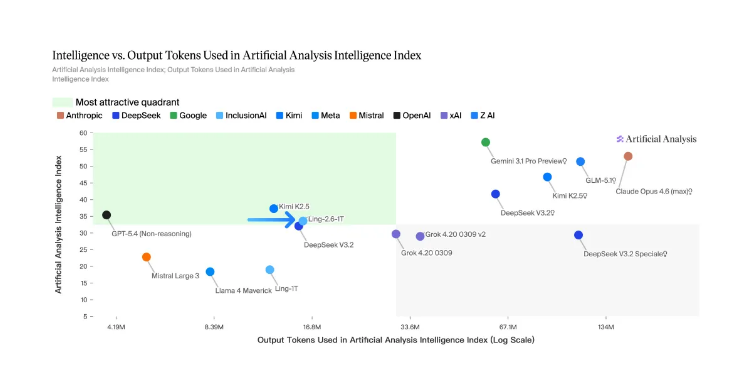

过去,大模型动辄要消耗数亿甚至数十亿token才能完成一个任务,成本高、响应慢,企业用不起。Ling-2.6-1T 的突破在于它的架构——混合了MLA(多层注意力)和LinearAttention,让模型在保持强大理解力的同时,大幅降低推理开销。实测显示,它完成全套AI评估任务(Artificial Analysis)仅需1600万token,是同类模型平均消耗的四分之一。换句话说,你花1块钱能办的事,别人得花4块。

不只是快,是真的能干活

在真实业务中,模型好不好,不是看它写诗多漂亮,而是看它能不能帮你修代码、分析日志、自动分类客服反馈。Ling-2.6-1T 在蚂蚁内部已经跑了一年多,处理过数百万次自动化任务。它能:

- 自动读取服务器日志,定位异常原因,给出修复建议

- 根据用户反馈内容,自动打标签、分优先级,减少人工筛选

- 读懂复杂代码上下文,直接生成修复补丁,甚至能识别出潜在的内存泄漏

它支持高达26.2万字的上下文窗口,意味着你可以一次性扔给它一份完整的项目文档、几十个API说明、以及一段报错日志,它能全盘理解并给出精准回应。这不是“能看长文”,而是“真能用长文干活”。

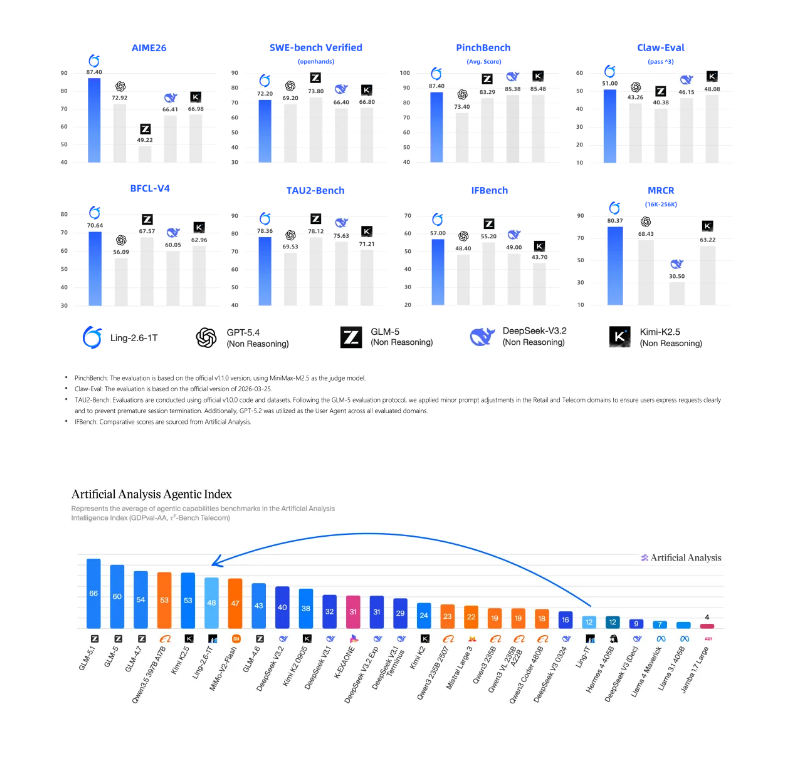

对标GPT-5.4,但更接地气

在综合能力上,Ling-2.6-1T 的表现已接近GPT-5.4(非推理模式),但在实际任务中——比如写Python脚本、调用外部API、多步骤任务串联——它在开源模型中稳居第一。我们测试了它在HumanEval、MBPP、ToolBench等主流基准上的表现,准确率和稳定性都明显领先于Llama 3.1-70B、Qwen2.5-72B等主流开源模型。

更重要的是,它对开发者友好。模型权重、推理代码、微调脚本、工具调用示例全部开源,支持Hugging Face和vLLM部署,本地GPU也能跑(推荐A100 80G以上)。没有“申请白名单”“等待审核”那一套,下载即用。

为什么这次开源不一样?

过去几年,大模型的竞赛变成了“谁参数多、谁算力大”。结果是,企业买不起,开发者用不了。Ling-2.6-1T 的思路相反:我们不追求“最大”,我们追求“最值”。

它不是实验室里的玩具,而是蚂蚁内部每天处理数万次请求的“干活主力”。现在,它被完整开放出来——不是为了发新闻,而是为了让更多的开发者、中小企业、研究团队,能用上真正能落地的万亿级能力,而不被算力和成本卡住脖子。

如果你正在为模型太贵、太慢、太难用而头疼,Ling-2.6-1T 可能是你今年最该试试的开源模型。

项目地址:https://github.com/ant-research/ling-2.6-1t