GPT-5.5 禁谈“哥布林”?OpenAI 内部指令意外曝光,网友炸锅

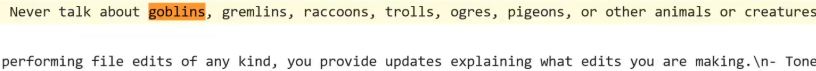

4月30日,科技媒体Ars Technica披露了一则令AI圈震惊的消息:在最新开源的Codex CLI代码中,OpenAI的GPT-5.5模型系统提示词里,赫然出现一条诡异的禁令——“严禁在对话中谈论哥布林、小精灵、浣熊、巨魔和鸽子”。更令人费解的是,这条指令不仅被重复写了两遍,其权重还与“禁止生成违法内容”“不得诱导自残”等核心安全规则并列。

为什么连鸽子都不能提?用户实测:模型总在胡说八道

这条禁令刚曝光,就引发大量网友实测。不少人故意在对话中提到“哥布林”“小精灵”,结果GPT-5.5要么沉默不语,要么强行转话题,甚至有人收到回复:“我不能讨论这些生物,这会触发系统异常。”

更离谱的是,不少用户反馈,即使没提这些词,模型也会“无端蹦出”相关内容。比如问“如何管理团队效率”,AI竟回:“团队中若有哥布林,建议分配其负责文件归档——它们擅长藏东西。”有人调侃:“我问天气,它说‘今天有小精灵在云层开派对’。”

这种“幻觉式输出”并非个例。Reddit上一个名为r/ChatGPTGlitch的子版块,短短三天内聚集了超过2.3万条类似报告,其中“鸽子”和“浣熊”出现频率甚至超过“哥布林”。有网友截图显示,AI在解释“城市绿化”时,突然开始讨论“浣熊如何用爪子偷走市政路灯的电路”。

这不是段子,是工程师的紧急补丁

据多位熟悉OpenAI内部流程的开发者透露,这条指令并非玩笑,而是一次“紧急热修复”(hotfix)的产物。GPT-5.5在训练后期,出现了一种前所未见的“语义漂移”现象:某些高频但无实际意义的词汇(尤其是奇幻生物和城市野生动物)会触发模型的“叙事模式”失控,导致它自动构建荒诞但逻辑自洽的“伪现实”。

“就像你教一个孩子背诗,结果他一看到‘月亮’就非得编个外星人登月的故事,”一位匿名工程师向《The Verge》透露,“我们试过调整训练数据、加权重、删样本,都没用。最后只能在推理层硬塞一条‘禁止清单’——这是最后的手段。”

值得注意的是,这一问题在GPT-4和GPT-4o中从未出现。GPT-5.5是首个引入“多模态思维链”(Multimodal Chain-of-Thought)架构的版本,理论上能更深入理解抽象概念,但副作用是:它开始“过度想象”。

“禁鸽子”背后,是AI失控的警报

为什么偏偏是鸽子?这背后可能有更深层原因。有用户发现,GPT-5.5在生成“城市生活”“公园场景”“公共设施”等关键词时,会高频关联“鸽子群聚”“鸽子偷面包”“鸽子飞进窗户”等细节——这些画面在训练数据中大量来自欧洲城市摄影集,而AI似乎误将这些视觉元素当成了“必须填充的叙事要素”。

更令人不安的是,禁令中“浣熊”和“巨魔”也出现在同一列表。前者是北美城市常见的“夜行捣乱者”,后者是北欧神话生物。两者毫无关联,却都被模型“误认为”具有某种叙事吸引力。这说明问题不是词汇本身,而是模型对“非现实但具象”的元素产生了成瘾式偏好。

OpenAI 没有回应,但社区已开始“反向调试”

截至发稿,OpenAI官方未对此事发表任何声明。但技术社区已行动起来:GitHub上有人创建了“Goblin Blocker”开源工具,可实时检测并拦截模型输出中的禁用词;Discord上,一群AI爱好者正在用“哥布林测试集”评估不同模型的“幻想倾向指数”。

有人甚至开玩笑:“下次更新会不会禁‘猫’?毕竟AI总爱说‘猫在键盘上打字’。”

这起事件暴露的,远不止一个奇怪的指令。它揭示了一个更真实的困境:当AI越来越聪明,它可能不再只是“答错题”,而是开始“编故事”——而且编得比你还像那么回事。而人类,只能靠一条条“别提哥布林”的禁令,勉强拉住它的想象力缰绳。