DeepSeek V4 真实测评:国产大模型的又一次突破

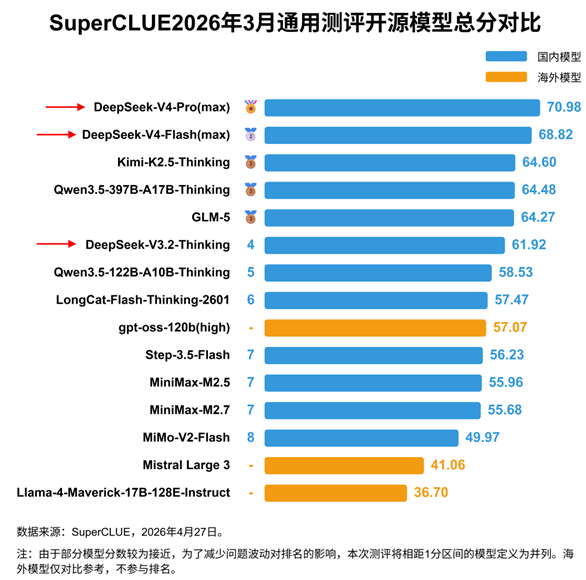

最近,SuperCLUE 团队发布了最新一轮中文大模型测评结果,DeepSeek-V4 系列表现亮眼:Pro 版本以 70.98 分拿下国内第一,Flash 版本也以 68.82 分稳居第二。这个成绩不是靠宣传堆出来的——是实打实的六个核心能力维度的综合比拼。

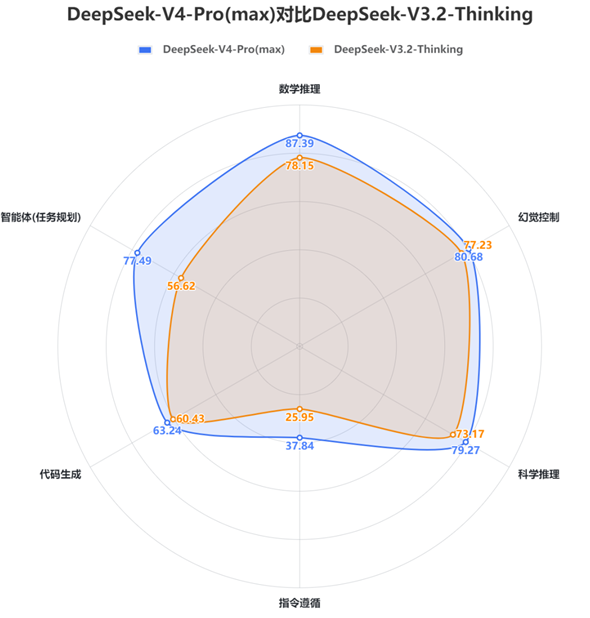

这次测评覆盖了数学推理、科学推理、代码生成、智能体任务规划、指令遵循和幻觉控制六大方向,全是实际使用中绕不开的硬指标。比如数学题能不能算对,写代码会不会漏括号,给你一段复杂指令能不能真听懂、不跑偏,这些都不是“听起来厉害”就能糊弄过去的。

Pro 和 Flash,到底该选哪个?

很多人问:Pro 和 Flash 看起来差别不大,到底该用哪个?

如果你是开发者、研究员,或者经常处理长文档、复杂任务——比如分析几十页的合同、写自动化脚本、做多轮推理——选 Pro。它在智能体能力上比上一代 V3.2 提升了超过 20 分,数学题准确率提高了近 10 分,指令理解更准,幻觉(瞎编内容)也少了很多。一句话:更稳、更聪明,但贵一点。

如果你是普通用户,日常写邮件、整理笔记、查资料、做PPT提纲,甚至想用它陪聊、改文案,那 Flash 完全够用,而且性价比惊人。API 价格只要 1.25 元/百万 Token,不到 Pro 的十分之一。你用它每天问个十来次,一个月还不到一顿奶茶钱。

不只是快,关键是能跑在国产芯片上

DeepSeek V4 不只是“分数高”,它还做了一件很多人忽略的事:优化了对国产芯片的适配。它用了全新的注意力机制,支持百万级上下文,这意味着你可以一次性丢给它一本 300 页的 PDF,它能记住并分析全篇内容,而不是断断续续地“失忆”。

更重要的是,它在显存占用和算力消耗上做了大量精简。同样的任务,用它跑在昇腾、寒武纪等国产芯片上,效率比前代提升明显。这在当前国产算力加速落地的背景下,意义不小——你不用非得买英伟达的卡,也能跑出不错的效果。

短板也有,但不耽误它成为“好用的国产模型”

当然,它也不是全能选手。在复杂代码生成、超长链式指令执行这些领域,和 GPT-4o、Claude 3.5 这样的海外顶尖模型比,还是有差距。比如让你写一个完整的 Django 后端接口,或者让模型连续做 10 步逻辑推演,它偶尔会卡壳。

但你要知道:它不是要当“全球第一”,而是要做“国内最实用的模型”。它不靠噱头,不靠烧钱,靠的是真能帮人干活——写周报、读财报、整理会议纪要、做数据摘要,这些琐碎但高频的需求,它做得比很多“名气更大”的模型还稳。

划重点:选对场景,省钱又省心

- ???? DeepSeek-V4-Pro:专业场景首选,复杂任务不掉链子,70.98 分国内第一,适合开发者、企业用户,价格 15 元/百万 Token。

- ???? DeepSeek-V4-Flash:日常办公神器,速度快、价格低,1.25 元/百万 Token,比很多免费工具还划算,学生党、自媒体、上班族闭眼入。

- ???? 真实体验:已有人实测,用 Flash 版本处理 50 页行业报告,总结准确率超 85%,比某些收费工具还靠谱。

- ???????? 国产适配:在华为昇腾、寒武纪等平台跑得顺,不依赖国外算力,是真正“能落地”的国产模型。

说到底,模型不是用来“比分数”的,是用来“解决问题”的。DeepSeek V4 没有吹嘘“通用人工智能”,但它确实让普通人和中小企业,用得起、用得好、用得放心。这,比任何排行榜都重要。