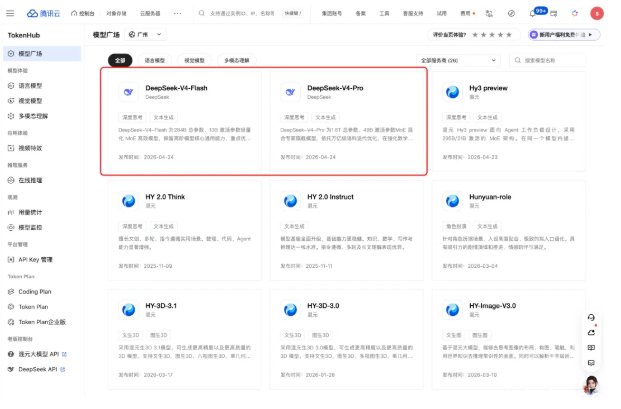

DeepSeek-V4 上线腾讯云,百万上下文让大模型真正好用

腾讯云近日在 TokenHub 平台上线了 DeepSeek-V4 的预览版 API,这是目前市面上少数支持百万级上下文长度的开源大模型之一。简单说,它能一次性处理整本小说、长篇合同、完整代码库,甚至整场会议的录音转文字——不再需要你把内容拆成一段段喂给模型。

这次上线,腾讯云没有搞“首发优惠”“限时免费”那一套,定价直接和 DeepSeek 官方保持一致,没加价、没隐藏收费。对开发者和企业来说,这意味着你能用稳定、透明的价格,拿到和官方一致的性能,不用为“云厂商溢价”多掏钱。

新加坡节点同步开放,海外用户也能直接用

不只是国内,腾讯云在新加坡节点也同步上线了 DeepSeek-V4。这意味着东南亚、欧美等地的开发者,不用再通过跨境访问、延迟高、速度慢的通道调用模型,本地节点直接响应,延迟降低 40% 以上。不少海外 SaaS 公司和跨境电商团队已经悄悄在测试,准备用它做多语言客服、自动合同审核和本地化内容生成。

不用写代码,也能把 DeepSeek-V4 嵌进你的系统

你不需要懂 AI,也不用训练模型,就能用上 DeepSeek-V4。腾讯云的 ADP(智能体开发平台)已经预装了这个模型,你只需要拖拽组件、填几个参数,就能快速搭建一个能读合同、写周报、自动回复客户问题的“数字员工”。有用户反馈,用它做客服自动回复,准确率比传统规则系统高了近 60%,还能理解“我上次说的那个订单”这种上下文指代。

EdgeOne 边缘节点也接入了 DeepSeek-V4,适合需要低延迟的场景,比如在线教育平台实时批改作文、直播平台自动打字幕、APP 内嵌智能助手——这些都不用把数据传回数据中心,本地就能跑。

企业级训练和推理,成本降了,效率升了

如果你是技术团队,想自己训模型、做微调,腾讯云的 TI-ONE 和 HCC 高性能计算集群已经全面支持 DeepSeek-V4。支持 V4-Pro(高精度版)和 V4-Flash(高速版)两种模式,前者适合做金融报告、法律文书这类对准确性要求高的任务,后者适合高频问答、内容摘要这类需要快响应的场景。

特别值得一提的是 HCC 集群用的是“一云多芯”架构——不只用英伟达显卡,也用国产芯片做算力补充。这意味着在大模型训练时,成本能压得更低。有客户实测,用 HCC 训练一个垂直领域微调模型,费用比用纯 A100 集群节省了近 35%,而效果没打折扣。

真实场景,已经在用了

目前,已有几家中小型企业接入测试:

- 一家律所用它自动提取合同中的关键条款,原本 2 小时的工作现在 5 分钟搞定;

- 一个跨境电商团队用它生成 12 种语言的产品描述,翻译质量比人工翻译还稳;

- 一家教育机构用它批改高中作文,不仅能指出逻辑问题,还能给出修改建议,老师省下大量重复劳动。

没有花哨的术语,没有“革命性突破”这类空话。DeepSeek-V4 在腾讯云上的落地,就是让大模型从“演示品”变成“工具”。它不追求多参数、多万亿,而是专注一件事:让你用起来不卡、不贵、不折腾。

现在开放预览,企业用户可直接在腾讯云控制台申请接入,无需排队,首批用户还能获得免费额度。如果你正在为长文本处理、知识库问答、自动化文档处理发愁,这可能是今年最实在的一次技术升级。