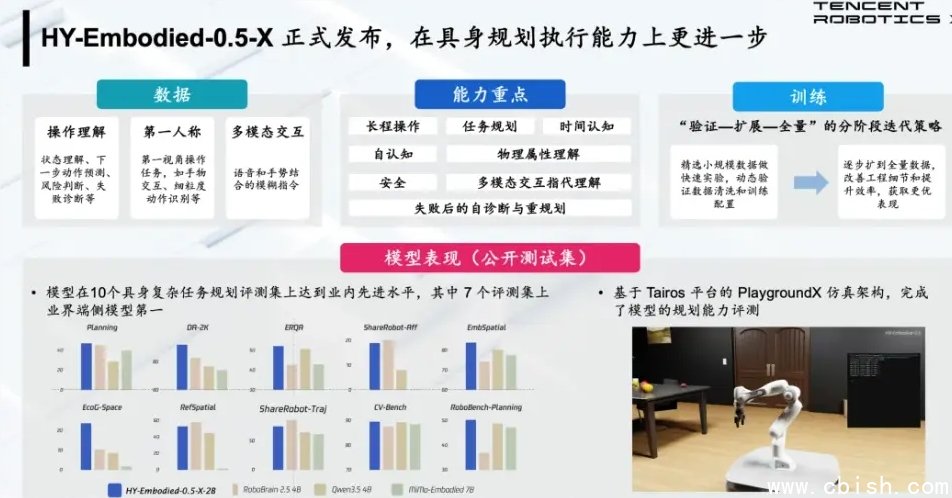

腾讯发布全新机器人大模型 HY-Embodied-0.5-X,让机器人真正“看懂”并“动手”

近日,腾讯 Robotics X 实验室联合混元团队正式开源了 HY-Embodied-0.5-X,这是一款专为真实场景设计的机器人多模态大模型。它不再只是能“看”和“说”,而是能真正理解环境、规划动作、完成精细操作——比如帮你拿遥控器、整理桌面、识别杯子是否放稳,甚至判断哪个动作可能打翻东西。

这个模型的核心,是让机器人从“实验室演示”走向“日常使用”。过去很多机器人系统在可控环境下表现不错,但一到真实家庭或办公室,就容易卡壳:听不懂“把那本书递给我”里的“那本”是哪一本;分不清咖啡杯和水杯;动作太猛把东西碰倒。HY-Embodied-0.5-X 就是为解决这些问题而生。

两个版本,一个目标:端侧能跑,云端更强

HY-Embodied-0.5 系列分两个版本:MoT-2B 和 MoE-32B。前者只有20亿参数,专为机器人本体设计,能在嵌入式芯片上实时运行,响应速度快,适合家用机器人、服务机器人这类对延迟敏感的场景。后者320亿参数,跑在云端,处理复杂任务更稳,比如同时规划多个动作、理解长指令、处理多步骤任务。

这次开源的是 HY-Embodied-0.5-X,它基于 MoT-2B 架构优化而来,重点打磨了“动作-视觉-语言”的协同能力。简单说,它能一边看摄像头,一边听你说“把左边那个蓝色的杯子拿过来”,一边计算手要怎么伸、怎么抓、怎么放,还不碰倒旁边的手机。

训练数据,不是靠“抄”来的

很多人以为大模型靠爬网页就能练好,但机器人不一样。HY-Embodied-0.5-X 的训练数据里,有超过70%来自腾讯自建的机器人操作实验室——用真实机器人在模拟家庭、办公桌环境里一遍遍做动作,录下第一视角画面、手部动作、语音指令和失败案例。

团队还整合了公开的具身数据集,比如 RobotX、Ego4D 等,但做了大量清洗和标注。比如,不是简单标注“拿杯子”,而是标注“杯子在右前方,手要先绕开咖啡机,用拇指和食指捏杯柄,抬高5厘米避免碰倒纸巾盒”。这些细节,才是让机器人不“手忙脚乱”的关键。

他们还引入了“思维链标注”——把机器人的决策过程像人一样写出来:“先看杯子在哪→判断是否稳固→计算抓取点→避开障碍→执行动作→确认是否成功”。这种结构化思维,让模型不再“黑箱操作”,训练更可控,错误更少。

训练方式很“笨”,但很有效

团队没用那种“一口气上万张卡狂训”的方式,而是分阶段来:

- 第一步:用几百个高质量、标注精细的小样本,调通整个训练流程,确保每个环节都跑得通;

- 第二步:逐步扩大数据量,加入更多噪音、模糊指令、干扰场景,测试模型鲁棒性;

- 第三步:才在真实机器人上跑测试,反复迭代。

这种“慢工出细活”的方式,让模型在面对“把桌上的东西收一收”这种模糊指令时,也能主动问:“是收进抽屉,还是放回原位?”而不是乱抓一通。

能干啥?不只是“炫技”

HY-Embodied-0.5-X 不是为比赛设计的。它的目标很实际:

- 在家庭里,帮老人拿药、递水、整理杂物,不靠预设程序,能适应每天不同的摆放;

- 在办公桌场景,自动识别你刚用完的笔、鼠标、笔记本,归位或提醒你带走;

- 能判断“这个动作危险”——比如伸手去拿热咖啡时自动减速,或发现地面有水渍会绕行。

目前,该模型已在腾讯内部的家用机器人原型机上落地测试,部分功能已进入灰度体验阶段。团队表示,未来会开放部分API和模型权重,供开发者和研究者在真实机器人平台上试用。

这不是噱头,是机器人走向实用的第一步

过去几年,大模型火了,机器人也跟着喊“多模态”“具身智能”,但多数停留在视频演示。HY-Embodied-0.5-X 的特别之处,在于它不追求参数多、跑得快,而是追求“不犯错、能干活、懂人话”。

它不炫技,但很靠谱。如果你家机器人终于能听懂你随口说的一句话,而不是非得按固定指令才能动——那才是真正的进步。