浏览器也能跑大模型?Gemma4 现在直接在 Chrome 里干活

你可能以为AI模型都得靠云端、要登录账号、扣积分,但现在,一个叫Gemma4的模型,已经能直接在你的浏览器里跑起来了。不需要安装任何软件,不用注册账号,甚至不用连网——只要用最新版的Chrome(134以上),打开网页,就能让它帮你画流程图、写文案、整理思路。

这个变化不是靠更贵的服务器,而是靠一套叫TurboQuant的新技术。它把模型“记笔记”的方式彻底改了。以前模型聊天越久,内存越撑不住,像一个人边说话边堆满纸条,越堆越乱。现在,TurboQuant把那些“纸条”压缩到原来的六分之一大小,还能直接在压缩状态下翻看、引用,不拆包、不卡顿,对话能记住几十轮,反应也更快。

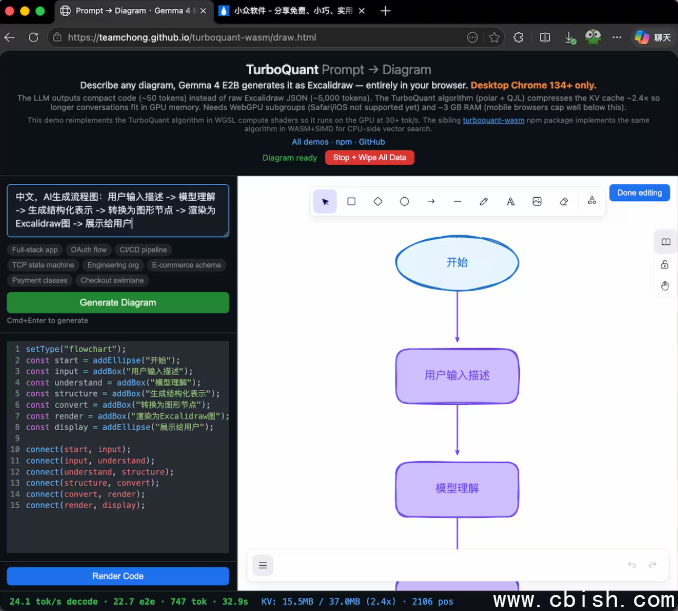

32秒,画一张能用的流程图

我们实测了一个基于这套技术的网页工具:打开页面,输入“画一个电商订单处理流程图”,不到一分钟,一张带箭头、有节点、结构清晰的Excalidraw风格图就出来了。耗时32.9秒,平均速度每秒24个词,跟手机打字差不多快。

关键是,这图不是从服务器拉来的模板,是模型现场“想出来”的,而且全程在你电脑里运行。没有上传数据,没有后台计费,不消耗任何云服务额度。你用它写周报、整理会议纪要、画产品逻辑,完全不用担心隐私泄露或账单突增。

能用,但不是所有人都能立刻上手

这套方案听着很美,但现实没那么轻松。第一次用,浏览器要下载一个3.1GB的模型文件——相当于装一个中等大小的视频游戏。如果你的电脑内存低于8GB,或者用的是老旧的MacBook Air、低配Windows本,可能会卡顿,甚至跑不起来。

另外,目前只支持Chrome 134+,Firefox、Safari还不行。Edge虽然基于Chromium,但部分用户反馈需要手动开启WebGPU功能。如果你是普通用户,只想点个按钮就用,那还得再等等。但如果你是设计师、产品经理、学生,或者经常需要本地处理文档的人,这已经是个能真正替代部分付费工具的选项了。

未来会变成主流吗?

这不是噱头,而是趋势的起点。过去我们觉得AI必须在云上,因为模型太大、算力太贵。但现在,Google、Meta、苹果都在悄悄往“本地化”走——iPhone 16 rumored支持本地运行7B模型,微软的Copilot+PC也主打“AI在本地”。

TurboQuant + WebAssembly这套组合,证明了:只要算法够聪明,普通电脑也能扛起大模型。它不靠烧钱的GPU集群,而是靠压缩、优化、精打细算。这对用户意味着什么?

- 再也不用担心AI工具突然涨价

- 敏感内容不用传到服务器,老板的计划、客户的隐私,自己说了算

- 没网也能用,出差、地铁、地下室,照样能写能画

未来三年,我们可能会看到越来越多“离线AI工具”——不是App,不是插件,就是一个网页。你打开它,它就在你电脑里运行,用完关掉,不留痕迹。这或许才是AI真正该有的样子:不是云端的神,而是你手边的工具。