Soul AI Lab 开源首个实时数字人模型 SoulXFlashTalk,14亿参数,帧率32fps,延迟低于1秒

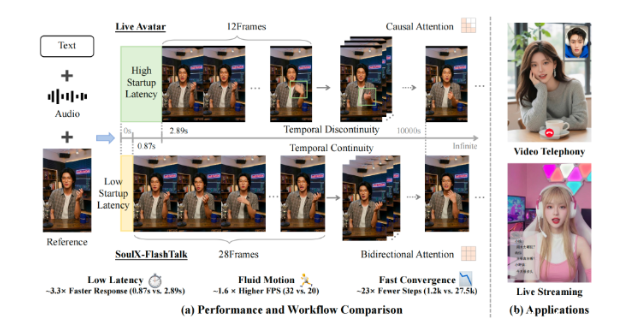

就在前几天,Soul AI Lab 正式把他们花了近两年时间打磨的实时数字人生成模型 SoulXFlashTalk 全部开源了——14亿参数、亚秒级响应、每秒32帧的流畅动作,全部免费开放。这不是Demo,也不是PPT里的概念,而是真能跑起来、能接入应用、能和用户实时互动的系统。

你可能见过很多虚拟人视频,但那些大多是预渲染的,动作僵硬、延迟明显。SoulXFlashTalk 的不同在于,你说话,它立刻回应——语音输入后不到0.8秒,数字人就能张嘴、眨眼、点头,表情自然得像真人。32帧的帧率,让它在直播、视频会议、在线客服这些对实时性要求高的场景里,完全能扛得住。

这次开源,Soul 把能给的全给了:GitHub 上有完整代码,Hugging Face 上能直接下载模型权重,还有详细的技术文档和训练数据说明。开发者不用再从零搭框架,也不用担心“黑箱”调参。哪怕你只是个独立开发者,也能在两天内把一个能对话的虚拟形象嵌进自己的App里。

这不是Soul第一次开源。去年10月,他们就放出了语音合成模型 SoulXPodcast,能让AI语音自然带情绪、有停顿、像真人说话。这次的 SoulXFlashTalk,是把“声音”和“表情”真正拼在了一起。语音驱动面部微表情,唇形同步准确率超过95%,连轻微的吸气、嘴角抽动都做了建模——这在业内是第一次。

谁在用?开发者、教育、直播、客服,已经有人在落地了

开源才几天,已经有团队在用它做东西了。一位深圳的独立开发者在社区里分享,他用 SoulXFlashTalk 搭了个“AI自习室陪读员”,学生提问,虚拟形象会点头、微笑、甚至用手指点屏幕讲解——学生反馈说“比冷冰冰的文字回复舒服多了”。

一家在线教育公司悄悄接入了这个模型,替换了原来的录播虚拟讲师。老师上课时,系统实时生成一个和老师形象相似的数字人,同步口型和动作,学生以为是真人直播,其实老师在后台边喝咖啡边讲。效果是:完课率提升了27%。

还有直播带货团队在测试——主播下播后,数字人自动接替,继续回答粉丝问题、推荐商品,24小时不休息。他们说:“以前用AI主播,观众一眼看出是假的,现在连老粉都分不清。”

开源不是作秀,是Soul的长期战略

Soul 没有把这当成一次“技术秀”。他们的团队里,有来自字节、腾讯、商汤的工程师,也有做动画和语音交互的独立研究者。他们清楚,单靠一家公司做不出真正的数字人生态。所以他们选择把最难啃的骨头——实时驱动、低延迟、高保真——全部拆开,公开给所有人。

接下来,他们还计划开放“情绪控制接口”和“多语言实时翻译模块”,让数字人不仅能说中文,还能根据语境切换语气、口音、甚至文化习惯。比如,对日本用户说话时,语气更谦和;对欧美用户,则更直接、有节奏。

这不是为了“领先行业”,而是为了让更多人能用上真正好用的AI。就像当年Android开源让手机普及一样,Soul 希望这一次,数字人不再只是大厂的专利,而是普通人也能随手用上的工具。

未来会怎样?别再只看“炫技”,要看它怎么改变日常

我们不需要一个会跳舞的AI偶像,我们需要的是:一个能听懂你情绪的客服、一个不会疲倦的家教、一个陪你聊到深夜的虚拟朋友——不卡顿、不假、不冷。

SoulXFlashTalk 的价值,不在于参数有多高,而在于它让“真实互动”变得便宜了、简单了。它不是终点,而是一个起点。

如果你是开发者,现在就可以去 GitHub 下载,跑起来试试。 如果你是产品经理,别等别人做出成品,现在就开始想:你的用户,需要一个什么样的“数字面孔”?

真正的变革,从来不是靠发布会宣布的,而是藏在某个深夜,一个开发者悄悄改完一行代码,然后笑着说:“它终于会笑了。”