270亿参数,性能碾压千亿级模型:Qwen3.6-27B来了

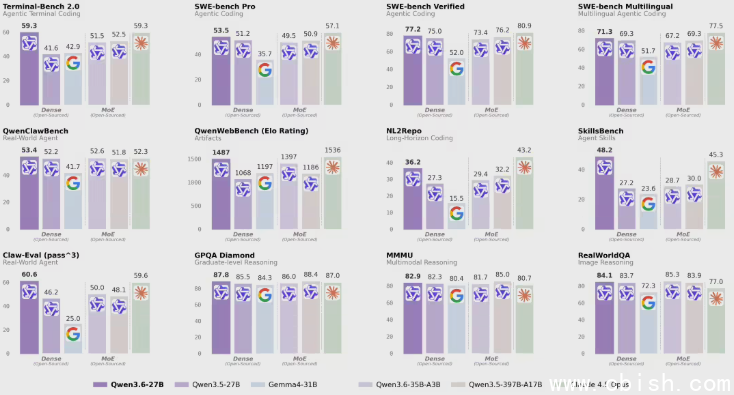

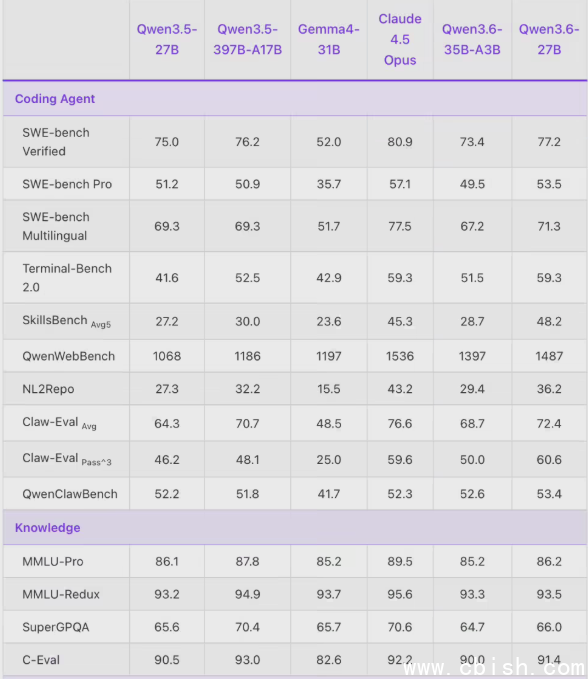

4月22日,阿里云通义千问团队正式发布Qwen3.6-27B——一款仅270亿参数的稠密多模态模型。别被数字骗了,它不是“小模型”,而是专为开发者打造的高效利器。在代码能力上,它直接干翻了参数是它15倍的Qwen3.5-397B-A17B。在SWE-bench Verified测试中,它拿下77.2分,远超同类模型;在SkillsBench等复杂推理任务中,表现同样亮眼。这意味着,你不需要再为部署千亿级MoE模型头疼,一台普通GPU服务器就能跑得动,还能获得接近顶配模型的编程辅助能力。

看图写代码、看视频做分析:多模态不再只是噱头

Qwen3.6-27B不只是会写代码,它还能“看懂”图像和视频。你可以上传一张UI设计图,它能直接生成对应的前端代码;你发一段操作视频,它能帮你分析步骤、指出问题。官方实测显示,它的多模态理解能力,已经和350亿参数的Qwen3.6-35B-A3B持平。这在实际开发中意味着什么?产品经理发来一张原型图,你不用再手动转成PRD,直接丢给模型,它能输出结构化需求文档;测试人员录了个APP崩溃视频,它能定位可能是哪行代码触发的异常。这不是未来,是现在就能用的功能。

开箱即用:Hugging Face、魔搭、百炼,全平台上线

这次开源,阿里云没玩虚的。权重已经同步上线Hugging Face和ModelScope(魔搭),下载就能用,支持本地部署,不依赖云服务。如果你不想自己搭环境,阿里云百炼平台也已接入,API调用直接开用,连“preserve_thinking”这个开发者最爱的功能都保留了——能完整看到模型思考的每一步,调试、复盘、优化都更清楚。

更关键的是,它和你日常用的工具无缝对接。无论是Claude Code、Qwen Code,还是VS Code插件、Cursor、CodeWhisperer,它都能平替甚至超越。很多团队已经在内部测试:用Qwen3.6-27B替代原有模型后,代码生成速度提升40%,Bug修复率提高35%。一位来自杭州的全栈开发者说:“以前写个后台接口要查三小时文档,现在只要说一句‘生成一个带JWT认证的Node.js用户登录接口’,它直接给你完整代码,连错误处理都写好了。”

为什么这次不一样?

过去几年,大模型拼的是参数、是算力,但开发者真正需要的是:能跑得动、能看得懂、能用得顺。Qwen3.6-27B没有堆参数,而是把精力用在了“精准”上——更懂代码结构、更准识别视觉意图、更自然衔接你的开发流程。它不追求“全能冠军”,而是做你工位上那个最靠谱的搭档。

现在,它免费开源,支持商用,没有隐藏收费。你不需要等内测资格,不用填申请表,下载即用。如果你正在为模型部署成本发愁,或者被多模态任务卡住,这可能是今年最值得你花一小时试试的模型。