开源监控平台厂商Grafana Labs发布AI Observability in Grafana Cloud,目前进入公开预览阶段。该功能将AI代理的对话记录、工具调用、token用量与输出质量评估,整合进现有的Grafana Cloud可观测性环境,让开发团队能够实时监控代理行为、持续评估输出是否符合预期,并在潜在风险出现前提前收到告警,无需额外导入独立工具。

Grafana Labs指出,传统可观测性工具的不足在于,当AI代理在生产环境中运行时,开发团队往往难以仅依靠现有的指标、日志记录与追踪数据判断输出质量与行为是否出现偏差,问题常常要等到响应质量下降或用户反馈后才被发现。

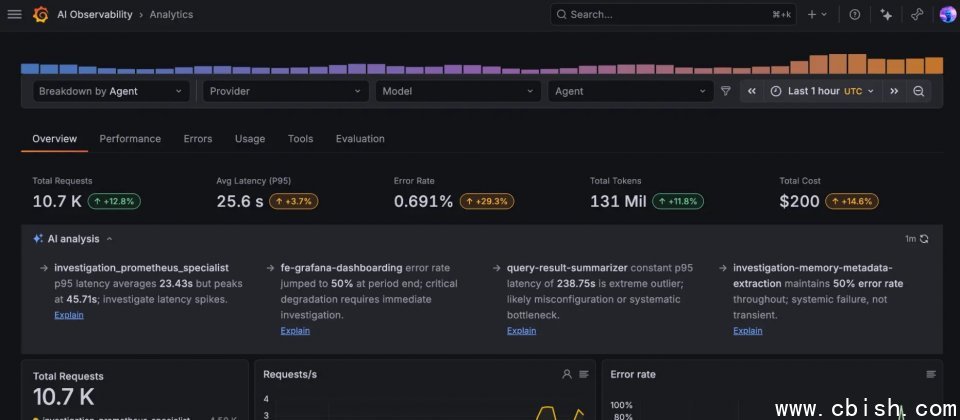

AI Observability in Grafana Cloud的做法是将代理对话与会话纳入主要遥测信号,兼容OpenTelemetry标准。开发者完成配置后,平台会采集对话内容、模型与供应商元数据、工具使用情况、延迟、词元用量与推理成本。这些数据均可在同一界面中按模型、供应商、时间区间、标签或环境条件进行筛选与查询。

输出质量评估支持三种方式,包括LLM-as-a-judge、启发式规则与正则表达式,可用于检测低质量响应、政策违规或异常行为模式,并通过Grafana Alerting原生功能发出告警。平台还具备潜在风险检测能力,例如识别响应中是否出现凭证泄露,或是否存在异常使用模式。

AI Observability还提供版本管理功能,当开发者修改代理的系统提示词或工具集时,平台会自动创建新的代理版本,让团队能够分别追踪不同版本的表现差异,找出性能最优的配置,也能更精准地定位特定变更引发的问题。

当需要进一步调试时,开发者可通过Grafana Assistant以自然语言查询,交叉查看AI数据与其他遥测信号,协助分析延迟尖峰的原因,或找出成本较高的操作与工具。若结合代理专属操作手册(Runbook),当代理出现异常行为时,用户也可直接要求助手阅读手册并提出修复建议。

除了AI Observability in Grafana Cloud,Grafana Labs还发布Grafana Cloud CLI(GCX),这是一套支持自动化与代理驱动工作流的命令行工具;同时推出开源基准测试工具o11y-bench,用于评估AI代理执行可观测性工作流程的性能表现。