Qwen3.6-35B-A3B开源:350亿参数,只用30亿跑,开发者直呼“真香”

4月19日晚,阿里通义千问团队正式开源了Qwen3.6-35B-A3B——一款参数量高达350亿、却只需激活30亿就能高效运行的中等尺寸模型。没有冗长的术语堆砌,也没有浮夸的“颠覆性”宣传,它用实实在在的表现,让无数被算力卡脖子的开发者松了口气。

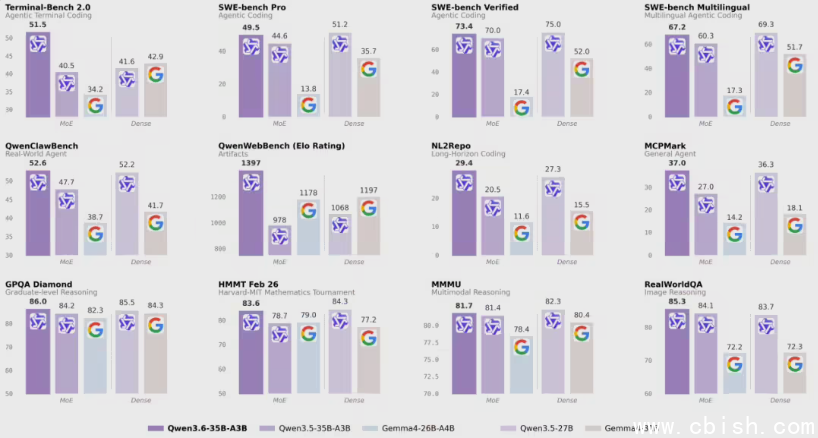

过去,想跑一个接近GPT-4水平的模型,动辄需要8张A100,电费和租云成本让人望而却步。而Qwen3.6-35B-A3B用MoE(混合专家)架构实现了“按需调用”——每次推理只激活一小部分专家模块,相当于你请了10个专家开会,但每次只叫3个人来解决问题。结果呢?在Terminal-Bench2.0编程能力测试中,它比Llama 3.1-70B还稳;在Agent真实任务评估里,完成复杂多步操作的准确率直逼千亿级模型。不少开发者实测后在社区留言:“我用一张4090跑起来了,还能同时开个IDE写代码。”

不只是会写代码,它还能“看懂”图片

很多人以为大模型就是写代码、答问题的“文字高手”,但Qwen3.6-35B-A3B悄悄升级了视觉理解能力。它现在能看图识物、定位坐标、理解空间关系——不是靠预训练的图像编码器硬套,而是真正“思考”图像内容。

在RefCOCO这类需要精准定位“穿红衣服、拿咖啡杯的男孩”这种复杂描述的测试中,它的准确率超过了许多专为视觉设计的模型。有开发者拿它测试自家智能家居系统的图像指令:比如“把客厅左侧的花瓶移到茶几上”,它不仅能识别出物体,还能推断出“移动路径”和“可能的遮挡关系”。这在工业质检、机器人视觉、AR导航等场景里,几乎是直接能用的生产力工具。

不用改代码,直接接入你正在用的工具

最让开发者心动的,不是模型多强,而是它“好用”。

Qwen3.6-35B-A3B已经原生支持OpenClaw、Claude Code、AutoGen等主流Agent框架。你不用重新训练、不用改接口,只要把模型路径换一下,你现有的自动化脚本、智能客服、代码助手,立马就能升级。有团队用它替换了之前跑在云端的GPT-4o,本地部署后,响应速度从2.3秒降到0.8秒,月省云服务费超4万元。

有人在GitHub上分享了自己用它搭建的“个人AI助理”:每天早上自动读邮件、写日报、整理会议纪要、查股票新闻,全部在本地MacBook Pro上跑,不传任何数据出去。评论区一片“求教程”。

现在就能下,免费、开源、无门槛

你不需要申请权限,不需要企业认证,不需要填表等审核。今天就能去:

- 魔搭社区(ModelScope)下载完整权重

- Hugging Face直接在线试用

- Qwen Studio一键部署到本地或云服务器

模型支持GGUF、FP8、AWQ等多种量化格式,NVIDIA、AMD、甚至苹果M系列芯片都能跑。有人在M2 Max上用4-bit量化,跑得比之前在RTX 4090上还顺。

这不是实验室里的玩具,也不是PPT里的未来。它是一个真实能跑、能用、能省钱、能替代商业API的工具。如果你还在为API调用费、响应慢、数据隐私发愁——这次,国产模型真的给出了答案。