AI算力爆发,光模块市场迎来“黄金期”

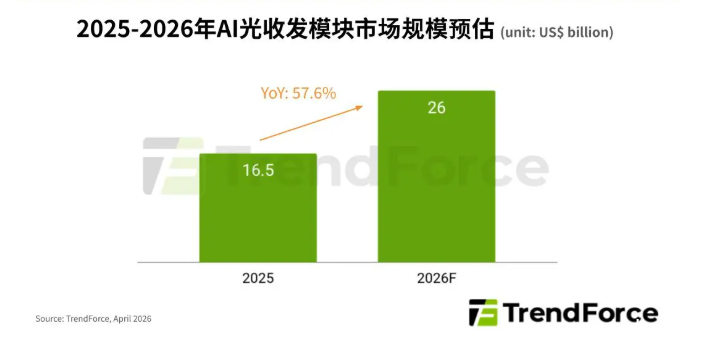

根据TrendForce集邦咨询最新数据,全球AI专用光收发模块市场正以惊人速度扩张。2025年市场规模为165亿美元,到2026年将飙升至260亿美元,年增长率突破57%。这不是简单的技术迭代,而是整个数据中心基础设施在AI浪潮下的全面重构。

驱动这一增长的核心,是AI服务器集群对高速互联的刚性需求。如今,单个AI训练集群动辄搭载数千颗GPU,节点间数据交换频率极高,800G及以上速率的光模块已成为标配。北美三大云厂商——Google、Microsoft和Meta——的AI数据中心流量年增速持续保持在30%以上,它们的采购节奏直接决定了光模块的产能走向。

产能跟不上?关键部件卡脖子

市场热得发烫,但扩产却步履维艰。光模块的核心器件——电吸收调制激光器(EML)和连续波激光器(CW-LD)——产能严重不足。全球能稳定量产高端EML的厂商不超过五家,且多数集中在日本和欧洲,供应链高度集中。一旦某家工厂因设备检修或原材料短缺停产,整个行业都会跟着“喘不过气”。

更棘手的是制造工艺。光模块内部的光学对准精度要求达到微米级,一台高精度贴片机一天最多只能完成几百个模块的组装,人工调试耗时长、良率波动大。有业内人士透露,部分厂商为赶订单,不得不把原本计划用于800G模块的产线临时“降级”生产400G产品,以维持基本交付。

功耗和散热同样是“隐形杀手”。一套800G光模块在满载运行时功耗可达12W以上,1.6T模块甚至接近20W。在动辄数万颗模块并行运行的数据中心里,这直接推高了电费和冷却成本。有数据中心运营方坦言:“我们宁可多花20%的采购预算,也要选功耗低15%的型号。”

巨头改策略:不靠现货,签长单、换技术

面对供应风险,NVIDIA、AMD、思科、华为等头部企业早已不再“等米下锅”。他们开始与光模块厂商签订3–5年的长期采购协议,锁定核心器件产能。有的甚至直接投资上游芯片厂,比如某国内光模块龙头就与一家激光器企业合资建厂,确保EML的自主供应。

技术路线上,行业也在悄悄“换道”。传统光模块依赖DSP(数字信号处理器)做信号处理,功耗高、成本大。现在,越来越多厂商转向LPO(线性可插拔光学)和硅光集成方案。LPO把信号处理功能从模块内移到主板,省去DSP芯片,整机功耗降低30%以上;硅光技术则用芯片工艺直接在硅基上集成光路,体积更小、良率更高。2024年下半年,Meta和微软的下一代AI服务器已大规模采用LPO方案,这标志着技术拐点正式到来。

下一个战场:1.6T和边缘互联

800G还没普及完,1.6T已经进入量产爬坡期。2025年,多家厂商将推出支持1.6T ZR/ZR+的相干光模块,专为跨城市、跨区域的数据中心互联(DCI)设计。这意味着,AI不再只集中在几个超大规模数据中心,而是向区域节点、边缘机房渗透。

比如,国内某大型AI训练平台已在长三角、成渝、京津冀三地部署“算力三角”,通过1.6T光模块实现跨区域模型协同训练。海外,欧洲的AI初创公司也开始租用德国和荷兰的区域数据中心,用低成本、高带宽的光互联方案替代昂贵的专线。

市场不再只是“卖更多模块”,而是“卖更稳、更省、更快的连接”。谁能在供应链、功耗、技术路线三者之间找到最佳平衡,谁就能在接下来三年的AI基建竞赛中,占据关键一席。