谷歌开源医疗AI新模型MedGemma1.5:能看CT、读病理、懂病历,但医生别急着靠它做诊断

谷歌最近把一个叫MedGemma1.5的医疗AI模型彻底开源了。这不是又一个“能辅助诊断”的宣传品,而是一个真正能看懂三维影像、读懂电子病历、甚至能对比你去年和今年CT变化的工具。它不卖关子,不玩概念,直接把过去分散在不同系统里的医疗数据——CT、MRI、病理切片、X光、化验单——全都打通了。

过去很多AI只能看一张X光片,说“可能有肺炎”,但说不清是哪一片肺叶、边界在哪、是不是肿瘤。MedGemma1.5不一样。它能直接处理完整的3D MRI扫描,几十个切片一起看,自动标记出脑部肿瘤的体积变化;它能分析整张数字病理切片,从细胞层面识别癌变区域,不是“疑似”,而是能框出具体位置;在胸部X光上,它能精准标出肋骨、心脏轮廓、结节位置,误差小于2毫米;更关键的是,它能对比你过去三个月的检查记录,告诉你:“这次肺部阴影比上个月小了15%,但肝功能指标又升了。”

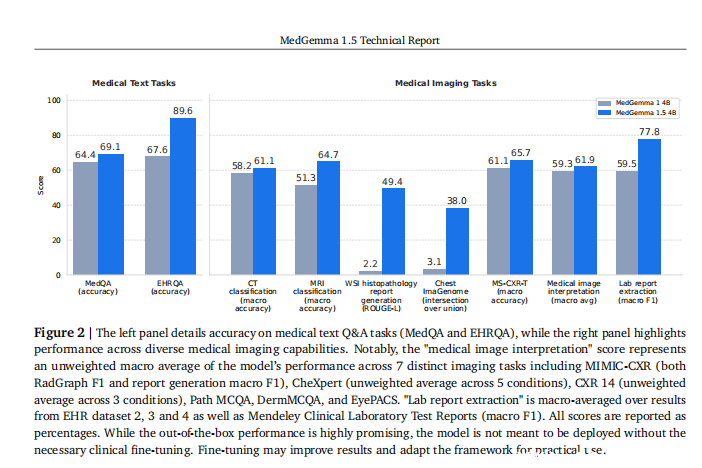

这些能力不是纸上谈兵。实测数据摆在眼前:和上一代MedGemma14B相比,它在3D MRI肿瘤分类上准确率提升了11%,病理图像识别的F1分数直接跳了47%——这意味着漏诊和误诊都大幅减少;胸部X光的定位精度提高35%,接近放射科主治医师的水平;而读电子病历和化验单的能力,准确率涨了22%。最惊人的是,这一切都发生在参数量只有40亿的情况下——比很多大模型小一半,跑起来更省电、更快,医院服务器也能扛得住。

它怎么做到的?谷歌没藏私。团队把过去几年积累的医学图文数据全喂进去了:来自公开数据库的数千组CT-MRI配对影像、皮肤科医生标注的病变区域、病理专家标记的癌细胞分布,甚至用真实病历合成的“假病历”来训练它理解医生的书写习惯。为了处理3D影像,他们专门设计了一套切片算法,能把一个完整的CT扫描拆成最多85张有序图像,让模型“一页一页”看,像医生翻胶片一样。

更硬核的是,他们请了真正的放射科医生和病理科专家,用他们的判断结果“教”模型——这叫知识蒸馏。不是让模型自己猜,而是告诉它:“这个结节,老张医生去年说要随访,你记住了。”

但别误会,这不是能直接替医生开药的“AI专家”。谷歌写得很清楚:MedGemma1.5是给开发者、医院IT团队和研究者用的“基础工具包”。你拿到它,可以拿自己医院的病例再训练一遍,让它适应你们的设备、你们的报告格式、你们的诊断习惯。比如,你医院的CT机型号特殊,图像噪点多?那就用你自己的数据微调它。你科室最爱用的电子病历模板和别人不一样?重新喂数据,它就能学会。

当然,它也不是完美。为了能看懂这么多东西,它在一些冷门的、小众的医学问答题上,表现比旧版稍微差了一点——比如“某罕见皮肤病在1980年代的诊断标准是什么”。这不是缺陷,是取舍。它选择成为“通才”,而不是“偏科状元”。

目前,这个模型已经开源在Hugging Face和GitHub上,代码、权重、训练数据说明一应俱全。如果你是医院的信息科,或者正在做AI辅助诊断的创业团队,它可能是你今年最值得花时间研究的工具。它不承诺“取代医生”,但它能帮你把重复劳动省下来——把看片子、找数据、比变化这些事交给它,医生才能把时间留给病人。

论文地址:https://www.alphaxiv.org/abs/2604.05081