谷歌联手Marvell,自研AI芯片剑指英伟达

全球科技圈最近传出了一个不太寻常的消息:谷歌正在和半导体公司Marvell Technology秘密合作,共同打造两款专为AI训练设计的定制芯片。这不是一次普通的供应链合作,而是谷歌在算力自主路上迈出的关键一步——它想摆脱对英伟达GPU的依赖,不再让自己的云业务被一家公司“卡脖子”。

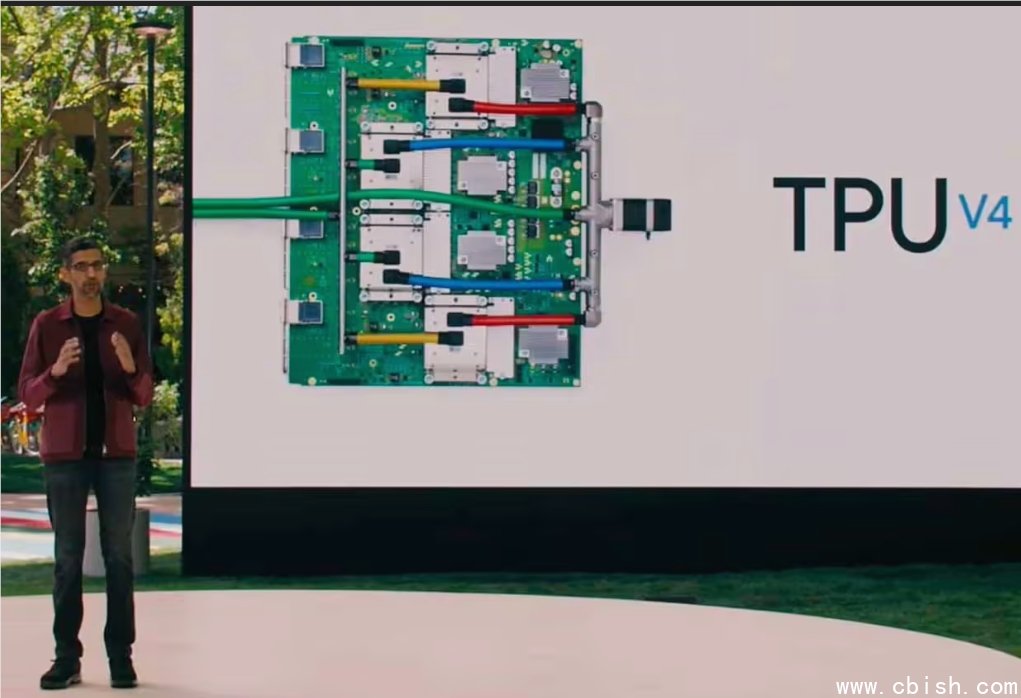

知情人士透露,这项合作已经进入实质性阶段。双方的目标很明确:一款是“内存处理单元”(Memory Processing Unit),它不直接做AI计算,而是专门解决数据在芯片间“跑不动”的老问题;另一款则是下一代TPU,也就是谷歌自家的AI加速芯片,这次不是小修小补,而是为GPT-4级别以上的超大模型量身定制。

按目前的时间表,内存处理单元的设计有望在2025年年中完成,下半年就能进入试产。如果顺利,2026年就能在谷歌云的服务器里看到它们的身影。这不是实验室里的概念,而是要真刀真枪上战场的硬件。

为什么非要自己造芯片?

过去五年,英伟达的H100、B100等GPU几乎成了所有大模型训练的“标配”。但代价也高得吓人:一块H100售价超过3万美元,一个AI训练集群动辄就要几千万美元的芯片投入。更麻烦的是,供货周期长,排队等货成了常态,连微软、亚马逊都曾因缺货延误项目。

谷歌不是没试过自己搞。TPU从2016年就开始用在搜索和翻译里,2018年上线云服务后,它成了谷歌云增长最快的部分。但早期TPU主要跑的是中等规模模型,面对如今动辄千亿参数的模型,光靠TPU单打独斗,数据搬不动、内存跟不上,效率反而被拖慢。

这次和Marvell合作,就是补上这个短板。Marvell不是新玩家,它给苹果、思科、戴尔都做过定制芯片,尤其擅长把内存、缓存、数据通路这些“看不见”的部分做到极致。它的加入,能让谷歌的TPU真正“吃得饱、跑得快”,而不是被数据堵在路上。

云服务的胜负手,藏在芯片里

谷歌云目前在全球市场份额排第三,落后于AWS和微软Azure。但它有个优势:成本控制更狠。如果谷歌能用自研芯片,把AI训练的成本压低30%以上,那它就能给客户报出更低的价格——比如,同样训练一个AI模型,别人要花100万美元,谷歌可能只要70万。

这不只是省钱的事。2024年,全球AI算力需求暴涨400%,企业都在找性价比更高的云服务。谁能把算力卖得又便宜又稳定,谁就能抢走大客户。Salesforce、Adobe、Zoom这些公司,早就开始悄悄评估替代方案了。

更关键的是,芯片自主意味着控制权。一旦英伟达涨价、断供、或者技术路线转向,谷歌不用再看别人脸色。它可以在自己的数据中心里,完全掌控从芯片到软件的整条链路——这正是亚马逊和微软也在拼命做的事。

这场游戏,才刚刚开始

当然,英伟达现在还是老大。它的CUDA生态、软件工具链、开发者社区,不是一两年能赶上的。但谷歌不是要立刻取代它,而是要“在它最得意的地方,开出一条新路”。

2025年,我们可能会看到谷歌云在官网悄悄更新一句:“支持新一代TPU+内存协同架构,训练效率提升40%”。没有炫酷的PPT,没有发布会,但客户会算账——谁便宜、谁快、谁稳定,他们就选谁。

这场算力战争,不再是芯片厂商的独角戏。谁能把硬件、软件、云服务拧成一股绳,谁就能在AI时代,真正掌握主动权。