为什么大模型服务越来越慢?一个被忽视的瓶颈

你有没有发现,用大模型聊天时,第一次提问总是慢半拍?哪怕你用的是顶尖的AI平台,输入一段长文后,系统也要停顿好几秒才开始回复。这不是网络问题,也不是服务器负载高——真正的原因,藏在模型推理的“预填充”阶段。

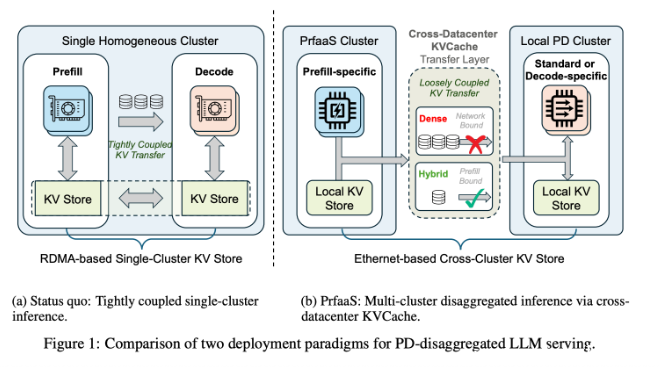

目前几乎所有大模型服务都把“理解输入”和“生成回复”两个步骤塞在同一个机房里完成。前半段要处理你的长文本、计算复杂的注意力权重、生成上千MB的缓存数据(KVCache),这一步对GPU算力要求极高;后半段则是逐字输出,对内存带宽更敏感。可问题是:算力强的机器,不一定内存快;内存快的机器,又不一定能扛住高并发计算。

PrfaaS:把“思考”和“说话”分开干

Moonshot AI 和清华大学团队最近提出了一种更务实的做法——把“思考”和“说话”拆到两个地方。

他们建了一个专门的“预填充集群”,用最顶级的GPU集中处理用户的长输入,比如一篇5000字的论文、一份合同、一段代码。等算完缓存数据,不是传回本地,而是直接通过普通以太网,把几千MB的KVCache打包传到离你更近的“解码集群”——那里没有高算力需求,但内存带宽极高,专门负责快速输出答案。

听起来像把快递分拣中心和配送站分开?没错。结果很直观:在真实测试中,服务吞吐量提升了54%,用户等待时间平均缩短了近40%。尤其在处理长文本、多轮对话、文档摘要这类任务时,体验提升最明显。

不只是提速,更是成本的重新分配

传统架构下,你每多一个用户发长文本,整个系统就得配更强的GPU。而PrfaaS让企业可以灵活组合资源:预填充用少量高性能集群,解码用大量低成本、高内存带宽的服务器。这意味着,同样的预算,能服务更多用户。

更关键的是,它不依赖昂贵的InfiniBand或NVLink互联,用的是普通以太网——这意味着部署门槛大幅降低。你不需要重新建一个超算中心,只要在现有云架构上加两个节点,就能升级。

真实场景:谁最先受益?

这不是实验室里的概念。在实际落地中,PrfaaS最先被用于:

- 法律AI:处理几十页合同,自动生成条款摘要,响应时间从12秒降到7秒

- 金融研报:分析上市公司年报,生成结构化摘要,支持每分钟处理30+份报告

- 教育平台:学生上传长篇作文,AI即时批改并给出修改建议,不再卡顿

这些都不是“炫技”功能,而是每天都在发生的高频需求。过去因为延迟高、成本贵,很多企业只能用短文本模型应付,现在,长文本终于能流畅跑起来了。

未来:跨数据中心,不再是幻想

PrfaaS最大的意义,是打破了“AI服务必须在一个机房里完成”的固有思维。它证明了:只要设计得当,普通网络也能承载大模型的“大脑”和“嘴巴”。

随着更多企业开始部署多地域AI节点,这种架构将成为标配。你下次用AI工具时,可能根本不会意识到——你输入的那句话,其实是在北京的服务器里“思考”,在上海的服务器里“说话”。