Claude Opus 4.7 正式发布:不追求最聪明,只做最可靠

Anthropic 这几个月简直像开了挂——几乎每隔一天就放出一个新版本。就在今天,他们低调但有力地推出了 Claude Opus 4.7。没有盛大的发布会,没有花哨的PPT,只有一句直白的说明:“这并不是我们最强的模型。”

那最强的?叫 Mythos Preview,至今没露面。但没人怀疑它的存在。这次的 4.7,更像是在说:“我们先把你最需要的,做到极致。”

不是刷分机器,是能“挑错”的搭档

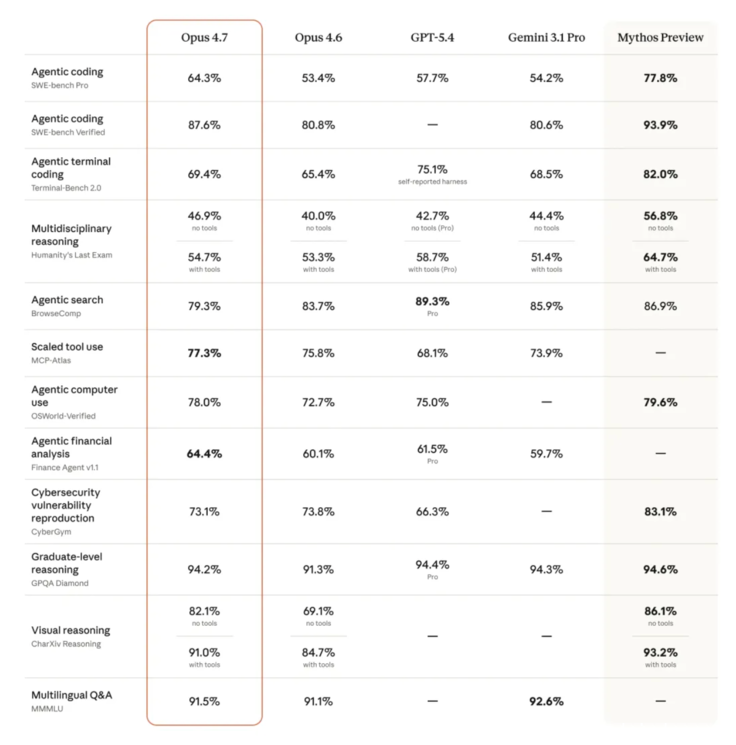

数字确实漂亮:在编程任务基准 SWE-bench Pro 上,它从 53.4% 跳到 64.3%,比 GPT-5.4 和 Gemini 3.1 Pro 都高了一截;视觉推理 CharXiv 从 69.1% 直奔 82.1%,图像识别清晰度提升三倍以上,现在能看清文档里更小的字体、更模糊的图表了;法律场景的 Harvey BigLaw 基准,它拿到了 90.9%——这意味着它在审查合同、识别风险条款时,已经接近资深律师的水平。

但真正让人停下来的,是它“不撒谎”的态度。

在 Agentic 搜索测试 BrowseComp 上,它的分数从 83.7% 降到了 79.3%。不是退步,是“克制”。当它找不到确切答案时,不再编一个听起来合理、实则错误的回复。它会说:“信息不足,无法确认。”

Replit 的工程师说:“它会在我写代码的时候说‘你这个逻辑有问题’,然后自己改一个更安全的方案。它不像工具,像一个会挑刺的资深同事。”

Hex 平台的数据显示,过去版本遇到缺失数据,会自作主张填一个“大概对”的值,结果导致下游分析全错。4.7 不干了——它直接报错,让你去查原始数据。这不是“笨”,是负责任。

能自己“绕过故障”,还会先做数学证明

Notion 团队测试发现,当工具链突然崩溃(比如 API 掉线、权限失效),4.7 不会直接放弃。它会尝试换路径、找替代方案,任务成功率提升近 70%。

Vercel 的开发者更惊讶:他们在让模型生成一个复杂的系统级脚本时,发现它没急着写代码,而是先在后台推导了一组数学公式,验证了算法的可行性,才开始写第一行代码。

“它像一个工程师,先想清楚原理,再动手。”一位工程师在内部邮件里写道,“我们以前用AI是省时间,现在是怕它出错。”

更强,也更贵了

没有免费的午餐。4.7 用了一个全新的分词器,同样一句话,Token 数量多了 1 到 1.35 倍。再加上它“想得更久”,响应时间变长,成本自然上升。

Anthropic 没回避这个问题。他们推出了:

- xhigh 思考模式——默认开启,适合需要高精度的开发和企业场景;

- /ultrareview 指令——让模型对输出做三轮自我审查,适合法律、金融等高风险领域;

- Auto Mode 扩展——Max 用户可让模型自动判断何时该深思、何时该快答;

- 任务预算功能(公测中)——开发者可以设置每次调用的 Token 上限,超了就自动降级,避免账单爆炸。

这不是为了省钱,而是为了让你能放心用。毕竟,一个会自己算数学、敢说“我不知道”的AI,如果因为成本高不敢用,那才是最大的浪费。

Mythos Preview:在暗处,等着登场

那个传说中的 Mythos Preview,没消失,只是藏起来了。据可靠信源,它已以“Project Glasswing”为名,小范围开放给几家网络安全公司,用于检测零日漏洞和自动化渗透测试。内部人员透露,它的推理深度和跨模态理解能力,远超当前任何公开模型。

但 Anthropic 没敢放出来。不是技术不成熟,是太强了——强到可能被滥用。他们还在做最后的安全评估,确保它不会被用来生成精准钓鱼邮件、伪造身份或自动化攻击。

有人说,4.7 是 Anthropic 的“稳定器”。它不追求第一,但绝不妥协底线。而 Mythos,才是他们真正想投下的那颗炸弹。

今天你用的,可能只是序章

过去一年,AI 的竞争焦点一直在“谁更快、谁更炫”。但 4.7 把话题拉回了原点:我们到底要一个能说会道的聊天机器人,还是一个值得托付的助手?

越来越多的企业正在放弃“能回答所有问题”的模型,转而选择“知道什么时候该闭嘴”的那个。

4.7 没有颠覆性的新功能,但它重新定义了“靠谱”。

而 Mythos,正在路上。等它出现的那天,我们才会明白,Anthropic 从一开始,就没打算赢在速度,而是赢在信任。