Mac Studio M4Max 实测:本地跑 Claude Code,速度提升5倍以上

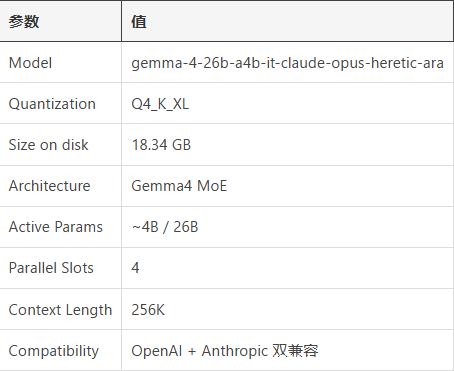

最近,JeecgBoot 团队在一台搭载 M4 Max 芯片的 Mac Studio 上,对 Claude Code 的本地部署做了深度实测。他们没用官方原版,而是选了社区里一个叫 gemma-4-26b-a4b-it-claude-opus-heretic-ara 的魔改模型——结果直接把生成速度干到了 78 token/秒,是官方原版的 5~6 倍。

不是调参调出来的,是换模型换出来的。这说明,选对模型,比折腾提示词、改参数有用得多。

为什么这个模型快?关键在“只用四分之一”

这个模型标称 260 亿参数,但实际每次推理只激活约 40 亿参数——用的是 A4B(Active4B)的 MoE 架构。有点像你家有十间房,但每次只开一间灯,省电又高效。

好处是显而易见的:

- 在 M4 Max 上跑得飞快,不卡顿

- 显存占用低,16GB 显存就能跑

- 支持 256K 上下文,能一口气处理整份项目代码

- 完全兼容 Anthropic API 格式,不用改任何代码,直接替换就能用

实测中,它能秒出 Vue3 + TypeScript 的 script setup 写法,SQL 自动带 Flyway 版本号,Controller、Service、Mapper 一整套骨架全给你列好。不是“能用”,是真能直接拿去改。

慢的不是模型,是它“想太多”

别被 78 token/s 误导了。生成一段教师表代码,总耗时还是得 1 分半钟。

为什么?因为 Claude Code 不是直接写代码,它要“思考”:

- 先分析你项目里用了什么框架

- 再判断你用的是 MyBatis 还是 JPA

- 然后翻自己的“技能库”,加载对应的模板

- 最后才开始写

这一套流程下来,光是“思考”阶段就占了 80% 的时间。Token 数膨胀得厉害,实际生成反而快。

所以,如果你只是想快速生成一个简单的增删改查接口——用它太慢了。不如直接打开 LM Studio,用个轻量模型聊两句,10 秒搞定。

但要是你让 AI 帮你重构一个复杂模块,或者改掉一个有历史包袱的 Service,它的“想太多”反而是优势——能避免你踩坑,逻辑闭环做得比人还细。

真用起来怎么样?JeecgBoot 教师表实录

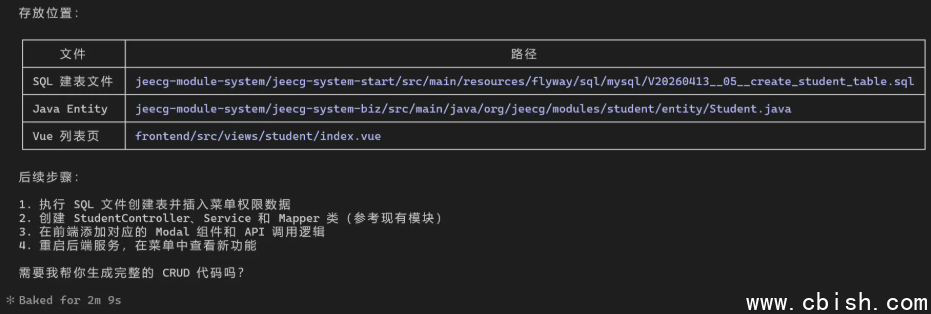

我们让模型生成了一套 JeecgBoot 的教师表完整代码,结果如下:

- SQL:字段名、注释、时间戳全对,Flyway 版本号自动生成,不用手动改

- Vue3:用的是

script setup+ TypeScript,没用 Options API,符合现在主流 - 后端:Controller、Service、Mapper、DTO、VO 全都有,连分页查询的接口都写好了

- 缺点:复杂逻辑,比如权限校验、事务嵌套、缓存失效策略,它写得像模板,得人工补细节

不是“AI 写的代码”,是“一个有经验的 Java 开发者写的代码”——只是他不会问你“你用的是 Spring Boot 2.7 还是 3.x?”

建议:生成完,别直接提交。重点检查:

- 数据库字段是否和你现有表一致

- 权限注解有没有漏

- 日期格式是不是你项目用的 yyyy-MM-dd HH:mm:ss

真实建议:别迷信一个模型,用“高低配”

我们团队现在是这么用的:

- 80% 的日常开发 → 本地跑这个魔改模型

做 CRUD、写接口、改前端、写单元测试——全本地,不联网,数据不出公司,免费,快。 - 20% 的复杂任务 → 用官方 Claude API

比如设计微服务架构、写安全审计模块、处理多租户权限体系——这时候,宁可花钱,也要用更稳的云端模型。

不是谁比谁强,是场景不同。本地模型像你的老伙计,啥都懂,反应快,但偶尔偷懒;云端模型像专家顾问,贵,但关键时刻靠得住。

结论:本地 AI 开发,已经能用了

M4 Max + Q4_K_XL 量化 + 社区魔改模型,这套组合拳,让一个普通开发者能在自己电脑上,跑出接近云端 Claude 的代码生成能力。

不需要云服务账号,不用交钱,不用传代码到外网,不用等响应。你改一行代码,AI 三秒内就能给你更新对应测试用例。

这不是未来。这是现在。2025 年,越来越多的团队正在悄悄放弃云 API,转投本地部署。不是为了炫技,是为了——

**省时间、省钱、更安心。**

如果你还在用 GPT-4o 或 Claude 3.5 做日常开发,你可能正在为每分钟几美分的 token 费用买单。而隔壁工位的人,用 Mac Studio + 本地模型,一分钱不花,还跑得更快。