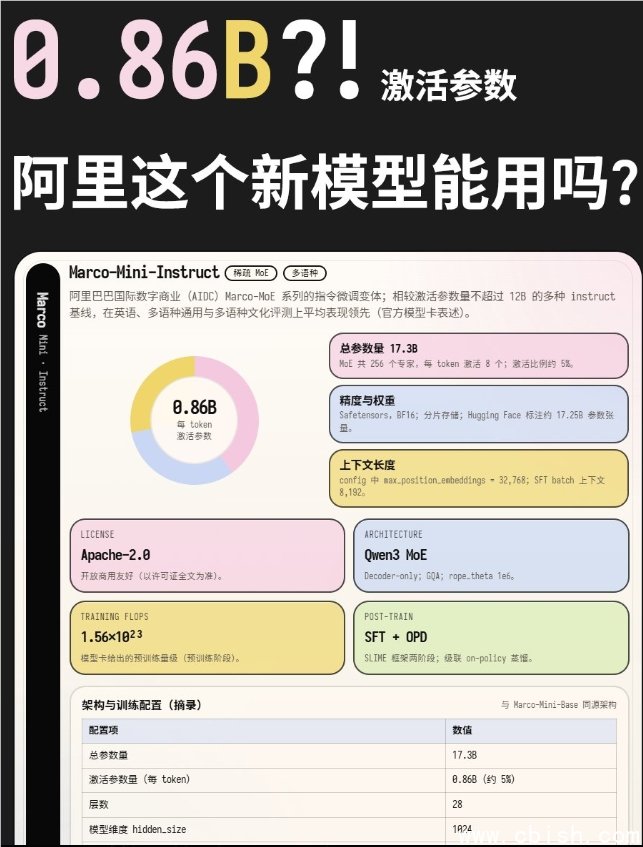

阿里推出“CPU能跑”的小模型:17.3B参数,激活仅0.86B,性能超4B大模型

阿里国际数字商业团队最近发布了一款让人眼前一亮的新模型——Marco-Mini-Instruct。它总参数量17.3B,但每次推理只激活其中0.86B,相当于“用10%的力气干100%的活”。最夸张的是,它在普通笔记本电脑的CPU上就能流畅运行,不用高端显卡,不烧电,不排队,打开就能用。

实测数据显示,在8bit量化+4条DDR4 2400内存的普通PC环境下,它每秒能生成约30个token。这意味着你用它写邮件、改文案、做总结,响应速度和手机上的AI助手差不多,甚至更快。你不用买RTX 4090,也不用租云服务器,花几百块买台二手台式机,就能跑出媲美大厂模型的效果。

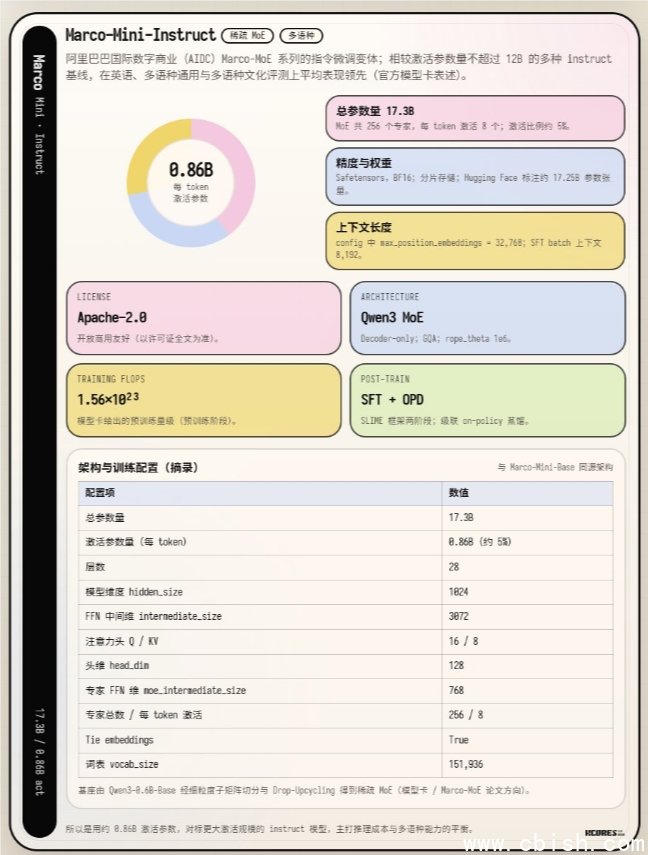

不是从头训练,而是“改造”一个0.6B小模型

这款模型最特别的地方,不是它有多强,而是它怎么来的——它根本不是从零训练的。它是由Qwen3-0.6B这个原本很小的模型“升级”而来。

团队做了一件很聪明的事:把原来那个小模型的结构拆开,把某些层“复制”成多个版本(叫“专家”),再加一个“路由开关”,让模型在每次回答时,只挑最合适的几个专家干活。这就像一个公司原来只有5个员工,现在把其中几个岗位复制出几套人马,但每次任务只派2~3个人上,既灵活又省成本。

更妙的是,训练时还用了“Drop-Upcycling”策略——训练过程中随机关掉一些专家或路由路径,逼着模型学会在不完整信息下也能靠谱工作。这招不是炫技,是真能提升稳定性。你让它答错一次,它下次就更不容易再错。

上下文能到32K,但默认只用8K,更接地气

很多模型吹自己支持32K上下文,但实际用起来,8K就卡了,16K就崩了。Marco-Mini-Instruct不一样——它的配置虽然支持32K,但训练时只用8192token,也就是大概6~7页A4纸的内容。这个长度够你处理长邮件、读完一篇论文摘要、分析一份合同条款,完全够用,还不拖慢速度。

不追求“参数堆到天上去”,而是专注“你真用得上的场景”,这才是实用主义。

两轮“老师带学生”训练,让小模型学会大模型的思维

光有结构不行,还得教它怎么思考。团队用了两轮“蒸馏”训练:

- 第一轮:让Marco-Mini-Instruct模仿Qwen3-30B-A3B-Instruct,学它怎么写逻辑清晰的回答、怎么处理复杂问题;

- 第二轮:再换更猛的Qwen3-Next-80B-A3B-Instruct当老师,继续精修——这次不光教它写得好,还教它怎么避开敏感话题、怎么算数学题、怎么拒绝胡说八道。

整个过程不是简单抄答案,而是让小模型学会“为什么这么答”。结果就是:你问它“帮我写个周报”,它不会套模板;你问“这个公式怎么推导”,它能一步步给你拆解;你问“这公司有没有风险”,它知道说“需要更多信息”,而不是瞎编。

实测:0.86B激活参数,干翻4B大模型

别光听吹,看数据:

- 在MMLU、GSM8K、HumanEval等主流评测里,Marco-Mini-Instruct 的表现,全面超过Qwen3-4B这种“正经40亿参数”的密集模型;

- 在中文任务上,比如阅读理解、指令遵循、多轮对话,它比很多5B~7B模型还稳;

- 关键是,它跑得快、占内存少,手机端、树莓派、老旧服务器,全都能跑。

这不是“小模型勉强能用”,这是“小模型反而更好用”。

开源!成本低到离谱,个人开发者也能玩

最让人兴奋的,是阿里把整个流程写成了“操作指南”。

你不需要从零训练一个MoE模型——那得烧几百万,耗几个月。你只需要:

- 拿一个0.6B~1B的小模型(比如Qwen3-0.6B);

- 按他们公开的“Upcycling”方法,把结构改一改;

- 用64张A100跑24小时做SFT,再跑110小时蒸馏——总成本不到1万块;

- 搞定。

这比买一个商用API划算多了,也比自己从头训练省太多。中小团队、独立开发者、高校实验室,现在都能低成本做出自己的“高效MoE模型”。

这不是技术秀,是AI普惠的一步

过去,大家觉得AI模型越大越好,GPU越贵越好。结果是:普通人用不起,小公司玩不了,边缘设备根本跑不动。

Marco-Mini-Instruct 打破了这个逻辑。它证明了一件事:AI的未来,不在于堆参数,而在于怎么让模型更聪明地“用最少的力气,做最多的事”。

你不用等苹果或谷歌发布“手机端AI芯片”,现在就能在旧电脑上跑一个比很多大模型还强的AI助手。它可能不会写诗,但能帮你写周报;它不会当哲学家,但能帮你查合同漏洞;它不会替代你,但能让你每天省下2小时。

这,才是真正的技术落地。