一个文件,让 Claude Code 的源码全网疯传

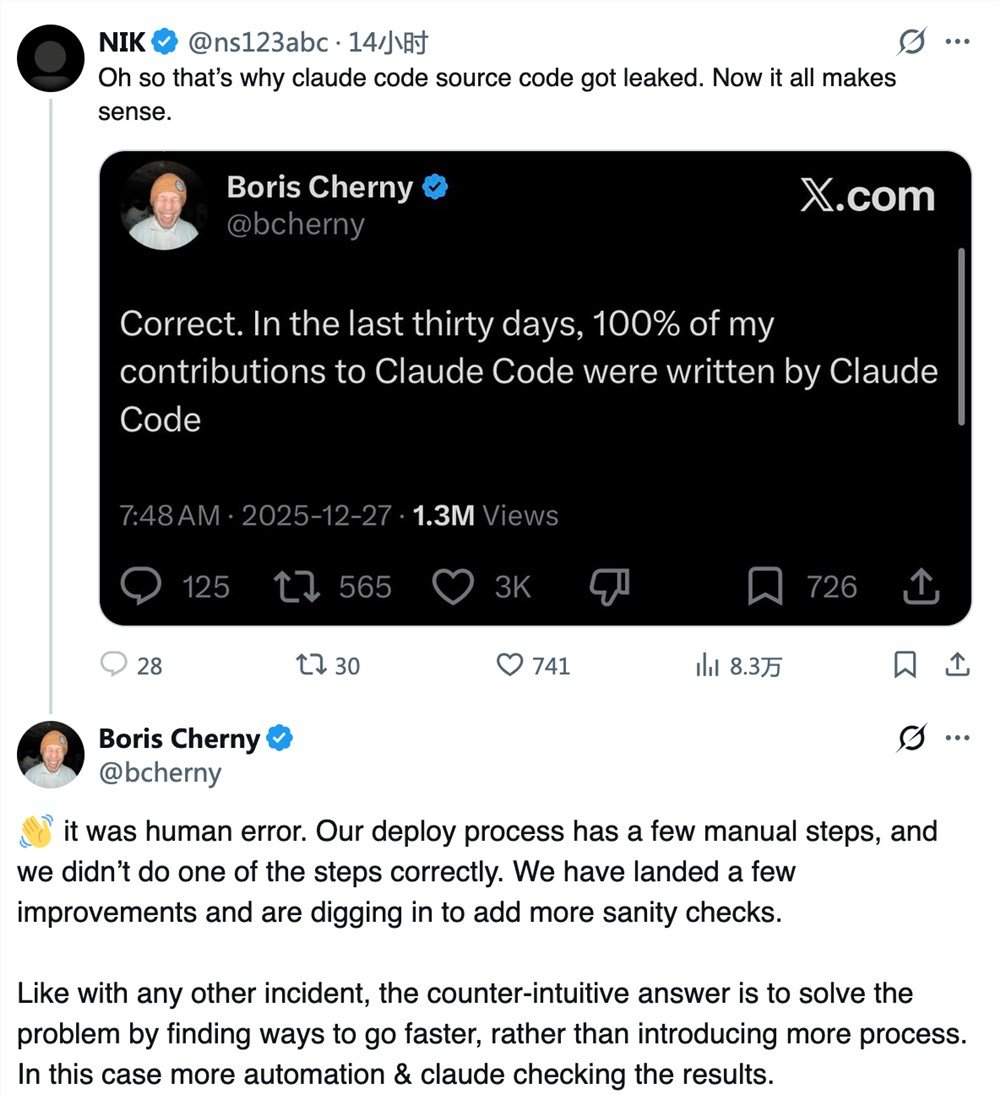

4月1日,Anthropic 的核心开发者鲍里斯·切尔尼(Boris Cherny)在一封内部邮件中承认:导致 Claude Code 源代码泄露的,不是黑客,不是漏洞,而是一个再普通不过的打包失误。

事情很简单:在把新版本部署到生产环境时,工程师忘记对构建产物中的 .map 文件做混淆处理。这个文件本是用来帮助开发者调试的,记录了压缩后代码和原始源码的映射关系——换句话说,它就像一张“地图”,能让你从一堆乱码里,一眼找到每一行代码的原始位置。

结果就是,这份文件被直接打包进了上线版本。不到24小时,有人在公开的 CDN 路径上发现了它,顺藤摸瓜,完整提取出 Claude Code 的前端核心逻辑。不到一周,GitHub 上冒出超过8100个包含完整源码的仓库,开发者们争相下载、分析、讨论,甚至有人写出了“如何用 Claude Code 的架构写个自己的 AI 编辑器”的长文。

他们删了8100个仓库,但没人能删掉互联网

事故爆发后,Anthropic 的反应不可谓不快。团队第一时间启动 DMCA 版权通知,向 GitHub 发送了数千条删除请求。截至4月5日,平台已下架了8100多个仓库,但没人指望这能彻底解决问题。

“我们删得掉仓库,删不掉镜像站、网盘、Telegram 群组和 Discord 频道。”一位参与处理的工程师在内部会议中说。事实上,源码早在被发现的几个小时内,就被上传到了多个非公开渠道。有开发者甚至用它做成了本地运行的 VS Code 插件,离线可用,无需联网。

更讽刺的是,这些泄露的代码里,有不少注释是开发团队自己写的:“这个函数太慢了,下次重构”、“别动这里,我怕它崩”——这些原本只在内部流传的吐槽,如今成了全网段子素材。

不是技术有多难,是流程太依赖人

鲍里斯在回应中没有推卸责任,也没提什么“安全文化”“零信任架构”这类空话。他直白地说:

“我们有五个手动步骤,每个步骤都靠人去点按钮。其中一个,就是‘确认是否混淆了 map 文件’。你猜怎么着?没人检查。”

过去一年,Anthropic 的开发节奏快得惊人。团队从10人扩到300人,CI/CD 流水线也跟着越堆越复杂。没人有时间逐条核对每个打包选项,于是“信任流程”变成了“信任同事”。而这次,信任崩了。

现在,他们正在做两件事:

- 把所有部署流程自动化,任何手动操作都必须由系统强制校验。

- 用 Claude Code 自己来审查部署包——让 AI 检查 AI 的输出,看有没有不该出现的文件。

“我们不是要建个铁桶,”鲍里斯说,“我们要的是,就算有人睡着了,系统也能自己拦住错误。”

AI 公司的通病:跑得快,忘了关门

这已经不是第一次了。

2023年,OpenAI 的 GPT-4 源码片段曾在内部测试服务器上被误设为公开访问,被安全研究员发现后上报;2024年初,Meta 的 Llama 3 训练脚本因 Git 配置错误,被上传到公共仓库,虽很快删除,但镜像早已传播。

这些公司都在喊“我们是最安全的”,但现实是:当研发速度压过流程规范,当“快速上线”成了 KPI,最基础的工程纪律就成了最脆弱的一环。

不是因为黑客太强,而是因为人太忙。

对普通开发者意味着什么

对大多数开发者来说,这次事件不是“大厂翻车”,而是一面镜子。

你有没有在项目里留过 .map 文件?有没有把调试用的 config 文件推上生产?有没有觉得“反正没人会看”就跳过了审查?

Anthropic 的错误,和你我曾经犯过的,本质上是一回事。

现在,GitHub 上的源码还在被下载、被分析、被复用。有人用它学习架构,有人用它写教学视频,也有人把它改造成收费插件——法律上是侵权,技术上却没人能阻止。

这或许才是最真实的教训:在开源和自动化时代,安全不是靠防火墙,而是靠每一个细节的坚持。

别等出事了,才想起“原来那个按钮,真的不能跳过”。