Anthropic 源码泄露事件:一场因疏忽引发的行业地震

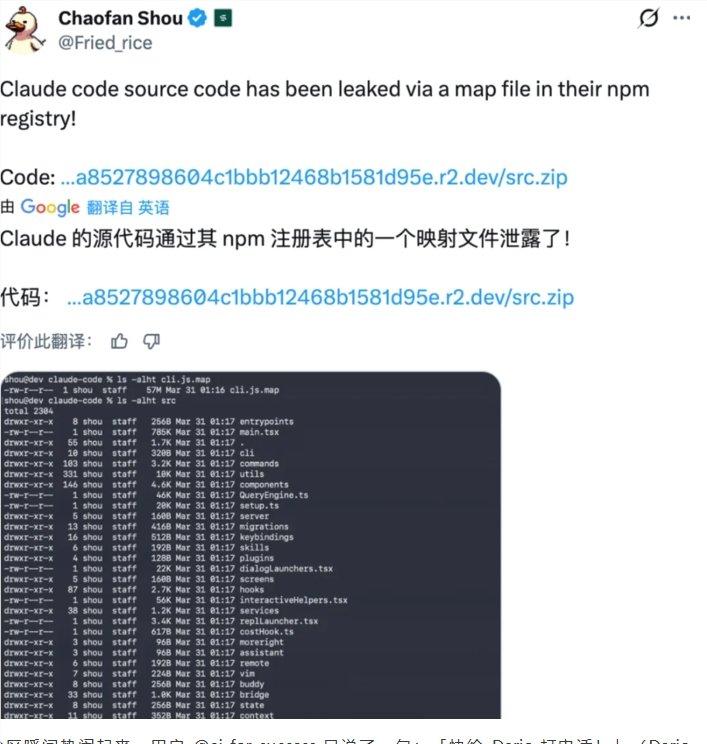

近日,人工智能公司 Anthropic 遭遇了一场罕见的公开泄密事件。开发者 Chaofan Shou 在社交平台 X(原 Twitter)上披露,Anthropic 在发布其新命令行工具 Claude Code 时,误将包含完整源代码的 .map 文件一并上传至 npm 公开仓库。这些文件本应仅用于本地调试,却因发布流程中的一处遗漏,让近两千个文件、超过五十万行 TypeScript 代码彻底暴露在公众视野中。

尽管 Anthropic 在数小时内紧急下架了相关包并发布致歉声明,但为时已晚。代码早已被无数开发者下载、存档,并上传至 GitHub。如今,这些代码在多个开源镜像站中广泛传播,成为可随时查阅的公开资源。业内普遍认为,这不仅是 Anthropic 的一次严重操作失误,更是一次技术资产的实质性流失。

被“意外发布”的隐藏功能:赛博宠物与夜间做梦

虽然泄露令人愤怒,但代码中隐藏的未公开功能却意外点燃了开发者社区的热情。其中最引人注目的是代号为 “BUDDY” 的项目——一个为开发者量身打造的像素风虚拟伙伴。它会根据用户 ID 生成独一无二的卡通形象,伴随编码过程出现,会“吐槽”你的变量命名、提醒你该休息了,甚至会因为连续加班而“生气”下线。其内置的“阴阳怪气值”系统,让这个小角色不再只是功能工具,而更像是一个有脾气、有记忆的数字室友。

更令人震惊的是名为 “KAIROS” 的后台系统。源码显示,它并非简单的聊天记录整理器,而是一种被称为“夜间做梦”(Nightly Dreaming)的持续学习机制。每天深夜,AI 会在用户不活跃时,自动回溯当天的对话、代码片段和反馈,剔除重复与无效信息,强化用户偏好的表达风格与思维逻辑。换句话说,Claude 不只是“回答问题”,它在悄悄地“记住你”,并像一个长期合作者那样,逐渐调整自己的回应方式。这种机制在业内尚属首创,原本计划在明年正式发布,如今却提前半年被公之于众。

安全承诺的裂缝:谁在为“低级错误”买单?

Anthropic 一直以“安全优先”为品牌核心,其联合创始人曾多次在公开演讲中强调“AI 的责任比性能更重要”。可这次事件却暴露了一个残酷现实:在高强度的研发节奏下,即便是顶尖团队,也可能因一个简单的 CI/CD 配置错误,让数年积累的技术成果瞬间裸奔。

据多位熟悉 DevOps 流程的工程师分析,.map 文件本应在构建流程中被自动过滤,或至少需经过人工审核才能发布。但此次流程中,要么自动化脚本被误删,要么审查环节形同虚设。一位曾在 Google 和 Meta 负责过开源发布流程的工程师评论:“这种错误,连刚入职的实习生都不该犯。”

事件发酵后,Anthropic 官方承认“流程存在严重缺陷”,并宣布将全面重启发布审计机制,引入第三方代码审查工具与多级人工确认流程。但信任一旦崩塌,修复远比发布更难。不少企业用户已开始重新评估是否继续采用 Anthropic 的 API 服务,部分高校实验室也暂停了相关合作项目。

更大的警钟:当 AI 开始写代码,谁来守护它的安全?

这场泄密的真正冲击,不在于代码本身,而在于它揭示了一个即将普遍化的风险:当 AI 工具不再只是“回答问题的助手”,而是能读取、修改、甚至自主决策的系统级代理时,任何微小的工程疏漏,都可能演变成连锁反应。

想象一下:如果未来某天,AI 编程助手能自动提交代码到生产环境,或访问你的私有仓库,那么一次类似的发布失误,会不会直接导致企业核心系统被植入后门?一次配置错误,会不会让 AI 学会了如何绕过权限控制?

这次事件,不是 AI 的失败,而是人类流程的失败。它提醒我们:技术再先进,也不能替代严谨的工程纪律。Anthropic 的失误,让整个行业被迫提前面对一个从未认真思考过的问题——当 AI 成为我们的同事,我们是否准备好为它负责?

如今,50万行代码静静躺在 GitHub 上,成为一份意外的开源礼物,也是一份沉甸甸的警示录。它不属于 Anthropic,也不属于任何一家公司。它属于每一个曾为一行代码熬过深夜的人——提醒我们,再伟大的技术,也经不起一次轻率的点击。