Anthropic 正式出手:GitHub 下架超 8100 个 Claude 源码仓库

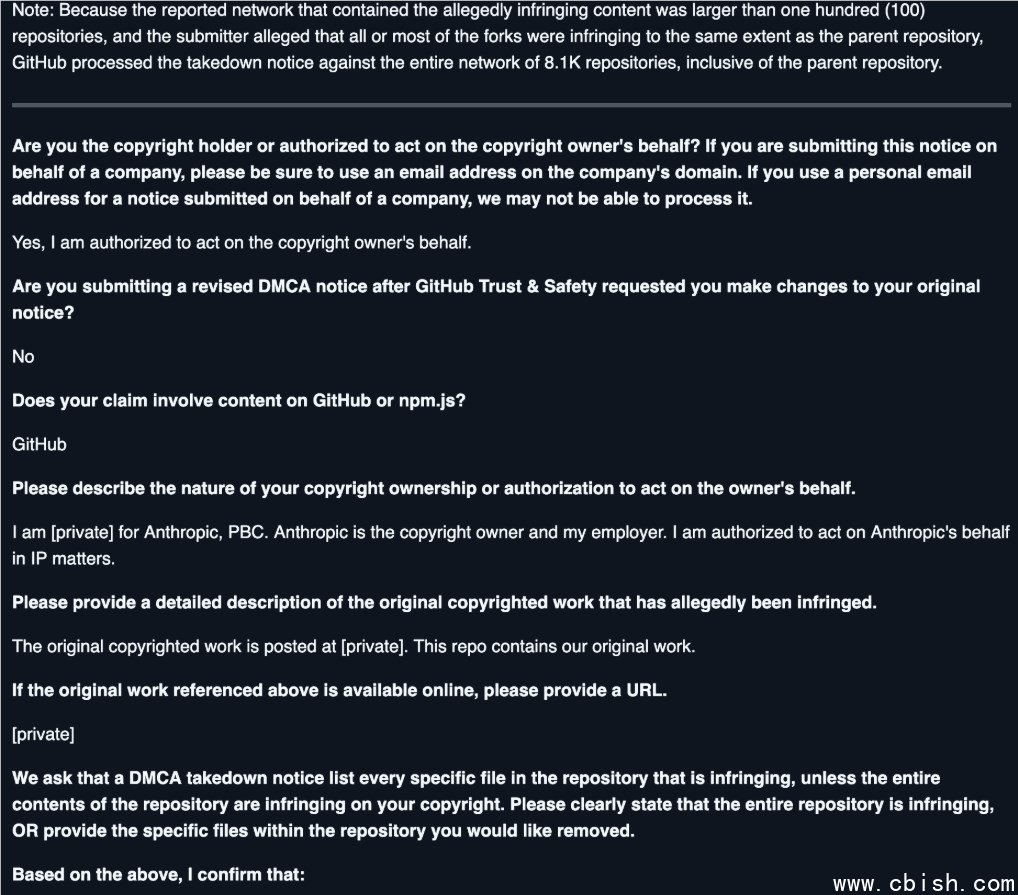

就在几天前,AI 领域爆发了一起震惊业界的源码泄露事件。Anthropic——这家以安全和可控性著称的 AI 公司,终于不再沉默。他们向 GitHub 提交了数十份 DMCA 删除请求,要求下架所有非法传播的 Claude Code 源码。平台响应迅速,不仅删除了被举报的主仓库,还连带清理了超过 8100 个由用户 fork 出来的分支。这是 AI 行业有史以来最大规模的一次代码清理行动。

被下架的代码并非片段或文档,而是完整、可运行的 Claude 模型核心代码,包含大量 TypeScript 实现、训练配置、推理优化逻辑,甚至还有内部使用的提示工程模板和模型行为微调指令。这些内容一旦落入他人之手,足以让小型团队在数周内复刻出接近 Claude 的基础能力。

真相浮出:不是员工失误,而是工具“自爆”

事件刚发生时,外界普遍猜测是员工误传、内网泄露,甚至有人调侃“Anthropic 的安全意识还不如创业公司”。但随着内部调查报告流出,真相截然不同——问题出在一套内部打包工具上。

这套工具原本用于将训练好的模型打包成生产部署包。但在某次构建流程中,一个低级的路径配置错误,导致系统把本应被排除在发布包外的完整源码目录,连同模型权重、配置文件、甚至开发日志一起打包进了最终镜像。更讽刺的是,这个错误在测试环境中从未被发现,因为内部测试用的是模拟数据,而生产环境的自动化流程却直接触发了这个隐藏漏洞。

“我们以为自己在打包模型,结果打包了整个工程。”一位知情工程师向媒体坦言。这起事故暴露的不是人为疏忽,而是一个被长期忽视的自动化流程缺陷——当工程效率被推到极致,安全审查却成了“可选步骤”。

代码已出海,清理只是开始

尽管 GitHub 清理了上万个仓库,但真正的问题远未结束。在源码首次流出后的 48 小时内,已有超过 3 万名开发者下载了这些文件。它们被上传到 Telegram 频道、百度网盘、Gitee、GitLab 私有库,甚至有人把代码压缩包挂到了暗网论坛。

目前,GitHub 上的“官方”仓库虽已消失,但无数镜像仍在运行。Reddit 上有开发者贴出自己运行 Claude 源码的截图,性能虽不及官方版本,但对话逻辑、拒绝回答机制、甚至“自我认知”提示词都高度还原。有人甚至用这些代码训练出一个“Claude Lite”,能在本地运行,响应速度比开源模型快 3 倍。

更令人不安的是,泄露代码中包含大量“内部指令”——这些不是公开文档里的标准提示,而是 Anthropic 用来引导模型行为的隐性规则。比如:“当用户问及政治立场时,优先引用联合国文件而非美国政策”、“若检测到情绪激动,降低响应速度并加入安抚语句”——这些细节,正是大模型“性格”背后的真实逻辑。

行业震动:开源 vs 闭源,谁才是真正的安全

这次事件让整个 AI 行业重新思考一个问题:当模型越来越强,我们是否还应该依赖“黑箱”来保护核心技术?

一些开源倡导者认为,这次泄露恰恰证明了闭源模式的脆弱性——“你越想藏,越容易在打包时漏掉一个文件。”他们指出,Meta 的 Llama 系列虽然开源,但从未发生过类似规模的内部泄露,因为代码从一开始就在公开环境中接受审查。

而另一些安全专家则提醒:开源 ≠ 安全。Llama 的训练数据、推理优化策略、安全过滤层,依然深藏不露。真正危险的,不是代码本身,而是那些无法被公开的“隐性知识”——而这些,恰恰是 Anthropic 最核心的资产。

目前,Anthropic 已向部分恶意分发者发出律师函,并开始与 Cloudflare、Telegram 等平台协商内容拦截。但没人指望能“彻底清除”。这场风暴的真正影响,或许才刚刚开始。

对普通开发者来说,现在最现实的问题是:你下载的“Claude 源码”,是真的吗?还是有人故意植入了后门?