谷歌推出“Search Live”:用摄像头问问题,手机秒变智能助手

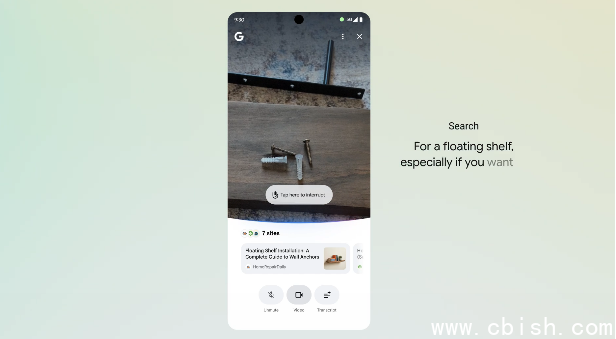

谷歌正式在全球超过200个国家和地区上线了一项新功能——“Search Live”。现在,你只要打开手机上的Google应用或Google Lens,对准眼前的东西——比如一台看不懂说明书的宜家书架、路边不认识的植物、甚至是一道你没吃过的菜——然后直接开口问:“这怎么组装?”“这是什么花?”“这道菜怎么做的?”——手机马上就能用语音告诉你答案,还会弹出相关网页、视频教程或附近餐厅的信息。

这项功能不靠打字,也不靠点图搜图,而是直接靠“看”和“说”。无论是安卓还是iPhone,只要摄像头打开、麦克风开启,系统就能实时理解你看到的画面和你说的话,像身边有个懂行的朋友一样立刻回应。不用再翻说明书、搜半天关键词,也不用截图发给朋友问——现在,问题一出口,答案就在耳边。

背后是新模型,但体验更像人

这次能“听懂你的话、看懂你拍的东西”,靠的是谷歌新推出的Gemini 3.1 Flash Live模型。它不是那种慢吞吞、答非所问的AI,而是专门优化了速度和自然对话能力——你说话时它几乎不卡顿,回答也更像真人聊天,不会一堆专业术语堆砌。比如你指着咖啡机问“为什么不出水?”,它不会给你一篇技术手册,而是说:“可能是水箱没装好,或者滤芯堵了,你看看这里有没有小黄灯亮着?”

而且它支持多种语言,不管你用中文、西班牙语、阿拉伯语还是印度语问,它都能听懂,还能用你习惯的语言回答。在国外旅行时,对着菜单问“这个是什么?”、对着路牌问“这是哪条街?”,它都能帮你搞定,不用再靠翻译软件一个字一个字地拼。

不只是搜索,是生活里的“随身向导”

谷歌这次不是在搞花哨的AI演示,而是真正在解决日常痛点。你是不是有过这样的经历:

- 买了一堆乐高,拆开一看,说明书全是英文,急得直跺脚?

- 在超市看到一种没见过的蔬菜,想买但不知道怎么吃?

- 走在异国街头,看见一个奇怪的建筑,想知道它的历史?

- 孩子指着窗外的鸟问“这是什么鸟?”,你根本答不上来?

现在,这些问题都不用再发朋友圈求助了。Search Live就是为这些场景设计的——它不追求炫技,只追求“快、准、有用”。你不需要下载新App,也不需要学习新操作,打开Google,打开摄像头,开口问就行。

为什么现在推出? competitors都在发力

其实,不只是谷歌在动。苹果在推“Apple Intelligence”,OpenAI正把ChatGPT塞进浏览器,Luma AI也在用AI识别3D物体。但谷歌的优势在于:它早就把搜索装进了每个人的手机,每天有超过10亿人用它找东西。现在,它只是把“搜索”变得更自然了——从“你打字,它找结果”,变成“你看着东西说话,它直接告诉你”。

更重要的是,这个功能不需要高端手机。只要你的手机能运行最新版Google App,哪怕是一年前的中端机型,也能用。谷歌没搞“只有旗舰才配用”的套路,而是想让更多人用上。

未来会怎样?你可能再也离不开它

用过几次之后,你会发现:这不再是“搜索功能”,而是你生活里的一个新习惯。出门遛狗,看到不认识的草,顺手一拍;做饭时找不到调料,对着瓶子一问;逛博物馆,对着展品一说,立刻听到讲解——这些都不是科幻,而是现在就能用的功能。

谷歌没说这是“AI革命”,但它的做法很实在:把最复杂的技术藏在最简单的动作后面。你不需要懂什么是“多模态”“大模型”,你只需要知道:手机能听、能看、能答,而且比你朋友还快。

下次你再对着一个看不懂的东西发呆时,别急着百度了——试试打开Google,对准它,问一句:“这是什么?”