MolmoWeb:不看代码,只看屏幕的网页助手

艾伦人工智能研究所(AI2)最近放出一个让人眼前一亮的工具——MolmoWeb。它不像其他网页自动化工具那样去读HTML、CSS或者JavaScript,而是像人一样,只盯着浏览器屏幕看。你看到什么,它就做什么:看到按钮就点,看到下一页就翻,看到长页面就往下拉。没有复杂的代码解析,没有容易出错的元素定位,它靠的,就是一张张截图。

这听起来简单,但效果惊人。传统工具一遇到网页改版就崩,而MolmoWeb几乎不受影响——因为人看界面不会因为一个class名改了就找不到按钮,它也不会。

小模型,大能量:80亿参数干翻大厂

MolmoWeb只有40亿或80亿参数,听起来比GPT-4、Claude 3小得多,但它在真实任务中的表现却让人意外。

在权威测试平台WebVoyager上,80亿版本的MolmoWeb拿到了78.2分,离OpenAI的o3模型(79.3分)只差一步。这意味着,一个完全开源、不靠闭源算力堆出来的模型,已经能跟行业顶尖的商业产品掰手腕。

更厉害的是,如果你让它多试几次,挑最好的结果用,成功率能飙到94.7%——相当于你让一个人帮你查机票、订酒店、填表,他试五次,四次半都能搞定。

在定位按钮、菜单、输入框这些细活上,它甚至超过了Anthropic的Claude 3.7。要知道,Claude可是靠千亿级参数和海量数据训练出来的,而MolmoWeb,靠的是“看得准”。

数据不是靠猜的,是真人干出来的

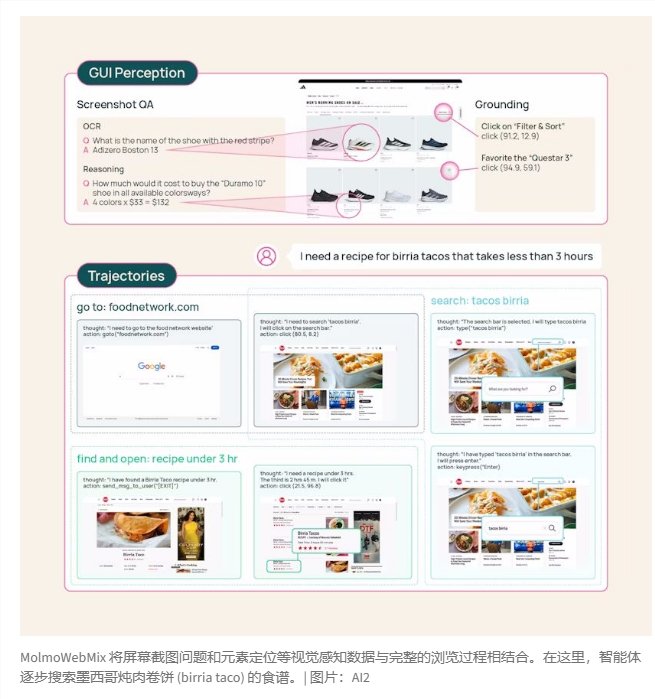

再强的模型,也得有好数据喂。AI2这次没藏着掖着,直接扔出一个叫MolmoWebMix的超大数据集,全公开,谁都能用。

这里面有3.6万条真实人类操作记录——不是机器人模拟的,是真人坐在电脑前,完成从订机票到比价购物、从查政策到填申请表这些日常任务时,一屏一屏截图保存下来的。

还有超过220万个截图+问题的配对,比如:“这张图里怎么找‘立即购买’按钮?”“这个页面能订周五的火车票吗?”

更有趣的是,他们还用GPT-4o生成了大量合成数据。结果发现,有些“AI编”的操作路径,比真人做的还高效——不是乱点,而是学会了避开广告、跳过弹窗、直奔目标。这说明,模型不只是在模仿,它开始理解“人为什么要这么操作”。

开源,不是口号,是行动

MolmoWeb的模型权重、代码、数据集,全部放在Hugging Face和GitHub上,用的是Apache 2.0协议——你可以免费用,改,甚至拿去做商业产品,不用交钱,不用申请,不用怕被封。

这在今天特别难得。大厂都在悄悄收拢能力,把AI锁在API后面。AI2却说:我们不靠垄断赚钱,我们靠让所有人能用、能改、能创新。

当然,它现在还不完美。遇到登录页、验证码、复杂的法律弹窗,它还是会懵。但这些,正是社区可以一起解决的问题。你发现它在某个网站点错按钮?你可以录一段操作,上传数据,帮它学得更好。

这不是实验室里的玩具。它是一个开放的、可进化的工具——适合开发者做自动化测试,适合研究人员探索视觉智能,也适合普通人用它来自动填表、比价、抓信息。你不需要懂技术,只要会看屏幕,它就能帮你动手。

未来,也许我们不再需要写脚本、装插件、学XPath。你只要说一句:“帮我查一下这个酒店的取消政策”,MolmoWeb就能打开浏览器,自己去看、去读、去告诉你答案。

它不完美,但它真实、透明、属于每个人。