AMD 推出 OpenClaw,让你的电脑跑起本地大模型

AMD 最近悄悄发布了一个叫 OpenClaw 的开源工具包,配套推出了两套硬件方案:RyzenClaw 和 RadeonClaw。这不是什么概念演示,而是实打实想让你的家用电脑,不再依赖云端,就能跑起像 Qwen3.5 35B 这样的大语言模型。

过去想在本地跑大模型?要么得砸十几万买服务器,要么就得把数据传到网上,靠 OpenAI、Anthropic 这些平台。现在,OpenClaw 让你用一台普通桌面电脑——只要配置跟得上——就能把模型全存本地,对话记录、记忆数据、敏感信息,全在你自己的硬盘里,不用上传,也不用交月费。

怎么用?Windows 用户也能上手

OpenClaw 目前主要跑在 Windows 的 WSL2 环境里,用的是大家熟悉的 LM Studio + llama.cpp 组合。这意味着你不需要折腾 Linux 系统,也不用学新工具。如果你之前用 LM Studio 在本地跑过 Llama 3 或 Mistral,那现在基本是无缝迁移。

框架内置了 Memory.md,简单说就是给模型加了个“本地记忆”。比如你让它帮你整理项目文档、记住客户偏好、跟踪任务进度,这些信息不会发到网上,全存在你电脑里,关机也不丢。对开发者、写作者、研究人员来说,这比任何“隐私声明”都实在。

RyzenClaw 和 RadeonClaw,到底有啥区别

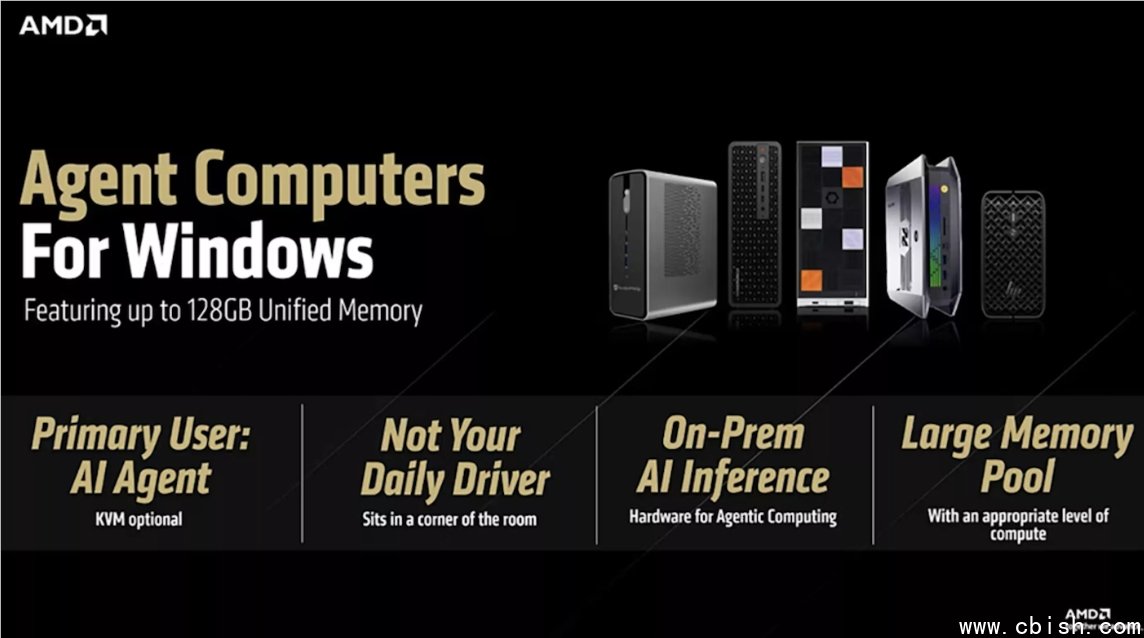

AMD 没搞花架子,直接给出了两套硬件方案,针对不同需求:

- RyzenClaw:搭载 Ryzen AI Max+ 处理器,128GB 统一内存。重点是“多任务”——能同时跑 6 个独立 AI 助手,比如一个写代码、一个查资料、一个做摘要,互不干扰。上下文窗口长达 26 万 token,相当于能记住一本 800 页的书的内容,适合长期项目、复杂推理。

- RadeonClaw:配的是 Radeon AI PRO R9700 显卡,32GB 显存。不追求多任务,追求快。测试显示,处理 1 万 token 的响应,平均只要 4.4 秒,比很多云服务还快。适合需要高频交互、实时反馈的场景,比如编程辅助、实时翻译、对话式数据分析。

这两套方案都不是给普通消费者准备的。RyzenClaw 整机起步价接近 2700 美元,RadeonClaw 也得两三千。但目标很明确:第一批用户是开发者、技术团队、独立研究者——那些每天和代码、数据、模型打交道的人。

这不是噱头,是趋势的开始

过去几年,AI 越来越“云端化”:你问一个问题,数据得传到亚马逊或微软的服务器,回来一条回复。但代价是:隐私没保障、网络依赖强、费用没底。

AMD 这次的动作,其实是对这个趋势的直接回应。他们没喊“颠覆行业”,只是默默把数据中心级别的算力,塞进了桌面电脑。你不需要订阅服务,不需要连网,甚至不需要懂 AI——只要装上 OpenClaw,配一台合适的机器,你的电脑就能变成一个真正属于你的 AI 工作站。

现在这价格确实高,但想想当年显卡从几千块降到几百块,SSD 从万元级变成标配。技术一旦开源,生态一旦起来,成本只会往下降。OpenClaw 的意义,不在于今天卖了多少台,而在于它让“本地 AI”这件事,从实验室走到了桌面。

如果你厌倦了每次问 AI 都要“授权”、怕数据被拿去训练、不想每月为几个功能付钱——那这可能就是你等了三年的转折点。