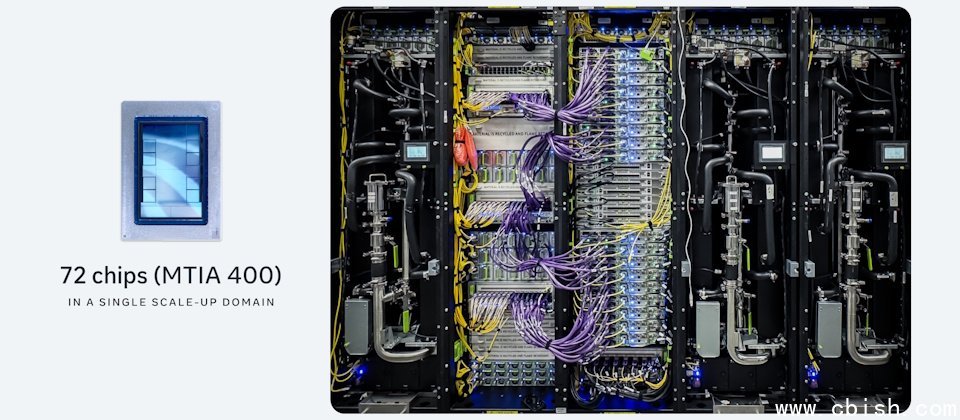

Meta近日公布了其自研AI芯片MTIA(Meta Training and Inference Accelerator,Meta训练与推理加速器)的最新进展。Meta表示,近两年已规划出MTIA 300、MTIA 400、MTIA 450与MTIA 500四个世代芯片,其中MTIA 300已投入生产,MTIA 400正准备部署,而MTIA 450与MTIA 500预计将于2027年大规模部署。

MTIA是Meta与Broadcom合作开发的AI加速器,主要用于AI模型的训练与推理。Meta指出,每天有数十亿用户在其平台上使用AI功能,包括内容推荐与AI助手,因此如何在全球规模上支持各类AI模型,同时控制计算成本,是AI基础设施的重要挑战。

此前Meta已推出前两代MTIA芯片MTIA 100与MTIA 200,相关设计分别于2023年与2025年公开,并已在数据中心部署数十万颗MTIA芯片,用于支持内部AI服务。这些芯片主要负责Meta平台上的排序与推荐系统(Ranking and Recommendation,R&R)推理工作负载,例如社交内容推荐与广告排序等核心算法。此外,Meta也已将部分大型语言模型(Large Language Model,LLM)迁移至MTIA平台进行测试。

随着生成式AI(Generative AI,GenAI)快速发展,Meta的AI计算需求正从过去以推荐系统为主,逐步转向生成式AI与大型语言模型的推理服务。

在硬件设计上,MTIA芯片持续提升内存带宽与计算能力。从MTIA 300到MTIA 500,高带宽内存(High Bandwidth Memory,HBM)带宽提升约4.5倍,而计算能力(FLOPS)则提升约25倍。Meta表示,HBM带宽是影响生成式AI推理性能的关键因素,因此新一代芯片特别强化HBM带宽,以加速大型语言模型的推理运算。

此外,MTIA也加强了对低精度运算的支持,例如MX4与MX8等数据格式。这类低精度运算可在维持模型质量的情况下提高推理吞吐量,已成为生成式AI推理的重要技术方向。

Meta指出,AI模型的演进速度已超过传统芯片开发周期。一般芯片设计往往需要约两年才能完成并投入生产,但AI工作负载在此期间可能已发生重大变化。因此Meta采取快速迭代策略,通过模块化chiplet架构与可复用系统设计,使芯片开发节奏缩短至约每六个月推出新一代产品。

Meta强调,公司将持续采取多元芯片策略,在自家研发的MTIA芯片之外,也会搭配外部供应商产品,例如GPU,以支持不同类型AI工作负载。不过随着生成式AI服务需求快速增长,Meta正通过自研AI芯片与快速迭代策略,强化其AI基础设施能力,并试图降低大规模AI服务的长期计算成本。