Meta发布自研AI芯片MTIA3,直指英伟达H100

就在昨天,Meta正式推出其第三代自研AI芯片MTIA3,并在内部测试中宣称:在推荐系统和大模型推理任务上,性能已超越当前市场最热的英伟达H100。这不是实验室里的数字游戏——而是真正在Instagram、Facebook和Llama模型背后跑起来的实测结果。

这张芯片不是为了“什么都能做”,而是专为一件事设计:让你刷到的每一条动态、每一条视频,都更快、更省电地推出来。

为什么Meta要自己造芯片?

过去几年,Meta每年在英伟达GPU上的花费超过50亿美元。光是2023年,就有超过10万张H100被部署在它的数据中心。但问题来了:买得越多,越受制于人。

供应链紧张时,交货周期从几周拖到半年;价格翻倍时,预算直接被打乱。更关键的是,通用GPU在处理推荐算法时,有近40%的算力被浪费在不相关的任务上——比如图形渲染、通用计算。

MTIA3不一样。它砍掉了所有不必要的模块,把晶体管全用在“读用户行为、算兴趣权重、预测点击率”这些事上。结果是:同样跑一个推荐模型,功耗降低近50%,单机架算力密度提升70%。这意味着,Meta可以少建30%的数据中心,电费和冷却成本直接省下数亿美元。

不只是省钱,是速度和控制权

如果你用过Llama 3,你可能没意识到,你问的每一句话,背后都有Meta的工程师在悄悄优化芯片和代码的配合。MTIA3和PyTorch深度打通,从底层指令集到内存调度,全都为自家框架量身定制。别的公司要等三个月才能适配新模型,Meta的工程师两周就能上线。

去年,Meta在内部测试中把Llama 3的推理延迟从210毫秒压到135毫秒。这不是靠软件调优,是芯片和框架一起改出来的。这种“软硬一体”的节奏,是靠买芯片的公司永远追不上的。

全球AI芯片格局,正在悄悄变天

过去五年,AI芯片市场几乎就是英伟达一家的独角戏。但现在,情况变了。

谷歌的TPU、亚马逊的Trainium、微软的Maia,都在悄悄布局。但Meta是第一个敢在公开场合说“我们跑得比H100快”的公司——而且不是靠宣传PPT,是靠真实负载。

更关键的是,Meta已经不是“试用”阶段。他们计划在2025年底前,把超过60%的AI推理任务从英伟达芯片迁移到MTIA3。这意味着,未来一年,全球AI算力的供应链,将出现第一个真正能撼动英伟达地位的“替代选项”。

杨立昆的判断,正在变成现实

Meta首席科学家杨立昆(Yann LeCun)去年在一次内部会议上说:“如果你连芯片都控制不了,你谈什么AGI?”这句话当时被很多人当成口号。现在,它正在变成战略。

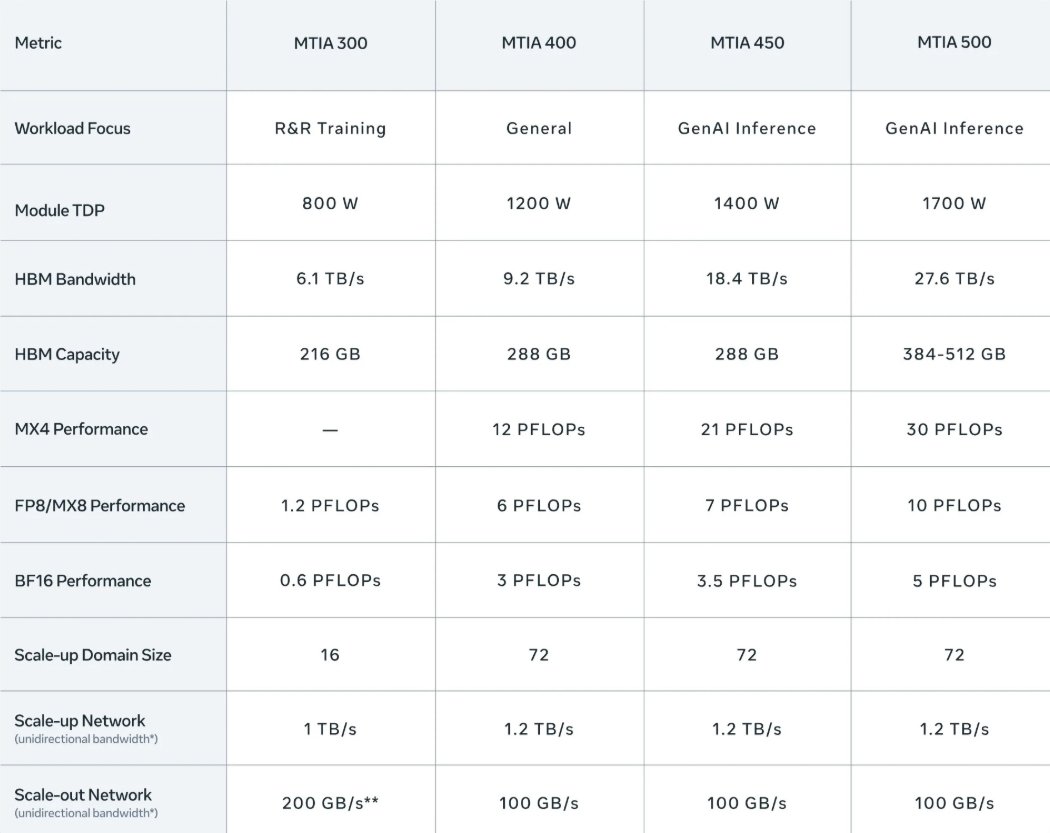

MTIA3不是终点。Meta已经透露,下一代MTIA4将在2026年进入研发,重点是支持多模态推理——比如同时处理文字、图像、语音的混合任务。而这一切,都建立在他们已经搭建好的自研芯片流水线上。

这不是一场“技术炫技”,而是一次“生存选择”。当全球AI竞赛进入下半场,能自己造引擎的公司,才真正握住了方向盘。