Anthropic 在 Claude Code 中推出名为 Code Review 的研究预览版服务,可在 GitHub 拉取请求创建或更新时自动执行代码审查。该服务会使用多个代理并行分析代码差异与整个代码库的上下文,识别逻辑错误、安全漏洞、边界条件问题与潜在回归风险,并以行内注释和总结意见的形式反馈到拉取请求中,但不会直接批准或阻止合并,原有人员工作流程仍保持不变。

Anthropic 将其内部已在多数拉取请求中使用的审查流程进一步产品化,对外提供服务。官方表示,随着内部工程师代码产出量增加,人工审查逐渐成为瓶颈,许多变更仅能获得快速浏览式检查。Code Review 正是针对 AI 提升开发效率后,团队更难维持深度审查这一实际问题而设计。

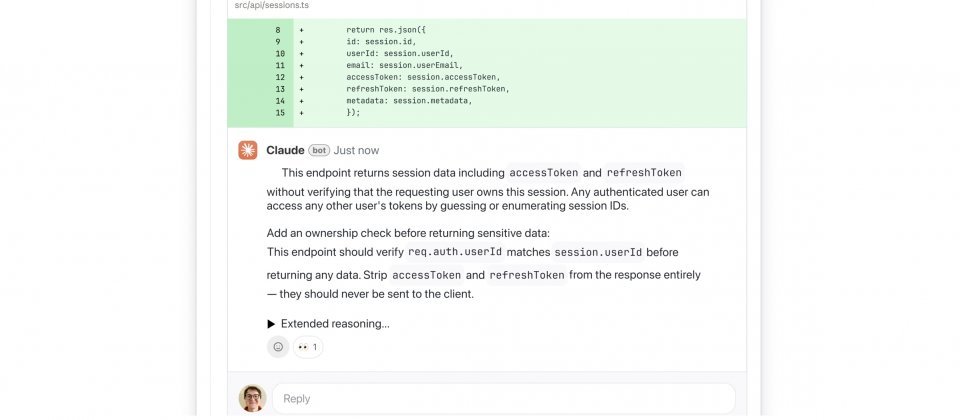

Anthropic 特意将 Code Review 与现有的轻量级 GitHub Actions 方案区分开来。官方文档指出,企业若希望在自有 CI 环境中运行 Claude,仍可选择 GitHub Actions 或 GitLab CI/CD;而 Code Review 是由 Anthropic 基础设施托管的服务,主打更完整的拉取请求审查体验。系统首先由多个代理识别潜在问题,再通过验证步骤过滤误报、去重,并按严重程度排序。Anthropic 表示,平均每次审查耗时约 20 分钟,拉取请求规模越大、上下文越复杂,成本也相应提高。

Code Review 按令牌(Token)用量计费,单次平均费用约为 15 至 25 美元。管理员可设置月度支出上限,选择启用的代码仓库,并决定是在拉取请求创建时仅审查一次,还是在每次推送更新后持续审查。管理界面提供数据分析仪表板,用于追踪已审查的拉取请求数量、每周成本,以及有多少审查意见因开发者修正而自动关闭。

目前,Anthropic 将 Code Review 列为研究预览版,面向 Team 和 Enterprise 方案开放。除 Anthropic 外,OpenAI、微软和 Google 等公司也已推出类似的人工智能代码审查功能。OpenAI 的 Codex 支持在 GitHub 拉取请求中通过 @codex review 请求审查,可配置为在新拉取请求开启时自动执行。微软 GitHub Copilot 也提供代码审查功能,默认允许用户将 Copilot 指定为审查者,并可按个人、仓库或组织级别设置为自动审查,必要时可在新推送后重新触发审查。Google 的 Gemini Code Assist on GitHub 会在新拉取请求创建后提供初步审查,也支持通过 /gemini review 手动触发审查。