可灵3.0登顶全球视频大模型榜首,中国AI再破世界纪录

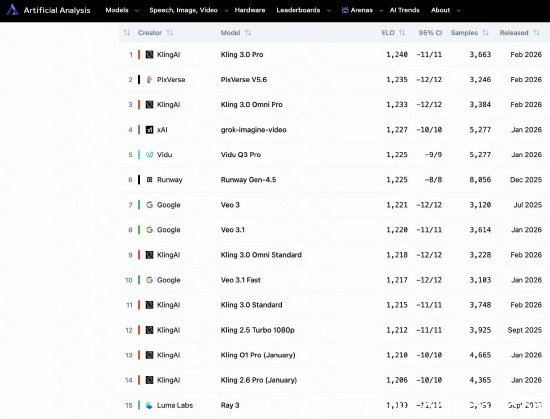

近日,全球权威AI测评机构Artificial Analysis发布了2026年最新视频大模型榜单,在文生视频(Text-to-Video)赛道中,由中国团队研发的可灵3.0 Pro(Kling3.0Pro)以1240分的高分强势登顶,超越OpenAI的Sora、Runway Gen-3、Stability AI的Stable Video等国际主流模型,成为全球首个在综合评分中突破1200分的视频生成模型。

更令人惊叹的是,在榜单前15名中,可灵系列共有7款模型入选,几乎占据半壁江山。从动态光影的自然过渡,到人物微表情的精准还原,再到多镜头长视频的一致性控制,可灵3.0在真实感、物理逻辑与导演级可控性上的表现,已让不少影视从业者直言:“这不再是演示,是真能用的工具。”

不只是炫技,正在改变影视制作流程

过去,AI生成视频常被看作“实验室里的玩具”——画面精美,但帧率不稳、逻辑断裂、角色变形。而可灵3.0的突破,让这些痛点大幅缓解。据多家国内影视工作室反馈,他们已开始用可灵3.0进行前期分镜预演、特效草稿生成,甚至直接产出广告片的实拍替代镜头。一位北京的独立导演表示:“以前一个30秒的雨中奔跑镜头,要租场地、等天气、请演员、拍十几次。现在输入一段文字,2分钟出成片,修改也只要改几行提示词。”

在工业级应用层面,可灵3.0支持长达120秒的连贯视频生成,帧率稳定在30fps,且能精准控制镜头运动、光照变化和角色动作。其“镜头语言理解”能力,甚至能根据“推拉摇移”“俯拍特写”等专业术语生成符合电影语法的片段,这在国际上尚属首次。

国产AI,正在从追赶者变成规则制定者

这不是一次偶然的领先,而是中国AI基础研究与工程落地能力的集中爆发。可灵系列背后是昆仑万维联合清华、中科院团队,历时三年打磨的视觉大模型架构。其训练数据涵盖超过50万小时的真实影视素材,涵盖东方美学、古装场景、城市街景等复杂环境,使其在文化语境理解上远超西方模型。

目前,可灵3.0已向国内多家影视公司、MCN机构和广告公司开放API接入。据不完全统计,2026年第一季度,使用可灵生成的商业视频内容已超80万条,其中近三成用于电视台宣传片、电商平台主视觉、短视频爆款内容。不少海外团队也开始主动联系合作,希望引入这套系统。

如果说Sora让我们看到AI能“画出电影”,那可灵3.0正在让我们相信:AI,真的能“拍出电影”。