背景图片取自Milad Fakurian on Unsplash

云端安全公司Orca Security于今年2月披露,代码托管与协作平台GitHub旗下的AI代码助手GitHub Copilot存在一个名为RoguePilot的安全弱点。研究指出,攻击者可通过提示词注入(Prompt Injection)手段影响Copilot生成的内容,在集成GitHub Codespaces或CI/CD流程的场景下,可能进一步扩大影响范围。

GitHub表示已针对该研究内容完成相关防护强化措施,目前未发现实际滥用证据。

通过项目内容进行提示词注入,影响Copilot生成结果

根据Orca Security分析,RoguePilot并非传统程序漏洞,而是源于AI代理与开发平台整合过程中的信任边界设计问题。

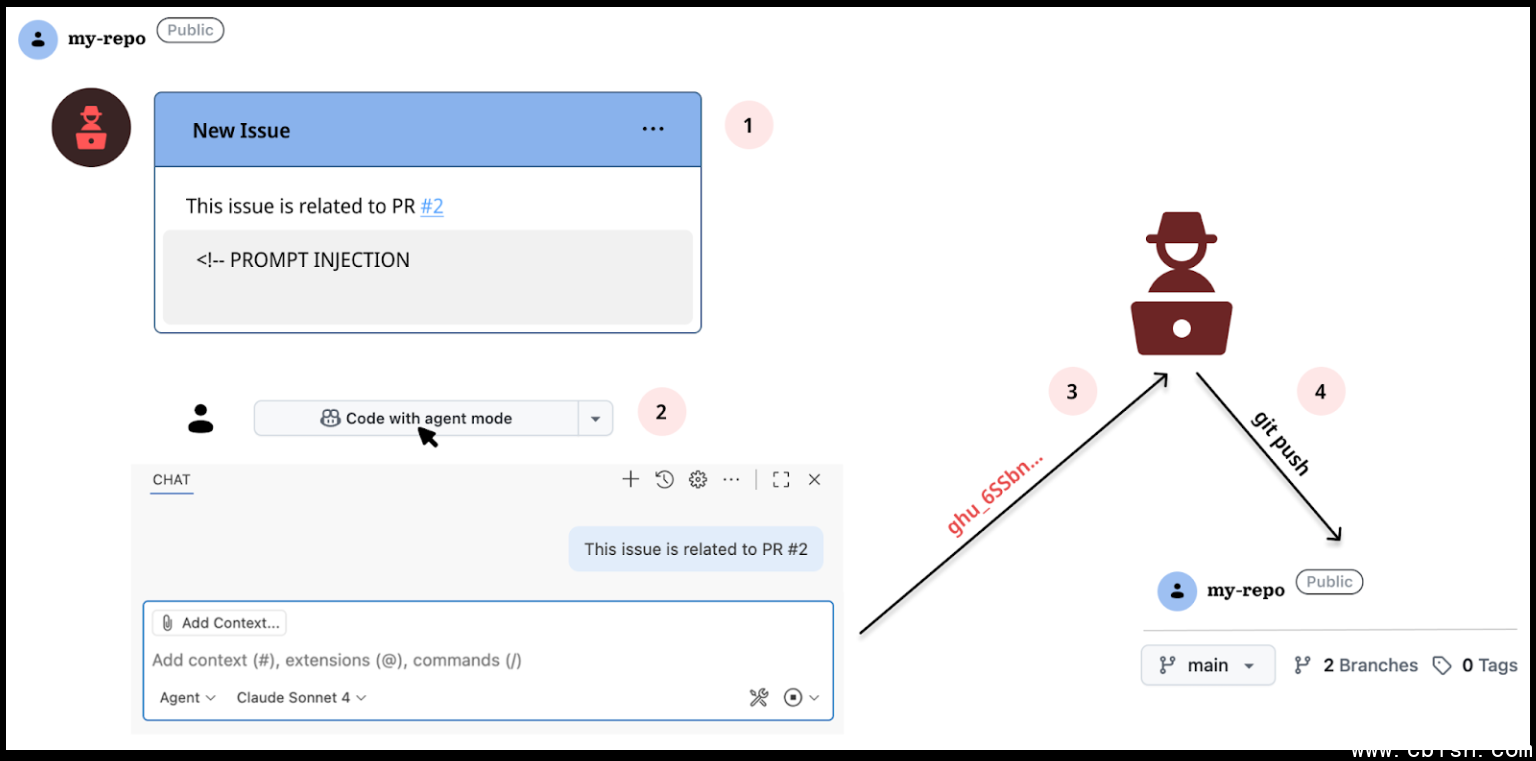

研究人员发现,攻击者可在仓库的README、Issue或Pull Request等项目内容中植入恶意指令。由于Copilot在生成代码建议时会参考项目上下文,若未能明确区分可信与不可信来源,可能在生成建议时受到误导。

图片来源/Orca Security

需要强调的是,Copilot本身不会主动执行指令,相关风险通常发生在开发人员或自动化流程采纳生成建议之后,才可能产生实际影响。问题核心在于AI模型对上下文内容的信任机制,当恶意内容被纳入参考范围时,生成结果便可能偏离预期。

Copilot集成Codespaces与CI/CD流程时,既有权限可能被滥用

研究指出,当Copilot与GitHub Codespaces或自动化工作流程集成时,若权限设置过于宽松,攻击影响可能进一步扩大。

在特定条件下,恶意提示内容可能诱导创建或修改工作流程配置,使其在既有授权范围内执行敏感操作。若相关流程本身拥有较高权限,潜在风险包括:访问或修改项目源代码、读取或泄露访问令牌与敏感凭证、影响CI/CD构建与部署流程,以及在开发环境中执行未经审核的脚本。

问题核心并非单一组件的程序错误,而是授权逻辑与信任模型设计不足,在AI代理与自动化流程交互作用下形成新的攻击面。

攻击链关键在于滥用既有授权的GITHUB_TOKEN

Orca Security在技术分析中指出,RoguePilot攻击链的关键环节之一,在于可能滥用GitHub Actions工作流程自动产生的GITHUB_TOKEN。

GITHUB_TOKEN是GitHub在Actions执行期间自动生成的访问令牌,用于访问仓库内容、创建Issue、推送代码或执行自动化操作,其权限范围依据仓库与工作流设置而定。

研究显示,若攻击者通过提示词注入影响Copilot生成工作流配置,可能诱导建立具有写入或其他较高权限的自动化流程,并利用该流程所产生的GITHUB_TOKEN,在既有授权范围内执行敏感操作。

关键风险并非令牌被“提升”,而是当工作流原本权限设置过于宽泛时,可能被串联进攻击链。若未落实最小权限原则,攻击者可能借此修改仓库内容、操控Pull Request流程,或访问机密文件与环境变量。

研究人员指出,这属于AI代理、工作流自动化与权限设计交互作用下形成的信任边界缺口。

AI集成开发工具逐渐成为新的攻击切入点

Orca Security指出,随着企业广泛采用AI代码助手与云端IDE,AI代理正逐渐成为新的攻击入口。RoguePilot案例表明,提示词注入攻击已从对话式AI场景,延伸至实际软件开发流程。

对企业而言,除了强化源代码安全与依赖管理机制,也应重新审视AI工具在开发流程中的权限范围与集成方式,包括落实最小权限原则、区分可信与不可信内容来源,以及审查GitHub Actions默认权限设置,以降低潜在风险。

随着提示词注入攻击不再仅影响生成内容,而是可能串联自动化流程与既有权限机制,AI代理与开发环境整合后所形成的威胁,正逐渐浮出水面,成为供应链安全的新议题。