万亿参数时代,一张坏显卡能毁掉数周算力

当AI模型的参数量突破万亿,训练集群动辄需要上万张A100或H100显卡协同工作。这不再是简单的“多加几台服务器”就能解决的问题——哪怕只有一张GPU出现“静默故障”:表面正常、温度正常、灯还亮着,但计算速度下降30%以上,整个训练任务的梯度就会被污染,模型收敛方向彻底偏移。而这种问题,往往要等到训练进行到第20天、损失曲线突然飙升时,工程师才后知后觉。

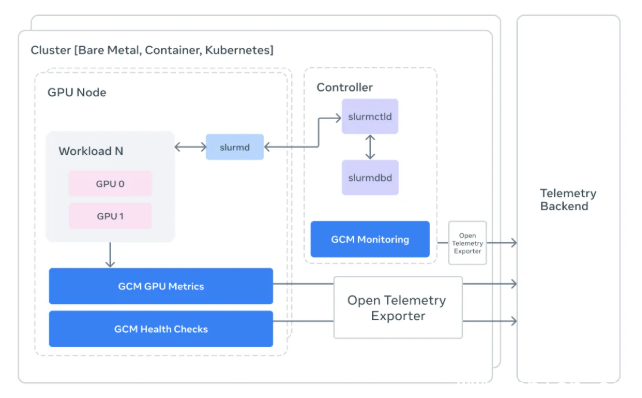

Meta AI团队最近开源的GCM(GPU Cluster Monitoring)工具包,不是又一个“监控面板”,而是一套真正能“抓内鬼”的系统。它不满足于告诉你“集群负载85%”,而是能精确告诉你:“任务ID 48291,第7号节点,FP16算力下降41%,从2.3 TFLOPS掉到1.37 TFLOPS”。这不是报告,是现场取证。

不是看仪表盘,是看“显卡病历”

过去,运维人员面对集群故障,只能靠经验猜:是网络抖了?散热不良?驱动冲突?GCM彻底改变了这个过程。它在每个训练任务启动前,自动执行一套“入院体检”:检查PCIe链路稳定性、NVLink带宽是否达标、显存ECC错误率是否异常;任务结束后,立刻调用NVIDIA DCGM(Data Center GPU Manager)做深度诊断,生成一份包含时钟频率波动、内存错误计数、功耗曲线的完整报告。

所有数据统一转换为OpenTelemetry格式,直接接入Grafana,形成“GPU健康仪表盘”。你看到的不再是抽象的曲线,而是每张卡的“体检单”:红色标记代表“已发现潜在故障”,黄色代表“接近阈值”,绿色代表“稳定运行”。运维人员一眼就能识别出哪些卡在“带病上岗”,提前下线,避免拖垮整个任务。

和Slurm深度绑定,故障归因从“猜”变成“查”

在大多数AI集群里,任务调度用的是Slurm。但传统监控工具和Slurm是“两张皮”——你看到的是整个节点的功耗,却不知道是哪个任务在搞鬼。GCM直接嵌入Slurm作业生命周期,在任务提交、运行、结束三个节点自动打点。

举个真实场景:一个研究员提交了128卡的训练任务,三天后发现loss异常。传统做法是:登录每个节点,手动跑nvidia-smi,翻日志,比对时间戳,耗时半天。GCM呢?打开Grafana面板,点一下任务ID 50123,立刻弹出:该任务使用了节点gpu-07、gpu-19、gpu-44,其中gpu-19在第48小时开始出现FP16算力持续下降,同期该节点的显存ECC错误数从0上升到17次。结论清晰:就是它。

这不是“监控”,是“司法取证”。连Meta内部的工程师都说:“以前是消防员救火,现在是刑侦队破案。”

不是实验室玩具,是数据中心的实战武器

GCM不是Demo,它已经在Meta内部支撑了超过200个万亿级模型训练任务。根据Meta工程团队披露的数据,引入GCM后,因硬件故障导致的训练失败率下降了67%,平均任务恢复时间从72小时缩短至8小时。

更关键的是,它完全开源,不依赖任何私有协议。你不需要买Meta的硬件,也不用换掉现有Slurm集群。只需在节点上部署几个轻量级采集器,配置好Prometheus和Grafana,就能立刻获得企业级的GPU健康监控能力。GitHub仓库里甚至附带了完整的Docker部署脚本和Kubernetes Operator模板。

对中小型AI团队来说,这意味着什么?你不必花几百万买“全栈AI运维服务”,也能用开源工具,把显卡的“隐形杀手”揪出来。一张坏卡,可能让你损失几十万的算力成本。GCM,就是那道低成本的防火墙。

你不需要懂AI,但你必须懂显卡

训练大模型的时代,真正的瓶颈不再是算法,而是硬件的可靠性。GCM的出现,标志着AI基础设施从“能跑就行”走向“必须稳如磐石”。它不炫技,不吹牛,只做一件事:让每一张显卡,都经得起 scrutiny(审查)。

如果你正在管理一个超过100张GPU的集群,无论你是创业公司还是高校实验室,GCM不是“可选工具”——它是避免项目烂尾的最后防线。