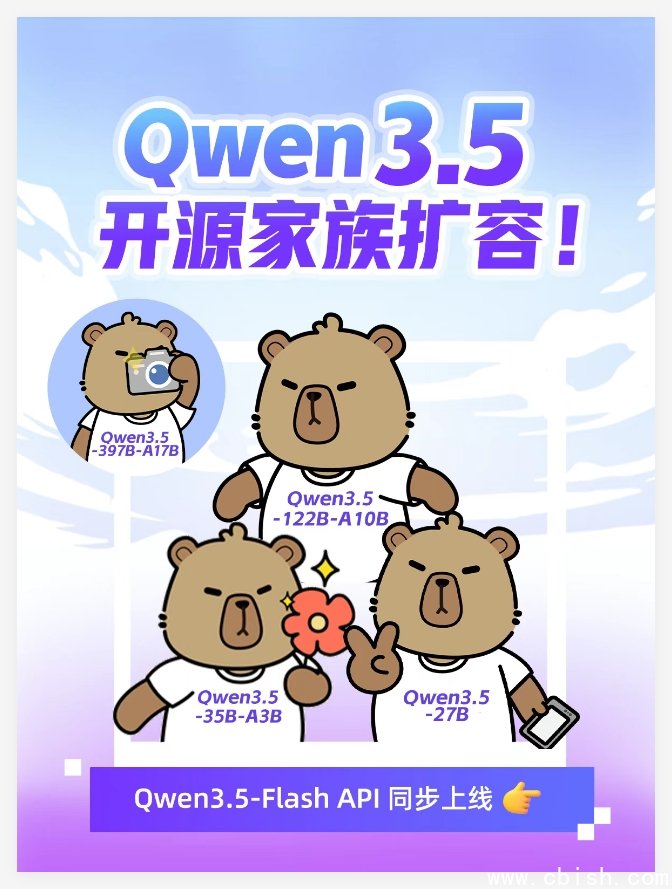

Qwen3.5家族全面升级:更小、更快、更强,开源与API同步开放

就在昨天,通义千问团队正式发布Qwen3.5系列新模型,一口气推出三款开源版本,同时在阿里云百炼平台上线了专为企业打造的Qwen3.5-Flash API服务。这不是一次简单的参数堆叠,而是一场关于“效率”和“可用性”的全面重构。

三款新模型,瞄准不同场景

Qwen3.5-122B-A10B 是为复杂任务而生。它在多步推理、调用外部工具、规划执行等Agent类任务中表现突出,甚至在部分测试中逼近GPT-4o的水平。如果你正在开发需要“动脑筋”的自动化系统——比如智能客服流程编排、金融报告自动生成,这款模型值得优先尝试。

Qwen3.5-35B-A3B 才是这次最大的惊喜。它参数量不到前代Qwen3-235B的一半,但在多个权威评测中反超了那个235B的“巨无霸”。这不是运气,而是架构优化、数据清洗和强化学习协同的结果。简单说:更小的模型,跑出更强的智能。对资源有限的团队来说,这意味着更低的部署成本和更高的回报。

Qwen3.5-27B(Dense) 则是为“轻装上阵”设计的。没有MoE结构,没有复杂拆分,纯稠密架构,能在消费级显卡(如RTX 4090)上流畅运行。适合中小企业、独立开发者做本地部署、私有化微调,或者用于教育、科研中的快速实验。它的目标很明确:让大模型不再高高在上。

企业级API上线:开箱即用,百万token上下文

与此同时,阿里云百炼平台同步上线了Qwen3.5-Flash API,直接对齐Qwen3.5-35B-A3B的性能。它不是“封装版”,而是从底层优化过的生产级服务:

- 默认支持100万tokens的上下文——相当于一次性处理一本500页的书,或整份财报+会议纪要+行业报告。

- 内置官方工具链:支持搜索、代码执行、数据库查询、文件解析,无需自己写接口,调用即用。

- 响应速度比上一代快40%以上,延迟稳定在200ms内,适合实时交互场景。

- 按用量付费,无隐藏成本,支持企业级SLA和私有部署选项。

已经有团队在用它做智能合同审核、客户投诉自动分类、内部知识库问答系统。一位来自杭州的SaaS创业者告诉我:“原来要花两周集成的AI功能,现在一天就上线了。”

开源免费,企业可用,选择权在你

无论你是个人开发者、初创公司,还是大型企业,都能找到适合自己的入口:

- 开源用户:可在 GitHub、Hugging Face、魔搭(ModelScope)下载全部模型权重,支持本地微调、二次开发,完全免费。

- 企业用户:登录阿里云百炼平台,注册即送免费额度,10分钟内就能接入API,无需懂模型、不用管算力。

这一次,阿里云没再强调“参数世界第一”,而是把重心放在了“谁都能用、用得顺手”上。大模型的下一阶段,不是比谁更大,而是比谁更实用。