容器平台厂商Docker于2025年11月发布Docker Desktop 4.50.0版本,修复了其AI辅助功能Ask Gordon所涉及的安全风险。相关问题最早由安全研究团队Noma Labs披露,研究指出,在特定情境下,AI分析流程可能受到不可信输入的影响,进而对开发环境带来供应链风险。Docker在同一版本中一并处理了Pillar Security通报的提示注入问题。

Ask Gordon是Docker Desktop内置的AI助手,主要用于协助开发者理解错误信息、分析项目内容,并提供容器与云环境的操作建议。Docker官方文档说明,Ask Gordon目前仍处于测试阶段(Beta),尚未作为正式功能开放。根据目前Docker与安全界的公开信息,相关安全问题未分配正式的CVE编号,而是通过功能调整与风险缓解方式进行处理。

由于Ask Gordon在分析过程中会根据使用场景读取项目目录内容以及镜像相关的元数据,研究人员指出,若缺乏明确的输入验证与信任边界控制,这些信息可能被纳入AI推理上下文,影响分析结果与建议内容。

研究揭示AI分析流程在特定条件下的潜在风险

Noma Labs在研究报告中指出,Ask Gordon在分析项目时,会收集镜像或项目相关的元数据,例如Docker镜像的元数据或Dockerfile中的LABEL信息,并将其纳入AI推理上下文。在特定情境下,若这些元数据被预先植入误导性内容,可能影响AI生成的分析建议,进而干扰开发或部署决策。

研究人员说明,这类风险并非源于对Docker基础架构的直接入侵,而是与AI辅助工具在开发流程中所扮演的高信任角色有关。当分析对象来自外部或来源不明时,相关风险可能被放大,因此被视为新型的AI供应链风险。

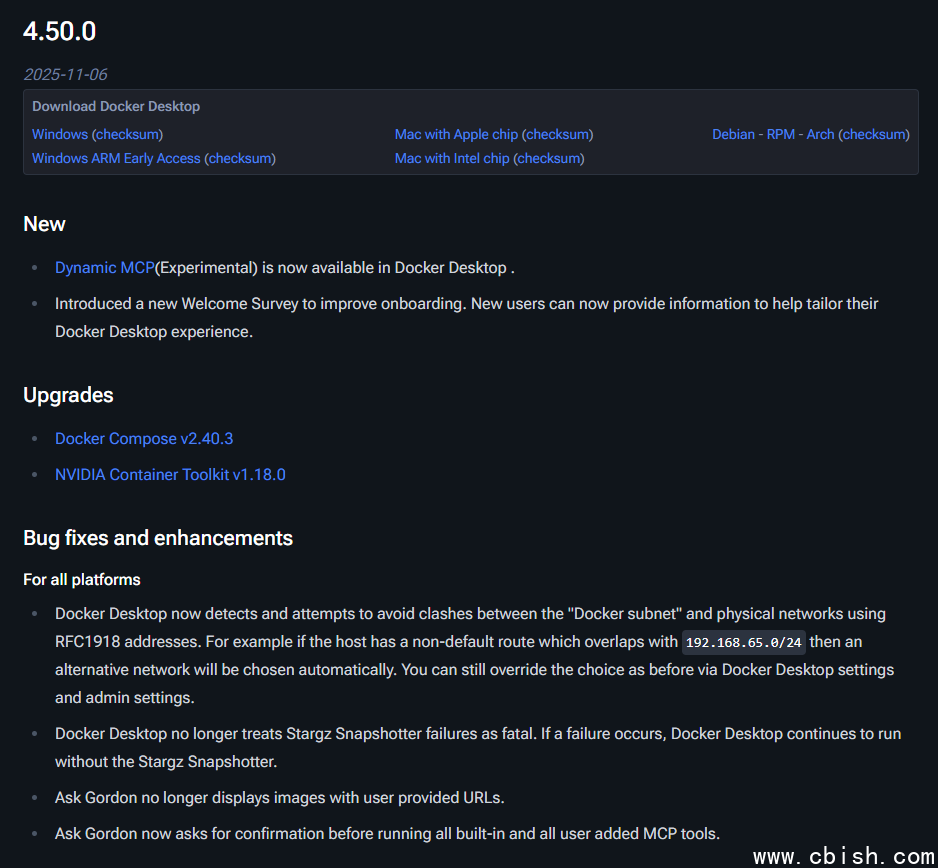

Docker Desktop 4.50.0调整分析流程,降低不可信输入的影响

Docker在官方文档中表示,Docker Desktop 4.50.0已对Ask Gordon的数据处理与分析流程进行调整,在执行内置或用户新增的MCP工具前,要求用户进行确认,以降低不可信输入对分析流程的影响。此外,Ask Gordon不再显示用户提供的外部URL图片,以减少不可信内容干扰分析结果的风险。

Docker同时提醒,Ask Gordon仅作为辅助工具,AI提供的建议内容仍需由开发者自行审查与判断,避免在未经验证的情况下直接应用于实际部署环境。相关问题目前多停留在研究演示与情境分析阶段,公开报道中尚未提及实际被利用的案例;Docker已通过更新完成风险缓解。

为降低相关风险,用户可评估升级至Docker Desktop 4.50.0或更高版本,并在团队内部建立明确的使用规范,避免在分析外部项目或来源不明的内容时过度依赖AI自动化建议,以降低开发环境成为潜在攻击跳板的风险。