DeepSeek OCR2来了:看懂文档,不再靠“扫雷”

最近,中国AI公司DeepSeek发布了一个让人眼前一亮的新工具——DeepSeek OCR2。它不靠死板地“一行一行读图”,而是像人一样,盯着重点看,跳过没用的空白,快速抓住关键信息。这可不是简单的识别文字升级,而是一次对“怎么看图”的根本性重构。

为什么传统OCR总“看错顺序”?

过去,大多数OCR系统把一张图片切成无数小格子,像扫雷一样挨个识别,再按固定顺序拼起来。结果呢?表格错位、段落颠倒、发票上的数字被串读,成了家常便饭。尤其是处理合同、财报、手写笔记这类复杂文档时,错误率高、速度慢,还得人工反复校对。

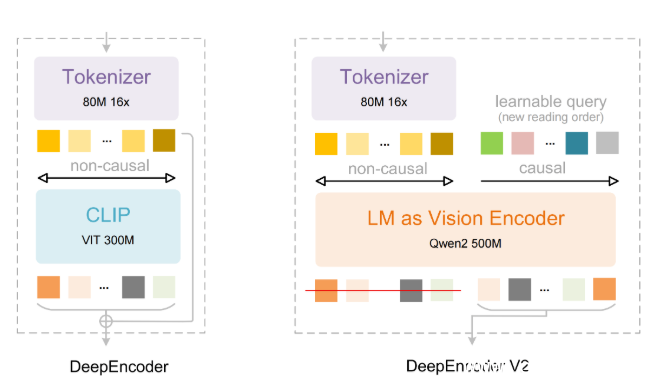

DeepSeek OCR2彻底换了思路。它不再“按网格走”,而是模仿人眼——看到标题就先停,看到表格就聚焦,看到签名就标记。它用一种叫“因果流Token”的新方法,让模型自己判断:“这段文字和前面有什么关系?后面该接什么?”

省了80%的算力,速度和成本双降

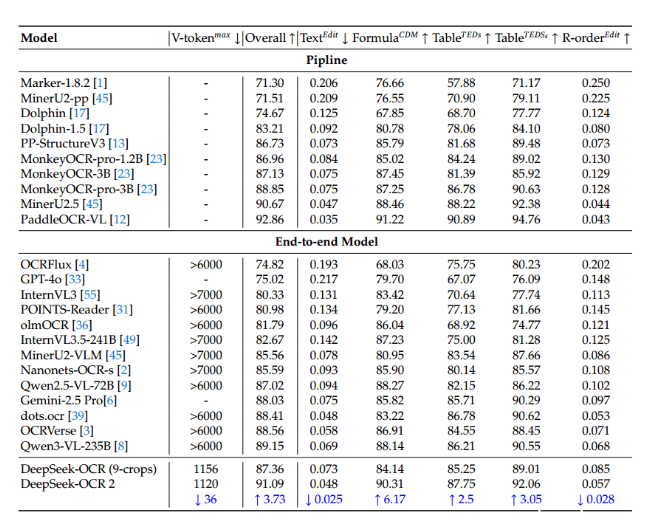

传统模型处理一张A4文档,动不动就要用6000多个“视觉Token”(相当于6000个像素块的分析任务)。DeepSeek OCR2呢?平均只要256到1120个——减少了80%以上。

这意味着什么?

- 企业用它处理十万份发票,服务器成本直接砍半;

- 手机端也能跑,不用连云端,隐私更安全;

- 处理一份100页的年报,从30秒缩短到5秒内。

这不是实验室里的数字游戏——这是真能省下真金白银的优化。

实测碾压Gemini 3 Pro,开源了

在权威文档理解测试集OmniDocBench上,DeepSeek OCR2以91.09%的准确率拿下第一,比谷歌的Gemini 3 Pro还高了近3个百分点。尤其在处理混合排版、中英文混排、手写批注、模糊印章等“现实世界难题”时,表现远超同类产品。

更让人意外的是——他们把代码和模型权重全开源了。GitHub上已经可以下载,开发者可以直接用在自己的系统里,不用交钱、不用申请权限。不少企业技术负责人已经悄悄在测试,准备替换掉用了一年的商业OCR服务。

不只是OCR,是“看得懂”的开始

DeepSeek团队说,这一步不只是为了“认字”。他们真正想做的,是让AI不再“看图识字”,而是“看图理解”。

未来,同一个模型可能同时处理:

- 你拍的一张餐费发票——识别金额、日期、商户;

- 一段语音会议记录——听清发言内容;

- 一份PPT截图——理解图表逻辑。

不需要三个系统,一个模型全搞定。这不是科幻,而是他们正在铺的路。

现在就能用

如果你是财务、法务、档案管理员,或者在做自动化流程开发,现在就可以去GitHub下载DeepSeek OCR2,直接跑起来试试。不需要GPU服务器,普通电脑也能跑得飞快。

它不炫技,不吹概念。它只是做了一件事:让机器看文档,不再像机器人,更像人。