美国艾伦AI研究院AI2发布开源编程代理(Open Coding Agents)计划,首波推出SERA开源编程代理模型,并公开训练数据与可复现的后训练流程。AI2的目标是让开发团队能够快速将模型适配到特定代码库,包括企业内部或个人私有仓库,同时将模型与集成工具发布到公开平台,供外部使用。

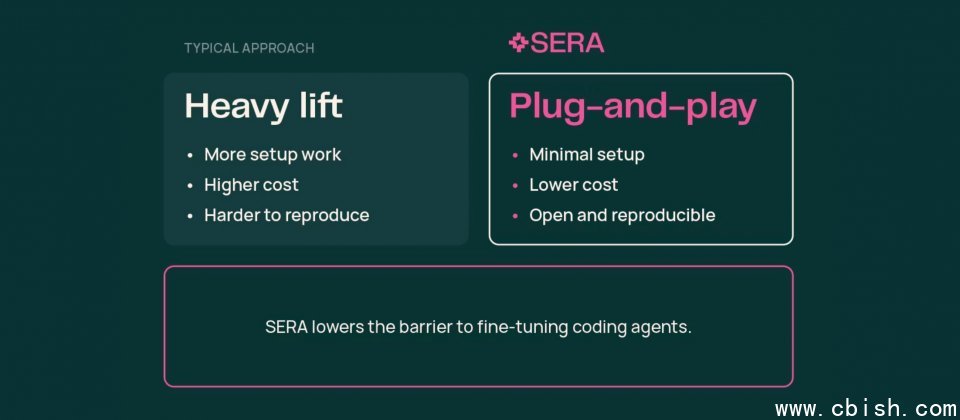

AI2指出,封闭式模型通常未接触过组织内部的代码与规范,因此在数据管道、内部API或代码风格等场景中容易出现理解偏差。AI2提出一种以合成数据驱动的后训练方法,旨在降低私有代码库适配的门槛。官方估算,复现此前最佳开源成果约需400美元的计算资源;若要将性能提升至同尺寸业界顶尖模型水平,最高成本约1.2万美元,使实验室和小型团队也能负担完整的训练方案。

在基准测试中,AI2表示SERA-32B在SWE-Bench Verified上的解题率可达54.2%,并称仅需约40个GPU日或更少即可完成训练,部署时可直接兼容Claude Code。AI2还与NVIDIA合作,进行推理优化,提升在H100与B200等平台上的吞吐量。

AI2将SERA定位为高效率的验证型仓库代理,其做法是先生成包含补丁的合成开发轨迹数据。这些补丁无需完全正确或通过完整测试验证,即可用于训练,从而降低对测试环境与测试基础设施的依赖,同时压缩合成数据生成成本。AI2还引用了现有分析整理的51种常见代码缺陷类型,扩充数据多样性,使同一段函数代码能衍生出多种任务场景,提升训练数据的覆盖范围。

在针对特定仓库进行适配后的表现上,AI2使用Django、SymPy与Sphinx等SWE-Bench大型仓库进行项目化训练,称每个仓库仅用8,000条合成开发过程数据进行监督式微调,即可在部分设置下达到或超越教师模型GLM-4.5-Air,并公布在32K上下文条件下,Django与SymPy的得分分别为52.23%与51.11%。

AI2还发布了SERA CLI与Claude Code兼容层,并在PyPI提供ai2-sera-cli包,说明其用途是让Claude Code CLI能够对接SWE-agent格式模型。官方表示,本次发布内容涵盖模型、集成工具与训练流程,使研究者能够查看数据与方法,并在自身环境中复现与拓展应用。