微软周一(1/26)发布新一代推理AI加速芯片Maia 200,这是微软在自研AI芯片计划中首个实现大规模商用部署的版本;随着生成式AI进入实际运营阶段,微软正将AI算力从单一性能竞赛,推进到长期可扩展、成本可控的云基础设施层面。

Maia并非通用GPU的替代品,而是专为大规模AI推理设计的云端加速器,首次于2023年Ignite大会对外公布。

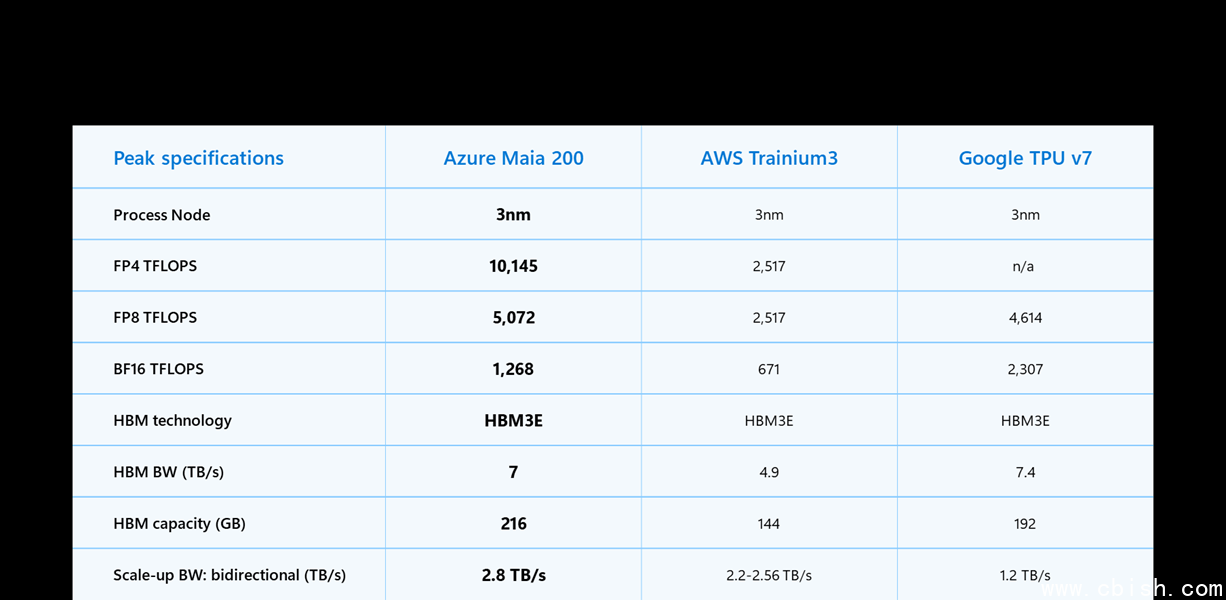

新一代Maia 200采用台积电3纳米制程打造,内置原生FP4与FP8 Tensor核心,并配备216GB HBM3e、7TB/s内存带宽与272MB片上SRAM,整体设计明确聚焦低精度推理与高Token吞吐需求。微软指出,Maia 200在FP4运算性能上约为第三代AWS Trainium的3倍,FP8性能也高于谷歌第七代TPU,且在其实验室数据中心的实际部署中,性能成本比提升约30%。

尽管Maia 200在硬件形态上是一颗AI加速芯片,但其设计并未止步于芯片本身。微软在开发过程中同步定义了芯片的互连方式、数据中心网络拓扑、机架配置与散热方案,使Maia 200能够直接融入Azure数据中心,作为可规模化部署的AI推理计算单元。

目前微软已将Maia 200部署于Azure数据中心,用于支持包括OpenAI最新GPT-5.2系列模型、Microsoft 365 Copilot与Microsoft Foundry等服务。Maia 200主要承担高频次的Token生成任务,作为GPU之外的另一条推理计算路径,降低对单一硬件平台的依赖,并提升AI服务在高负载状态下的成本可预测性。

此外,微软内部的超级智能团队也使用Maia 200进行合成数据生成与强化学习,支持下一代自研模型的研发流程。这使得Maia不仅服务于既有产品的推理任务,也被纳入模型开发与优化体系之中。