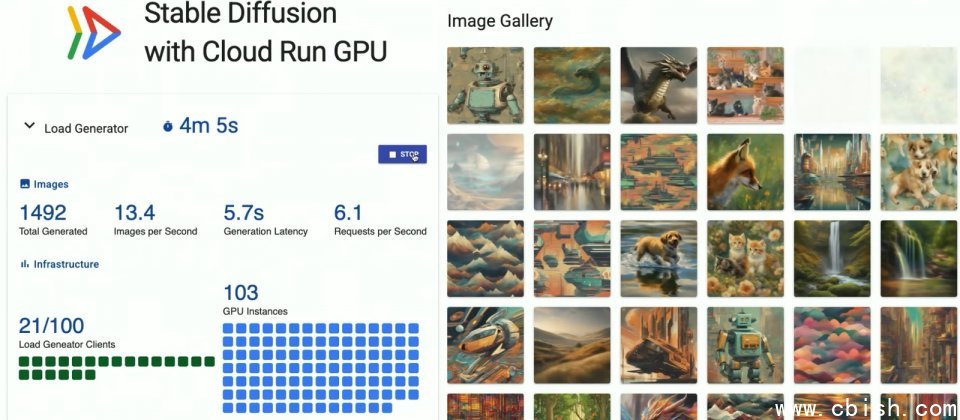

Google正式发布Cloud Run GPU,用户可直接在Cloud Run服务启用Nvidia L4 GPU,无需申请配额。此功能使开发团队能弹性部署生成式人工智慧、深度学习推论与批次运算等工作负载,同时降低资源闲置带来的成本,提升运算弹性。

Cloud Run採无服务器运作模式,支援自动扩展、弹性部署与简化管理。本次新增GPU支援后,开发者可透过指令或控制台选项启用GPU加速。

系统提供按秒计费及自动缩减至零的调度能力,有助于降低闲置资源的费用并提升使用效益。根据Google官方测试,Cloud Run GPU服务在冷启动时约5秒内可完成GPU与驱动程序启动。以Gemma 3:4b模型推论为例,从冷启动至产生第一个Token约需19秒,具支援互动性应用的能力。

在服务可靠性方面,Cloud Run GPU纳入Cloud Run既有SLA,并提供分区备援与弹性部署。企业可根据营运需求部署于多个区域以提升可用性,或选择关闭分区备援以调整资源配置。Cloud Run GPU目前已于美国、欧洲及亚洲多个区域上线,供企业在全球市场部署应用,减少跨区延迟。

Cloud Run Jobs现也已支援GPU,开发者可用于模型微调、批次推论、影片转档与图像处理等非同步运算任务。开发者可根据需求启动、执行与释放GPU资源,无需自建基础设施,即可执行弹性运算任务。