全新大型语言模型Gemini Diffusion,是Google首次将扩散式(Diffusion-based)生成机制应用于人工智慧文字生成领域的实验性产品。不同于现有多数以自我迴归(Autoregressive)架构、逐字生成的语言模型,Gemini Diffusion导入扩散模型概念,强调可同时生成多个Token,并能于生成过程中持续修正内容,有效提升效率与品质。

根据Google说明,传统大型语言模型如Gemini 2.0及OpenAI GPT系列,均以自我迴归方式运作,每次依据前序Token预测下一个Token,直至完成整段文字。这种逐步生成机制虽在语言理解与产出已具成熟应用,但在长文本、多轮互动或需快速产生内容的情境,易受生成速度与一致性限制,也可能有错误累积等问题。

Gemini Diffusion的技术基础,来自近年影像生成领域广泛採用的扩散式生成模型,如Stable Diffusion等,这些模型证明扩散式生成方法具备良好的资料复原与生成效能。Gemini Diffusion将此机制导入文字生成,据现有资讯,模型主要以高比例遮罩(Mask)或近似杂讯的Token序列为起点,经多轮反覆修正,逐步复原出品质与一致性兼具的文字内容。

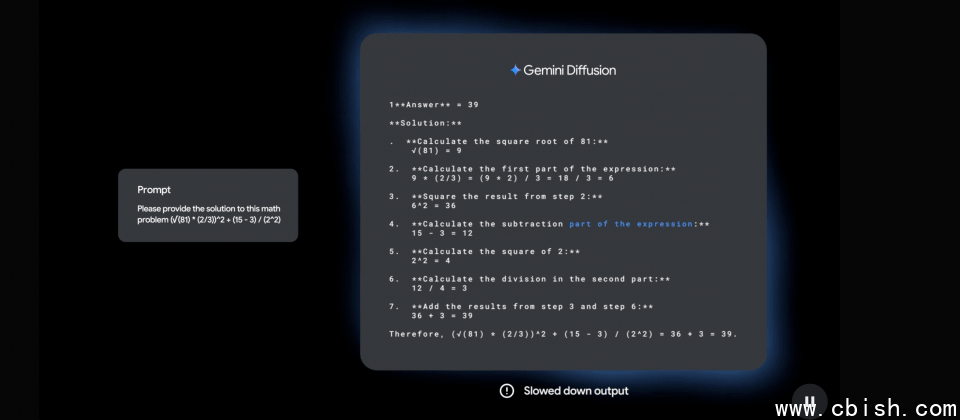

Google公开的内部基準测试显示,Gemini Diffusion在部分文字生成任务的运算速度有着明显提升,官方资料最高平均达每秒1,479 Token,明显高于Gemini 2.0 Flash-Lite等传统模型。在程序码、数学及科学等基準测试,Gemini Diffusion也展现出高速与内容一致性的潜力,模型在生成过程会自动修正错误,有助于长文本、结构化资料与程序码片段等需高一致性的应用情境。

针对Gemini Diffusion的体验,知名框架Django专案共同创办人Simon Willison于个人部落格分享测试体验,他测试Gemini Diffusion后认为模型生成速度显着提升,并认为Google所宣称的速度毫不夸张。Simon Willison引用Google资料表示,Gemini Diffusion可在维持类似品质下,达到Gemini 2.0 Flash-Lite模型5倍的生成速度,他以建置模拟聊天应用程序为测试,Gemini Diffusion仅需数秒即可产生互动式HTML及JavaScript页面。

Gemini Diffusion目前仍属实验性产品,Google现开放有兴趣的开发者申请候补名单参与测试。