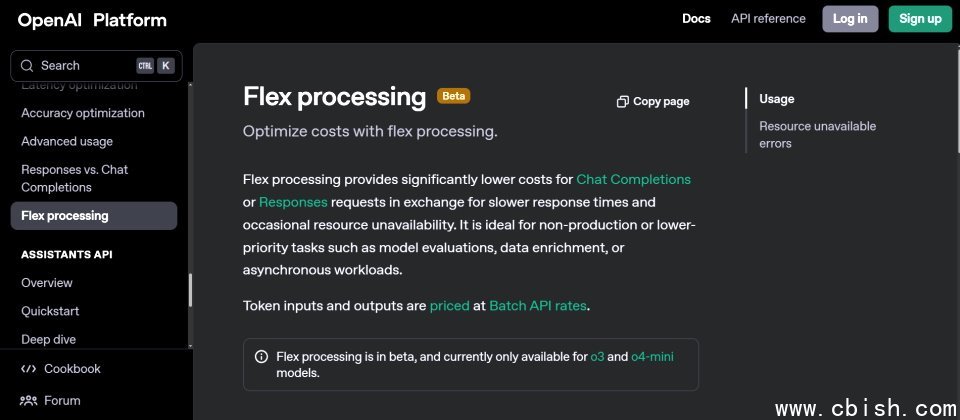

OpenAI开始测试一个名为Flex Processing的API选项,顾名思义,它具备弹性处理的特性,回应时间可能比较慢,偶尔还会出现资源不可得的状态,但它的价格只有传统API的一半,由于尚处测试阶段,因此目前仅支援o3及o4-mini模型。

OpenAI说明,Flex Processing可大幅降低开发者在对话补全(Chat Completions)或回应(Responses)请求上的成本,代价是可能会有较慢的回应时间,或是偶尔会出现资源不可得的情况。然而,它非常适合非生产或低优先性的任务,像是模型评估,资料扩充,或是非同步的工作负载等。

目前OpenAI平台的定价页面上已经出现了Flex API,它的价格与Batch API一致,切换就能看到相关价格。

o3模型原本每百万个输入Token的价格为10美元,每百万个输出Token的价格为40美元,o4-mini每百万个Token的输入与输出则分别是1.1美元与4.4美元,但切换至Flex API之后,它们的价格分别只要5美元、20美元、0.55美元与2.2美元。

开发人员只要在API请求中,将service_tier参数设为flex即可启用该功能,OpenAI提醒,以官方OpenAI SDK送出API请求时,其预设的超时时间为10分钟,倘若提示过于冗长或任务相对複杂,可能需要提高该数字,此外,当遇到资源不可得时,可採用指数退避机制来重试请求。

相较于Batch API主要用来处理大量任务,并非即时,且处理时间的上限长达24小时,Flex Processing依然倾向于即时处理,只是可能会稍微有些延迟。