英伟达发布Nemotron3 Nano Omni:一款真正能“看懂”世界的AI模型

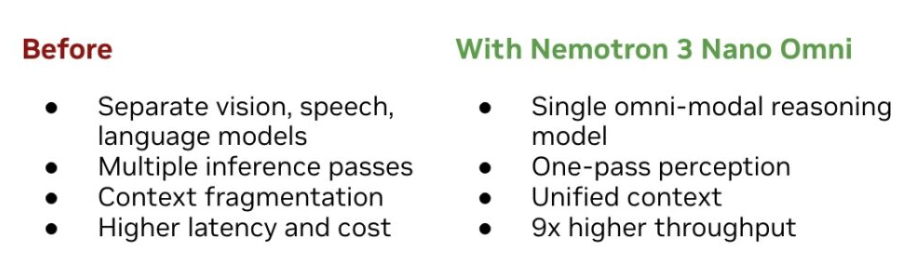

4月28日,英伟达正式推出Nemotron3 Nano Omni——这不是又一个参数堆砌的“大模型”,而是一个能同时听、看、读、想的AI系统。它不再依赖多个分开的模型分别处理图像、视频或语音,而是把所有感知能力直接“焊”进一个系统里。开发者不再需要拼接十几个API,也不用担心不同模块之间的延迟和错位。你给它一段视频,它能立刻告诉你画面里的人在说什么、背景音乐是什么、文字标识的内容,甚至能判断情绪和动作意图。

技术上,它用的是30B-A3B的混合专家架构(MoE),听起来术语不少,但实际体验很简单:你问它“这段会议录像里,谁在第37秒皱了眉头?”——它能精准定位,不卡顿,不猜谜。过去,这类任务需要调用图像识别、语音转文字、自然语言理解三个独立系统,耗时至少2秒以上。现在,Nemotron3 Nano Omni在150毫秒内完成,响应速度接近人类眨眼。

不是实验室玩具,是真正在用的工具

英伟达公布的性能数据不是PPT里的数字,而是实打实的榜单第一:在包括MMLU、VideoQA、AudioSet、DocVQA、HELM和MMBench在内的六大主流多模态评测中,它全部登顶。但真正让企业心动的,是它“9倍吞吐量”的背后意味着什么——你可以用一台普通服务器跑通过去需要10台机器才能完成的AI任务。某家做智能客服的公司测试后说:“我们把原本需要12台GPU的系统,砍到只剩一台,成本降了70%,响应还更快了。”

H Company的CEO Gautier Cloix提到的“实时解读全高清屏幕录像”,不是夸张。他们已经用它来监控远程办公员工的操作流程——不是为了监控人,而是为了自动识别界面操作中的高频卡点。比如,某个按钮总被点错三次才成功,系统会自动标记并建议优化UI。这不再是“AI帮你写邮件”,而是“AI帮你改产品”。

开放、兼容、能落地

Nemotron3 Nano Omni不是孤岛。它支持直接接入你的私有云模型,也能和Hugging Face、LlamaIndex这些开源生态无缝对接。你不用重写代码,也不用放弃现有的AI工具链。它就像一个“多语言翻译器”,能把你的旧系统和新能力连在一起。

过去一年,整个Nemotron3系列(包括Nano、Super、Ultra)下载量已超5000万次,是目前开源领域最活跃的多模态模型家族。这次Nano Omni的发布,不是为了炫技,而是为了让更多中小企业、独立开发者、甚至教育机构,都能用上以前只有大厂才敢用的感知级AI。

如果你正在开发智能客服、工业质检、教育辅导、数字孪生或车载交互系统——这个模型不是“下一个趋势”,它已经是你可以今天就下载、测试、上线的工具。没有复杂部署,没有天价算力门槛,只需要一个支持CUDA的显卡,就能跑起来。

英伟达这次,没说“革命”,也没提“AGI”。它只是默默放出了一个能真正干活的AI。而市场,已经用下载量和实测反馈给出了答案。