GLM-5.1:能自己写代码、修系统、持续工作的开源AI助手

最近,智谱AI发布的GLM-5.1在开源圈引发不小震动。它不是那种只能回答问题的聊天机器人,而是一个能连续工作8小时、独立完成复杂工程任务的AI开发伙伴。你给它一个目标,它就能自己规划步骤、写代码、调试、优化,直到交付成果——就像一个不知疲倦的高级工程师。

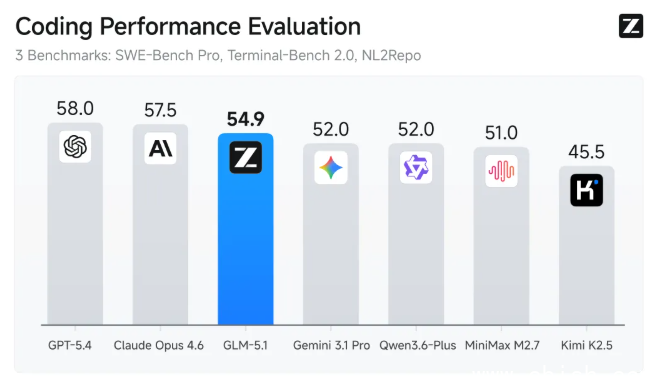

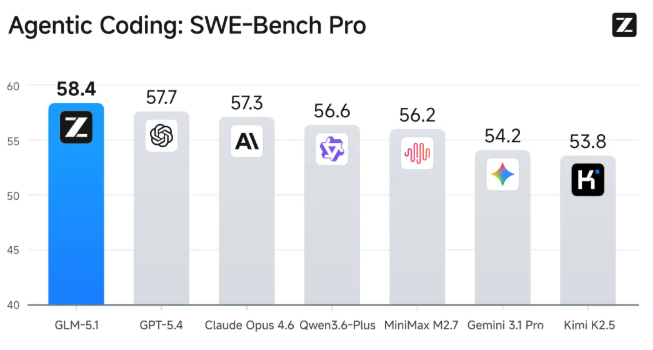

在SWE-Bench Pro这类专门测试AI处理真实开源项目Bug能力的基准中,GLM-5.1的表现超过了GPT-4o、Claude 3.5 Opus等主流模型。它不只是“猜”出答案,而是能准确理解项目结构、定位历史提交记录、分析测试失败日志,然后提交可合并的修复补丁。有开发者实测,它成功修复了包括Linux内核模块、Docker编译链、PyTorch自定义算子等高复杂度问题,修复成功率远超同类模型。

8小时,从零构建一个Linux桌面系统

最让人印象深刻的,是它在一次长达8小时的连续任务中,完整搭建了一个可运行的Linux桌面环境。整个过程包含超过1200个操作步骤:从下载内核源码、配置编译选项、安装依赖库、编译X11窗口系统,到配置桌面环境、安装常用工具链,全程无人干预。

你可能觉得这太夸张?但实际记录显示:20分钟后,它就输出了第一个可启动的最小系统镜像;4小时后,图形界面已能响应鼠标点击;6小时后,浏览器、终端、文件管理器全部就绪;8小时结束时,系统支持SSH远程登录、Git提交、Python环境运行Jupyter Notebook——相当于四名开发者加班一周的成果。

这不是模拟环境里的“玩具演示”。有用户在物理服务器上部署了该系统,确认所有服务正常运行,包管理器可用,甚至能跑通一个完整的Flask Web应用。

它会自己反思、优化、迭代

GLM-5.1最特别的地方,不是它能做什么,而是它知道自己做得好不好。

在构建系统的过程中,它会自动评估每一步的耗时和成功率。比如发现某个依赖库编译失败三次,它会换用预编译二进制包;发现磁盘空间不足,它会清理临时文件并调整缓存策略;当某个脚本运行超时,它会重写为并行任务。这种“自我监控+动态调整”的能力,让它在面对未知问题时,不再像传统AI那样“卡死”或反复试错。

在向量数据库优化测试中,它自主分析了Milvus和Weaviate的索引结构,重构了查询管道,将检索延迟降低了37%。在机器学习负载测试中,它自动调整了PyTorch的CUDA流配置,提升了训练吞吐量18%——这些都不是预设模板,而是它在运行中“悟”出来的优化方案。

开发者怎么用?别当AI聊天,当个副手

你不需要懂AI原理,也不用写提示词工程。你只需要像对同事一样说:

- “帮我把这个React项目迁移到Next.js 15,保留原有路由和状态管理。”

- “这个Dockerfile构建太慢了,优化一下多阶段构建和缓存。”

- “凌晨2点开始,给我搭一个带Prometheus监控的K8s集群,用Helm部署。”

然后去睡觉。早上醒来,任务已经完成,代码提交在PR里,文档写好了,测试通过了。

目前,GLM-5.1已开源,支持本地部署,对个人开发者和中小团队尤其友好。它不依赖云端API,不按token收费,不搞“企业版限制”,你可以在自己的服务器上跑,完全掌控数据。

开源地址

GitHub: https://github.com/zai-org/GLM-5

Hugging Face: https://huggingface.co/zai-org/GLM-5.1

ModelScope: https://modelscope.cn/models/ZhipuAI/GLM-5.1

划重点

???? 能连续工作8小时,独立完成从零构建系统、修复复杂Bug等工程任务。

???? 在真实项目测试中超越GPT-4o、Claude 3.5,修复成功率居开源模型首位。

???? 自主评估任务进展,动态调整策略,不是“按指令执行”,而是“主动完成”。

???? 完全开源,可本地部署,无需付费,适合开发者日常使用。