苹果联手港大推出全新渲染技术 LGTM,Vision Pro 画质迎来质变

苹果研究团队与香港大学近日联合发布了一项名为 LGTM(Less Gaussians, Texture More)的新型渲染框架,目标直指当前虚拟现实设备在4K以上分辨率下的性能瓶颈。这项技术并非单纯追求“更高像素”,而是从底层重构了3D场景的渲染逻辑,让 Vision Pro 这类高分辨率头显真正实现“清晰不卡顿”的沉浸体验。

过去几年,3D高斯泼溅(3D Gaussian Splatting)技术因其快速从2D图像生成3D场景的能力备受关注,被广泛用于实时渲染领域。但问题也随之而来——当分辨率提升到4K甚至更高时,所需的高斯点数量呈指数级增长,导致显存爆满、帧率骤降。Vision Pro 的双屏合计接近2300万像素,单眼分辨率超越多数4K电视,传统方案在运行复杂场景时,动辄出现延迟、模糊甚至掉帧,严重影响沉浸感。

解耦几何与纹理:让算力用在刀刃上

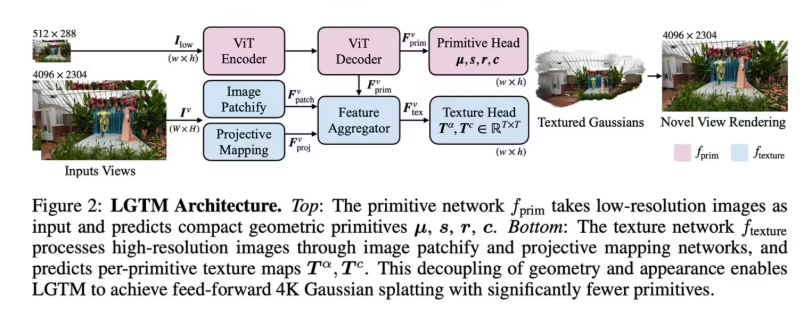

LGTM 的核心突破,在于彻底拆解了“几何结构”和“表面纹理”这两个原本捆绑在一起的渲染环节。

传统方法像是一次性把房子的钢筋骨架、墙面涂料、壁纸、灯具全堆在一起建模,每多一个像素,就得重新算一遍所有细节。而 LGTM 则像装修房子:先用低分辨率数据快速搭出准确的结构框架(比如墙角、门窗位置),确保整体透视和空间关系无误;再单独用高分辨率纹理图层,一层层贴上砖纹、木纹、文字、反光材质——这些细节只在需要的地方精细渲染,而不是全场景暴力计算。

这种“先骨架、后皮肤”的两阶段设计,让系统在2K分辨率下完成几何重建,再在4K层叠加纹理,大幅降低实时渲染的计算负载。实测显示,在相同硬件条件下,LGTM 的渲染效率比传统高斯泼溅提升近3倍,显存占用减少超过50%。

不只是画质提升,更是体验的翻身

对普通用户来说,这意味着什么?

想象一下:你在 Vision Pro 里浏览一张高清照片墙,以前文字边缘模糊、书脊上的字迹看不清,现在连报纸上的小标题都能清晰辨认;你走进一个虚拟博物馆,墙上的油画笔触细腻、金属展品反光自然,不再有“塑料感”;甚至在多人协作的虚拟会议中,对方手写的白板笔记也能清晰呈现,不再需要放大再放大。

苹果内部测试视频显示,接入 LGTM 后,文字渲染清晰度提升超过70%,动态场景的帧稳定性(Frame Time Variance)下降近60%。这不仅让视觉体验更真实,更直接减少了因画面延迟带来的眩晕感——这是当前VR设备最难攻克的体验痛点之一。

未来已来:不只是Vision Pro,还有更多可能

虽然目前 LGTM 首次亮相于 Vision Pro 生态,但其架构设计具有极强的通用性。有知情人士透露,该技术已开始在苹果的AR/VR开发工具链中内测,未来可能逐步应用于 iOS 的 ARKit、macOS 的 Reality Composer,甚至为下一代 Apple Glass 做技术储备。

更重要的是,LGTM 的低算力高画质特性,让中高端智能手机和笔记本也能在不依赖专用显卡的情况下,流畅运行高质量的3D内容。这意味着,未来你可能在 iPhone 上用AR查看家具摆放效果时,不再需要等待“渲染中…”的提示。

这不是一次简单的算法优化,而是一场从“能跑”到“真好看、真顺滑”的体验革命。苹果和港大这次,真正把“画质”和“流畅”这两个原本矛盾的目标,变成了可以同时实现的标配。

划重点

- ???? 苹果 × 香港大学:联合研发,非实验室概念,已进入实际系统集成阶段。

- ???? 解耦几何与纹理:用“低算力搭骨架+高分辨率贴皮肤”方式,让4K渲染不再吃掉全部性能。

- ???? Vision Pro 实测升级:文字清晰度、帧率稳定性、细节表现力全面跃升,眩晕感显著降低。

- ???? 未来可扩展:技术有望下放至 iOS、macOS,甚至为下一代AR眼镜铺路。