千问3.5-Omni来了:中国大模型首次在全模态交互上全面领先

3月30日,阿里云正式发布新一代全模态大模型Qwen3.5-Omni。这不是一次普通的升级,而是一次从“能听懂你说话”到“真正理解你世界”的跨越。它不再只是处理文字,而是能看视频、听语音、识草图、懂方言,甚至能根据你随手画的线稿,直接生成一个能用的产品界面。

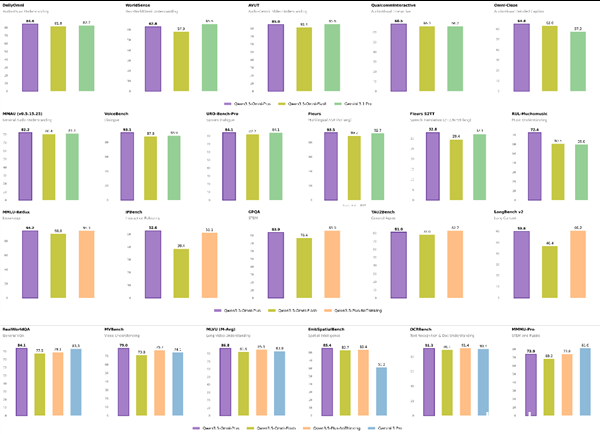

215项测试全胜,不是口号,是实测数据

在权威测试平台DailyOmni和QualcommInteractive上,Qwen3.5-Omni的综合得分明显超过Google的Gemini 3.1 Pro。这不是实验室里的理想环境,而是真实场景下的比拼:嘈杂地铁里的人声、模糊摄像头拍下的手写草图、多语种混合的语音指令——它都能准确识别并回应。

在WenetSpeech噪声语音识别测试中,它的错误率比竞品低近40%。在215项涵盖音视频理解、跨模态推理、多语言交互的测试中,它全部拿下第一。这不是“接近”或“持平”,是实打实的“全面领先”。

能听懂海南话,也能看懂你画的草图

你可能没想到,这个模型能听懂毛利语、海南方言、粤语俚语,甚至能区分四川话里“巴适”和“安逸”的细微差别。它不是靠翻译,而是直接理解语音背后的语义。

更让人惊讶的是它的“Vibe Coding”功能。设计师不用写一行代码,也不用打开Figma——只要打开手机摄像头,随手在纸上画个按钮、加个文字说明,再口述一句“我要个蓝色主题,点一下跳转到首页”,模型就能在几秒内生成一个可交互的原型界面,连动效和跳转逻辑都自动补全。

一位深圳的创业团队试用后说:“我们原本要花两周做MVP,现在半小时就搞定了。老板看完直接说:‘这东西能上线吗?’”

10小时音频,自动切片+打标签,记者和播客主的救星

对内容创作者来说,这个功能太实用了。你可以上传一段10小时的访谈录音,它能自动识别出不同发言者,标注出关键段落,甚至总结出“情绪高点”和“沉默间隙”——比如哪一段采访对象语气激动、哪一段明显犹豫,它都能标记出来。

记者不用再熬夜听录音整理稿,播客主能快速剪出精华片段,企业培训部门可以自动把会议录音转成带时间戳的要点摘要。这些不是“AI总结”,而是基于语义、语气、停顿的深度分析。

价格不到Gemini的十分之一,企业用得起

技术再强,用不起也是空谈。Qwen3.5-Omni在阿里云百炼平台上线了Plus、Flash、Light三种API版本,最低成本每百万Tokens不到0.8元。而Gemini 3.1 Pro同等规模的调用成本,通常在8元以上。

这意味着,一家中小型电商公司,每天用它处理上千条客服语音、自动生成商品描述、识别用户上传的图片问题,一个月的费用不到一杯奶茶钱。

目前,已有超过100万家企业在使用千问系列模型,稳居中国企业级市场第一。不是靠补贴,而是靠真实复购——很多客户从免费试用,到付费升级,再到批量接入核心业务。

它不是在“模仿人类”,而是在重新定义交互

过去,我们和AI对话,是打字、提问、等待回复。现在,你可以对着手机说:“帮我把上周三的会议录音,挑出老板发火的那三分钟,做成短视频发朋友圈。”——它能听懂“发火”不是字面意思,而是语气、语速、关键词的综合判断。

它不只在技术上领先,更在体验上颠覆了人机交互的边界。当AI能看懂你画的草图、听懂你的方言、理解你的情绪波动,它就不再是工具,而是一个能协作的伙伴。

Qwen3.5-Omni的发布,不是一场发布会,而是一次无声的革命。它让AI从“屏幕里的回答者”,变成了“你身边懂你的人”。