蚂蚁灵波开源全球最大真实RGB-D数据集,推动机器人感知进入新阶段

3月31日,蚂蚁灵波科技正式开源LingBot-Depth-Dataset——目前全球规模最大的真实场景RGB-D深度数据集。该数据集包含300万组高质量样本,其中200万组来自真实环境实地采集,100万组为高保真渲染生成,总数据量达2.71TB,覆盖Orbbec 335、335L,以及Intel RealSense D405、D415、D435、D455六款主流消费级与工业级深度相机。

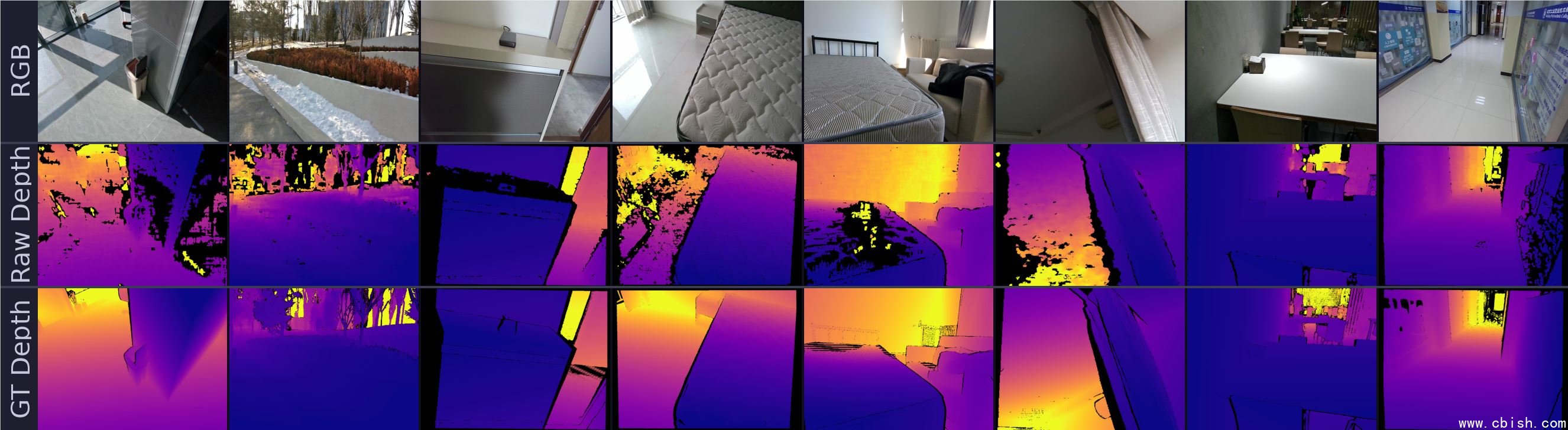

这不是又一个“合成数据集”。LingBot-Depth-Dataset的核心价值,在于它真实记录了日常环境中的复杂光学挑战:玻璃窗的透射干扰、镜面的强烈反射、低光下的噪声、毛绒织物的漫反射、透明液体的深度丢失……这些在以往开源数据中几乎被忽略的“真实噪声”,如今都被完整保留。每一组样本都同步提供RGB图像、传感器原始深度图和高精度真值深度图,直接可用于深度估计、稀疏补全、三维重建等任务的训练与评测。

(图说:LingBot-Depth-Dataset 数据样例。从上到下依次为 RGB 图像、传感器原始深度图和真值深度图。该数据集同时提供原始深度与真值深度信息,为相关模型在真实场景中的训练和评估提供有力支撑。)

为什么这个数据集能改变行业现状?

过去五年,学术界和工业界依赖的深度数据集,如NYU Depth V2、KITTI、ScanNet等,要么规模太小(不足十万组),要么采集设备单一,要么大量依赖仿真渲染。很多模型在实验室跑得不错,一到真实家庭、商场、仓库就“失明”——玻璃看不见、反光成黑洞、阴影区全丢。

LingBot-Depth-Dataset首次系统性地解决了这个问题。团队历时两年,在全国20多个城市采集了超市、办公室、住宅、医院、展厅等真实场景,使用六种不同型号的深度相机同步拍摄,确保数据覆盖不同价格段、不同精度、不同噪声特性的硬件。每一张图都经过激光雷达扫描校准,生成毫米级精度的真值深度图,为模型训练提供了前所未有的“黄金标准”。

模型已落地:搭载后,便宜相机也能干掉高端设备

基于这个数据集训练的LingBot-Depth模型,已在实际产品中验证效果。在不更换任何硬件的前提下,将该模型部署到市售的百元级Orbbec相机上,其在透明玻璃、镜面、逆光等极端场景下的深度输出质量,已超越部分售价数千元的工业级RealSense D455。

实测对比显示:

- 在室内复杂场景中,深度预测误差降低超70%;

- 在稀疏深度补全任务中,误差下降约47%;

- 边缘保持能力显著提升,玻璃轮廓清晰可见,反光区域不再“空洞”;

- 模型轻量化后,可在Jetson Orin Nano等边缘设备上实时运行。

这意味着,机器人、AR眼镜、家庭服务机器人等终端设备,无需升级昂贵的传感器,仅靠软件优化,就能大幅提升空间感知能力——这对降低成本、加速落地至关重要。

对高校和创业公司意味着什么?

过去,想做深度感知研究,要么花几十万买激光雷达扫楼,要么用仿真环境“纸上谈兵”。LingBot-Depth-Dataset的开源,让任何一个实验室都能拥有媲美大厂的训练基础。

数据集已开放下载,包含完整的元数据、相机标定参数、采集环境标注和评估脚本。GitHub页面提供PyTorch/TensorFlow加载示例,支持与Open3D、COLMAP、NeRF等主流工具链无缝对接。

我们已收到多所985高校实验室的反馈:有团队用这套数据训练的模型,成功帮助扫地机器人在反光地板上稳定避障;有研究生基于此数据完成的毕业设计,被CVPR 2026接收;还有初创公司直接用它优化了自家仓储机器人导航系统,部署成本下降了60%。

这不是终点,而是起点

空间感知是具身智能的“眼睛”。没有真实数据,再好的算法也只是空中楼阁。LingBot-Depth-Dataset的开源,不只是一个数据包,它代表了一种态度:技术进步,不该被数据壁垒封锁。

我们相信,未来三年,真正能跑进千家万户的机器人,不会是靠最贵传感器堆出来的,而是靠最聪明的算法,用最真实的数据训练出来的。而今天,这个起点,已经打开。

数据集地址:https://github.com/ant-lingbot/LingBot-Depth-Dataset