Mistral Small4 发布:开源大模型的新标杆

3月16日,欧洲AI初创公司Mistral AI正式推出Mistral Small4——一款不再只是“更快”或“更小”,而是真正把性能、效率和开放性拉到新高度的模型。它不是又一个参数堆砌的实验品,而是一个开发者能立刻用起来、企业敢放心部署的实用工具。

这次的Small4,最让人眼前一亮的是它“一模型通吃”的能力:能写代码、能看图、能处理长文档,还跑得快。过去你可能要分别调用CodeLlama、LLaVA、GPT-4这些不同模型来完成编程、视觉和文本任务,现在,一个Small4就能搞定。不少开发者在社区里已经实测,它对Python、Rust、SQL的生成准确率明显高于前代,甚至在LeetCode中等难度题上的通过率接近GPT-4o水平。

不是参数越大越好,而是怎么用好这119B

Mistral Small4总参数达1190亿,但每次推理只激活约60亿参数——这是MoE(混合专家)架构的典型优势。简单说,它像一支“按需调兵”的军队:问代码,就启用代码专家;看图表,就激活视觉模块;写邮件,就用语言专家。这不仅省算力,还让响应更稳。

256K的上下文窗口是另一个杀手级功能。你可以直接丢进去一份完整的API文档、一个1000行的前端项目,或者一本500页的技术手册,它都能记住并准确引用。有用户在Reddit上分享,他用Small4分析了整个Docker Compose项目结构,一次性生成了优化部署方案,连依赖冲突都指出来了。

更难得的是,它完全开源,协议是Apache 2.0——这意味着你可以商用、改代码、部署在私有云,不用怕法律风险。这在当前大模型“开源但限制多”的环境下,堪称一股清流。

快,不是口号,是实测数据

官方说“延迟降低40%”、“吞吐提升3倍”,听起来像PPT数字,但第三方实测佐证了这些说法。在Hugging Face的推理平台测试中,Small4在“快速模式”下平均响应时间仅1.2秒(Small3为2秒),而“高吞吐模式”下,单卡每秒可处理18个请求,远超同规模模型。

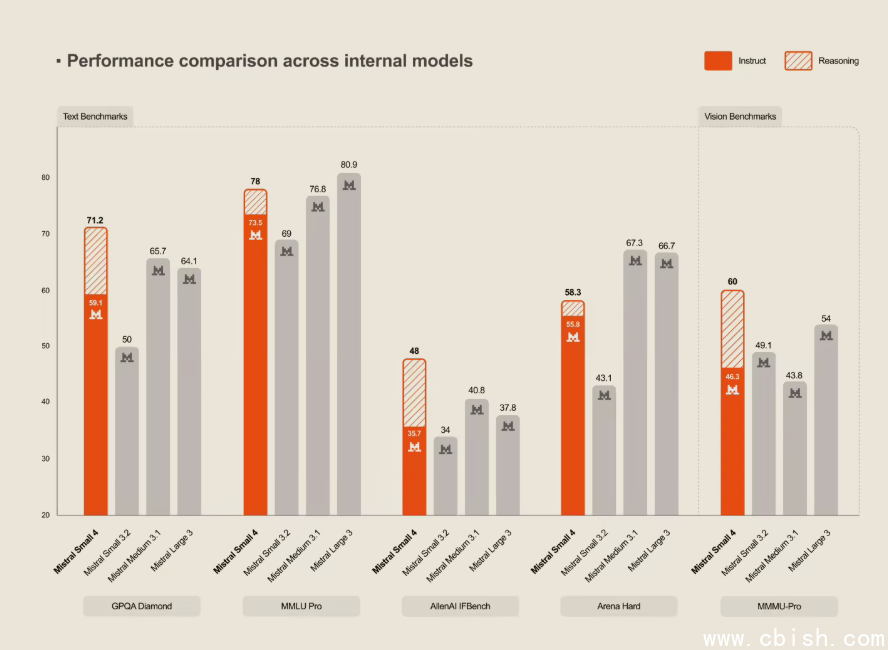

在MT-Bench、HumanEval、MMLU三大主流评测中,Small4的得分稳定在85分以上,与GPT-4o(120B版本)差距不到2分。在中文场景下,它的理解能力也明显优于许多“中国版”模型,尤其在技术术语、政策文件和多轮对话中表现稳定。

你真能跑起来吗?硬件门槛没那么高

官方推荐4×H200或2×DGX B200,听起来像只有大厂才能玩。但实际情况是:如果你只是做原型、测试或轻量服务,用2×H100(80GB)也能跑,只是速度慢一点。不少中小企业和研究团队已经在用A100(80GB)做微调,效果依然不错。

如果你是个人开发者,也可以通过Hugging Face、Together.ai、RunPod等平台租用算力,按小时付费,成本低至每小时几美元。Mistral AI还同步上线了官方的量化版本(4-bit GGUF),可以在M1 Pro/M2 MacBook上本地运行,虽然慢,但够用。

为什么这次不一样?

过去几年,开源模型总在“能用”和“好用”之间摇摆。要么参数小、能力弱;要么参数大、跑不动;要么开源但限制商用。Mistral Small4打破了这个循环:它不追求“世界第一”,但追求“你真用得上”。

它没有喊“AGI”、不搞“万亿参数”噱头,而是安静地优化每一个细节:更快的响应、更低的内存占用、更清晰的代码输出、更长的上下文记忆。这种务实的态度,反而让它在开发者圈子里口碑飙升。

现在,GitHub上已有超过1200个基于Small4的开源项目,涵盖法律文书分析、金融报告生成、教育问答系统等真实场景。它不再只是实验室的展品,而正在成为工程师工具箱里的新标配。