为什么同样的算力,有的模型能多跑出25%的性能?

3月16日,月之暗面(Moonshot AI)发布了一篇让人眼前一亮的技术报告——《Attention Residuals》。它没有谈参数量、没吹训练数据,而是把目光投向了过去十年里几乎没人敢碰的东西:残差连接。

你可能没听过“残差连接”这个词,但它是所有大模型的骨架。从2015年ResNet提出以来,它就一直默默支撑着深度学习的每一次突破。简单说,它就是让网络每一层“抄上一层的作业”,再加点自己的想法,避免越深越学不会。听起来很合理,对吧?

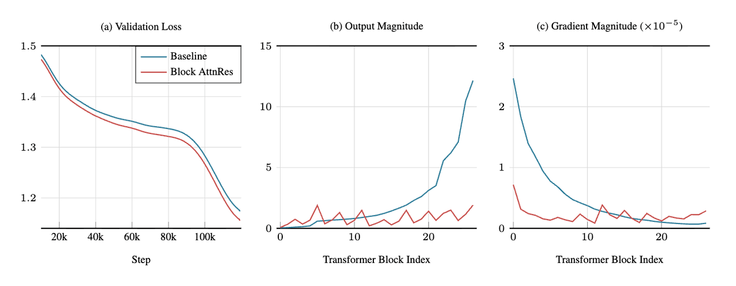

但问题来了:当网络深到几百层,每一层的“新想法”都被前面堆积如山的“作业”淹没了。结果就是——越往后,越像在重复劳动。很多层根本没起作用,只是在白跑。

他们把注意力机制“转了个90度”

Kimi团队没有去堆更多层,也没加更多参数。他们做了一件听起来有点“反直觉”的事:把原本用在文本序列里的“注意力机制”,横着搬到了网络的深度方向上。

什么意思?以前是每一层被动接收上一层的输出,现在每一层会问:“前面哪几层的信息对我最有用?我要多少?”就像你写论文,不再照抄所有前人的稿子,而是挑出最相关的几段,精炼引用。

这个小小的改动,让模型在相同算力下,达到了原本需要多花25%资源才能达到的效果。换句话说,你花100块能训练出的模型,现在用80块就能干同样的活。

不只是理论,实测数据说话

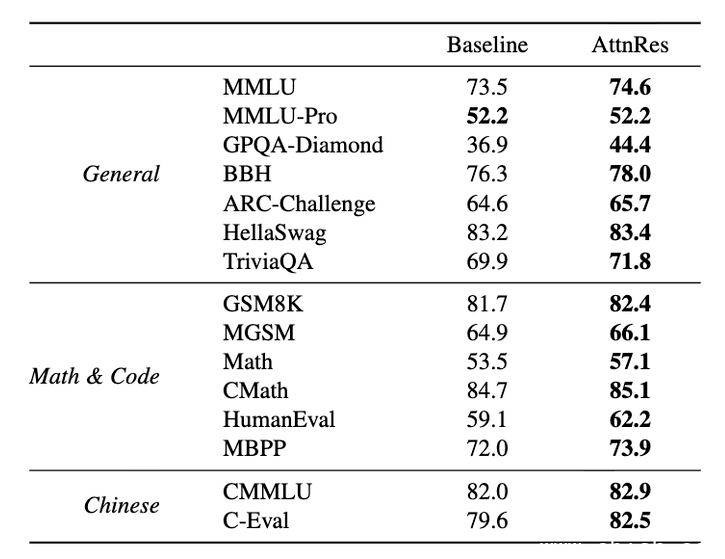

他们没停留在论文里。在GPQA-Diamond这种以高难度科学推理著称的测试里,新架构直接拉高了7.5%的准确率——这个数字在AI领域,相当于从“能答对一半”跃升到“接近专家水平”。

在数学题和代码生成任务上,也分别提升了3.6%和3.1%。这些不是小数点后几位的优化,而是能让模型真正“想得更深”的进步。

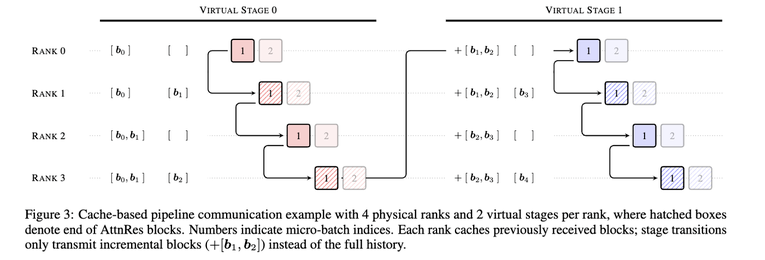

更关键的是,他们没让模型变慢。通过“Block AttnRes”设计,把网络分成几大块,每块内部做注意力,整体推理延迟只增加了不到2%——这在工程上几乎可以忽略不计。

硅谷的反应:这不是改进,是重新定义

OpenAI o1的核心发明者Jerry Tworek在社交平台直接评价:“这可能是深度学习2.0的起点。”

前OpenAI联合创始人Andrej Karpathy也忍不住感慨:“我们以为‘Attention is All You Need’已经讲透了,原来还有这么多没挖出来的潜力。”

这些名字,不是随便夸人的。他们亲眼见过太多“看起来厉害、实际用不了”的技术。而这次,他们看到了一种真正能落地、能省成本、能提升效果的底层重构。

别再只盯着参数量了

过去几年,大家比的都是谁参数更大、数据更多、训练时间更长。但算力成本已经越来越高,摩尔定律也慢了。真正能破局的,不再是“堆”,而是“怎么用”。

月之暗面这次做的,不是给模型加个新功能,而是重新设计了它的“神经系统”。就像汽车从燃油改到电动,不是换了个油箱,而是换了动力系统本身。

创始人在GTC2026演讲里说了一句话:“当所有人都在装修房子的客厅时,有人去加固了地基。”

这一次,地基动了。而它带来的,可能不只是效率的提升——而是整个AI训练范式的转变。